| Nvidia | AgentIQ | LLM | 人工智慧代理

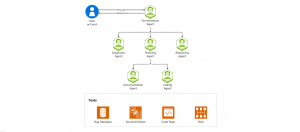

Nvidia推出AgentIQ開源工具加速跨框架AI代理整合

Nvidia開源AgentIQ Toolkit供開發者快速整合多代理人工智慧流程,支援跨框架運作與效能分析,推動人工智慧應用模組化與重用

2025-03-25

| Nvidia | Cosmos模型 | Cosmos-Transfer 1 | 機器人 | 自駕車

Nvidia開源用於機器人訓練的世界模型Cosmos-Transfer1

Nvidia更新世界基礎模型Cosmos系列,釋出可用來訓練機器人及自駕車的Cosmos-Transfer1

2025-03-21

| BlackRock | AI基礎設施 | 資料中心 | AI Infrastructure Partnership | AIP | 微軟 | Nvidia | XAI

Nvidia與xAI將加入新建及擴大資料中心的AI合作投資框架

Nvidia與xAI要加入由BlackRock、微軟與阿聯酋政府旗下MGX公司共同成立的AIP聯盟,目標是投資AI資料中心建案

2025-03-20

| Nvidia | Llama Nemotron | 推理模型 | AI代理

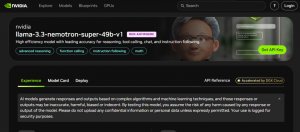

Nvidia公布Llama Nemotron AI推理模型,支援開發AI代理人

Llama Nemotron模型有三個規格,Nano可在PC和邊緣裝置執行、Super可在單一GPU上執行,而Ultra則適用於多顆GPU的伺服器,皆可以Nvidia NIM微服務形式執行

2025-03-19

| DGX Spark | DGX Station | 個人超級電腦 | AI | GPU | Grace Blackwell | Nvidia

Nvidia公布二款個人用AI超級電腦,Project Digits開放預約

Nvidia公布二款基於Grace Blackwell架構的個人電腦DGX Spark(代號Project Digits)、DGX Station,預計今年第二季開始陸續上市

2025-03-19

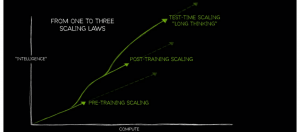

| Nvidia | AI | Blackwell | GTC

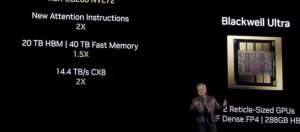

Nvidia發表Blackwell Ultra加速AI推理,釋出首個人形機器人開發的開放式基礎模型

Blackwell Ultra是基於去年的Blackwell架構,採用效能更高的GB300 NVL72及HGX B300 NVL16,其中GB300 NVL72為72個Blackwell Ultra GPU及36個Grace CPU組成。

2025-03-19

Nvidia先前提出RTX AI PC的品牌識別,去年曾在幾個國家舉行RTX AI PC Day活動,但他們對AI個人電腦的整體想法是什麼,大家並不清楚。這個答案似乎在今年1月舉行的美國消費電子展(CES)揭曉,因為黃仁勳的主題演講對此提出解釋

2025-02-27

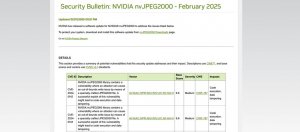

| Nvidia | JPEG2000 | nvJPEG2000 | CVE-2024-0142 | CVE-2024-0143 | CVE-2024-0144 | CVE-2024-0145

Nvidia修補圖像處理程式庫漏洞,若不處理攻擊者可藉由特製JPEG2000檔案觸發

Nivida近期針對JPEG2000圖片編碼程式庫nvJPEG2000修補一系列與越界寫入(OBW)與記憶體緩衝區溢位漏洞,值得留意的是,通報此事的思科指出,這些漏洞非常嚴重,而且相當容易利用

2025-02-18