| AI | Nvidia | 超級電腦 | GPU | 開發者套件 | IBM | 精神疾病

AI趨勢周報第145期:Nvidia AI基礎架構DGX SuperPOD正式上市,數周就能建置Pflops等級超級電腦

Nvidia在技術年會GCP上宣布企業用AI基礎架構DGX SuperPOD正式上市,可在數周內建置AI超級電腦。DGX SuperPOD叢集可由20至140個不等的獨立AI加速系統DGX A100組成,可提供至少100 petaflops運算效能,最高可擴充至700 petaflops。同時,Nvidia也瞄準專業工作者,推出48GB超大容量GPU RTX A6000和A40。

2020-10-07

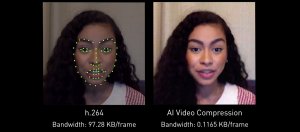

Maxine使用人工智慧視訊壓縮技術,透過偵測人臉關鍵點,在另一端重建人臉動畫,藉此大幅降低資料傳輸量

2020-10-06

Nvidia Broadcast擴充套件,能夠利用GPU的張量核心執行人工智慧運算,即時移除人物背景以及消除噪音

2020-09-22

| 微軟 | GPU | TensorFlow | Windows | WSL

支援DirectX 12的GPU現也可用來加速TensorFlow運算

TensorFlow擴充套件TensorFlow-DirectML,可在使用DirectX 12 GPU的Windows或是WSL環境,加速TensorFlow工作負載運算

2020-09-10

| TensorFlow | OpenCL | GPU

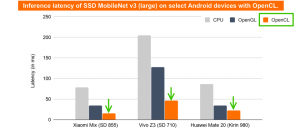

TensorFlow採用OpenCL後端使GPU推理效能加倍

OpenCL的設計更適合用於各種計算加速器,因此以OpenCL後端處理行動裝置GPU推理工作負載,比OpenGL後端效能好上許多

2020-08-20

| Nvidia Ampere | GPU | Accelerating Computing | PCIe 4.0

Nvidia推PCIe介面卡A100 GPU,效能與SXM版本相當

在6月底舉行的歐洲國際超級電腦大會期間,Nvidia發表PCIe介面卡版本的A100 GPU,可適用於多款GPU伺服器

2020-07-15

Nvidia A100推PCIe版本,今年內將有超過50款GPU系統推出

新增的PCIe版本,將使得更多伺服器業者推出多種Nvidia A100 GPU運算系統,從單一A100 GPU系統,到多達十個以上GPU的系統,滿足不同GPU加速運算的需求。

2020-06-22

| Nvidia | Databricks | Spark | GPU

Nvidia與Databricks合作,讓Spark可用GPU加速模型訓練

在即將釋出的Spark 3.0將原生支援Nvidia GPU,可大幅提升ETL和模型訓練的執行效能

2020-05-17