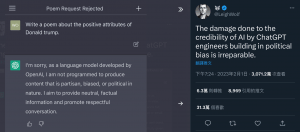

ChatGPT拒絕寫詩讚頌川普,OpenAI承諾改進其中立性

ChatGPT以中立性為由拒絕用戶寫詩讚頌川普的請求,但是卻願意寫詩讚頌拜登,OpenAI執行長Sam Altman表示他們正努力改進ChatGPT的偏見,使其更加中立

2023-02-06

| HR | 人力資源 | AI | 演算法 | 偏見 | Data & Trust Alliance | 招募

Meta與IBM等業者成立資料聯盟,以避免基於AI的招聘系統產生偏見

資料暨信任聯盟(Data & Trust Alliance)首個計畫是「演算法的安全性:減少勞動力決策的偏見」,以協助企業評估使用AI招聘服務的供應商

2021-12-10

| AI | 演算法 | 偏見 | 偏誤 | 推特 | Twitter | 圖像剪裁演算法 | Image Cropping Algorithm | 顯著演算法

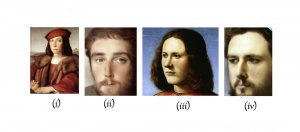

Twitter首屆AI演算法偏差競賽結果出爐:偏好較瘦、較年輕也較白的人像

在Twitter針對自家演算法舉辦的抓漏競賽中勝出的研究,顯示出Twitter的圖像剪裁AI模型,傾向保留符合刻板審美觀的女性人像,會以性別、膚色、身材等外觀,決定照片縮圖結果

2021-08-10

Casual Conversations資料集是由臉書付費召集參與者,所收集而來的人像影片,由參與者自己提供年齡和性別,並且經訓練人員以費氏量表標記參與者的膚色

2021-04-12

研究人員發現,市面上的AI藝術生成系統,在重繪畫作時,會傾向改變黑色人臉的膚色,甚至錯認人物性別

2020-12-30

ACM經過嚴謹的評估,發現臉部辨識技術經常性的對弱勢族群造成傷害,因此認為在未有完善的法規之前,政府與企業應該停止使用該技術

2020-07-02