KPMG安侯企業管理執行副總謝昀澤,分享企業在導入AI時可能面臨的新興風險,並建議企業應導入演算法治理方法,來降低風險發生機率。

攝影/翁芊儒

KPMG安侯企業管理執行副總謝昀澤在日前一場活動上,提醒企業在導入AI時可能面臨的新興風險,並指出,企業應從大數據的正確性、演算法的可解釋性、運算效率三大面向來檢視AI決策模型,建立起受信任的AI機制;且在導入AI前,也應充分評估AI應用的合適性,比如可用樣本量高、應用情境複雜度低、任務價值高的服務,較適合用AI來加值。

隨著AI的應用增加,AI不可解釋、偏見、公平性等問題也在近年來不斷被提出討論,各國政府也看見其爭議性,紛紛祭出法規來規範AI應用,比如歐盟早在2018年就制定資料保護規範GDPR,其中的「透明處理原則」,就是針對個人化決策的AI應用,賦予用戶請求解釋、拒絕適用的權利;美國白宮也在上周發布了AI應用監管指南,將AI應用的風險評估與管理、秉持公平且非歧視等原則列入其中,要從法律的高度,來約束企業克服AI的風險問題。

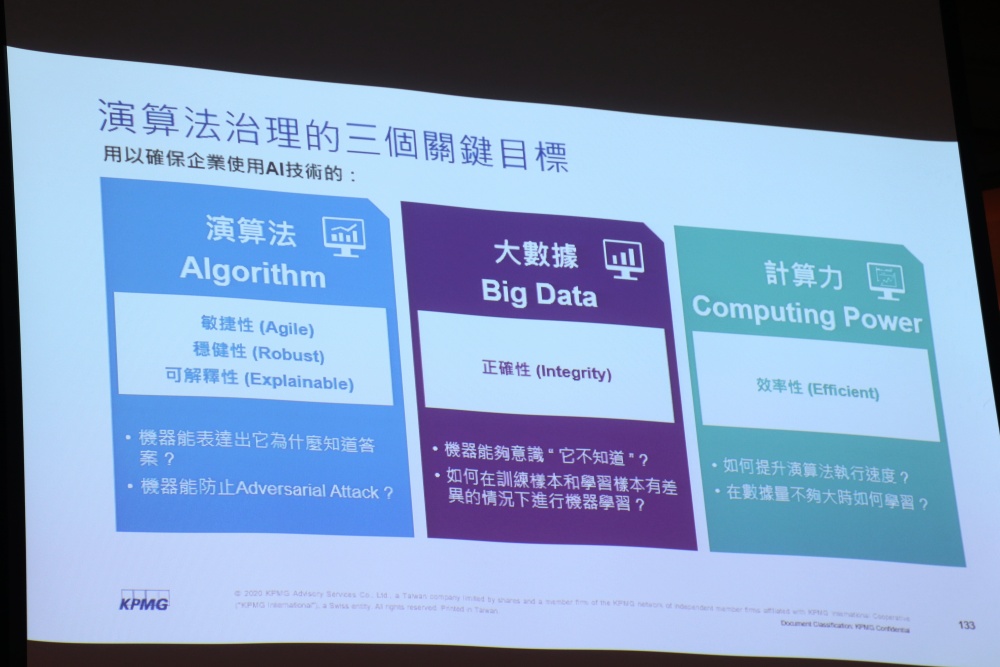

謝昀澤歸納,現今企業在導入AI時面臨多種風險,大致上來自於大數據、演算法、運算效率三個面向。比如說,使用過時、不完整或與實際情形不符的數據來訓練模型,會使模型決策產生偏誤;在演算法方面,開發流程的瑕疵、技術缺陷,或缺乏完整的測試與驗證,也會導致演算法產生Bug,同時還需謹慎提防資安攻擊、隱私濫用等威脅;最後在運算效率方面,則是要避免因為算力不足,造成AI決策延遲的問題,其他如決策者錯誤解讀或誤用分析結果等風險,也是企業面臨的挑戰。

現今企業在導入AI時,可以從大數據、演算法、運算效率三個面向來進行AI演算法治理。

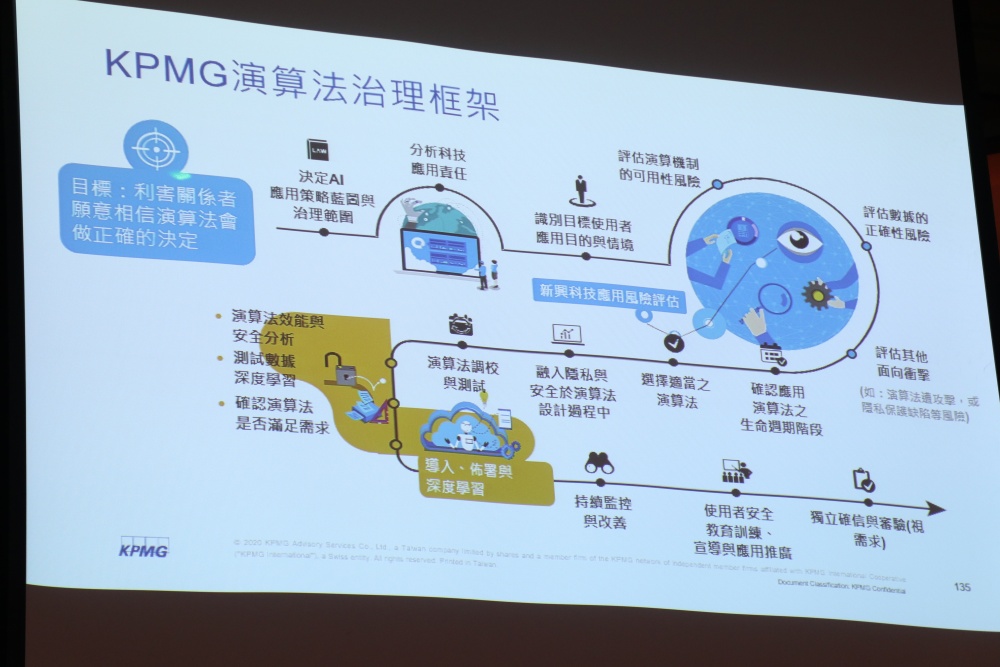

對此,KPMG也提出一套演算法治理框架供企業參考。企業在導入AI時,可以先決定AI應用策略並規劃治理藍圖,來把關整個AI導入流程,其中,除了確保大數據的正確性,在演算法方面,應從整體生命週期來檢視,在設計就融入資安與隱私防護措施,也應在調校與測試時,進行演算法效能與安全分析,並確認是否滿足原始需求;部署後,更要隨時監控與優化AI模型,並確實推廣使用者安全與教育訓練。謝昀澤表示,以上的框架就是為了讓利害關係者,相信演算法能做出正確決定。

KPMG提出一套演算法治理框架供企業參考。

在所有產業中,謝昀澤也表示,由於金融業的法規監管更嚴格,金融業對於演算法治理的需求也更大,智慧金融面臨的挑戰,包括AI決策是否符合道德與價值觀、帶來的風險、是否能被解釋,以及如何取得客戶及主管機關的信賴等。比如說,AI預測客戶可能在一年後離婚或失業,因此拒絕其貨貸申請,但要如何證明AI演算法沒有偏誤?又要如何向客戶解釋原由?又該如何取信於客戶?

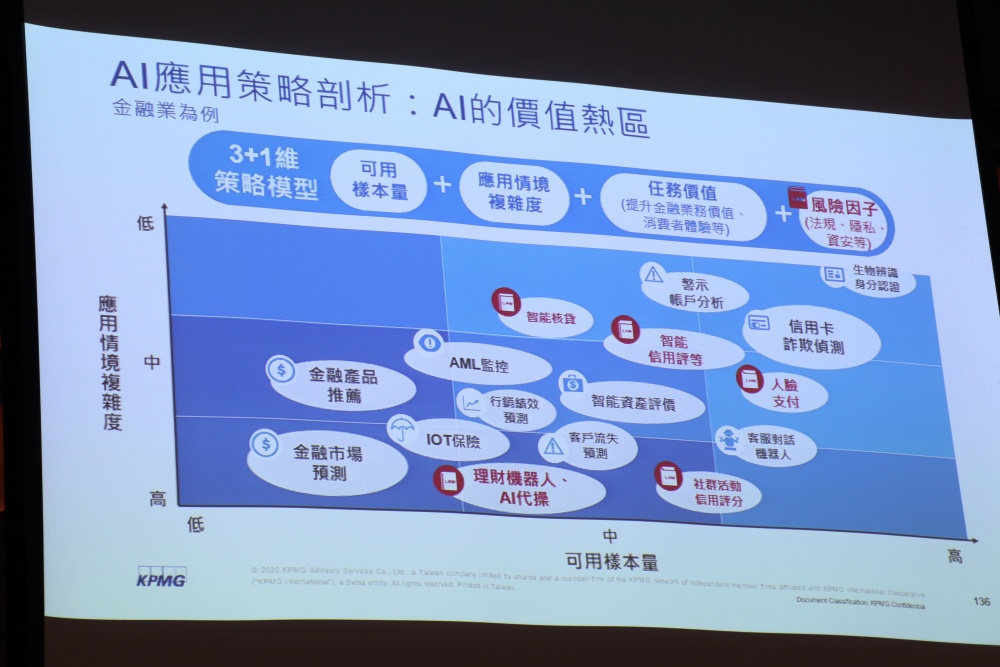

對此,謝昀澤建議,除了透過演算法治理框架來審視AI導入流程,在選擇AI應用種類時,也應進行策略剖析,找出較無爭議、適合導入AI的項目,以金融業來說,信用卡詐欺偵測、警示帳戶分析等作業流程,因其可用樣本量高、應用情境複雜度低、且任務價值高,就比較適合導入AI應用。而KPMG也分析出風險相對較高的應用,提供企業參考,分別是智能核貸、理財機器人(AI自動化代理操作)、智能信用評等、人臉支付、社群活動信用評分等。

縱軸是應用情境複雜度,橫軸是可用樣本量,圓圈大小代表任務價值高低。

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-03

2026-03-02