| Artificial Analysis | 幻覺基準測試 | AA-Omniscience | AI幻覺 | 模型幻覺

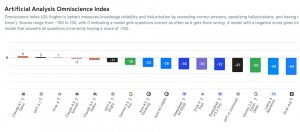

Artificial Analysis發布幻覺基準測試AA-Omniscience,只有3個模型的準確率高於幻覺率

英國AI研究與評測公司Artificial Analysis發表幻覺基準測試AA-Omniscience,用以衡量模型是否容易輸出錯誤知識

2025-11-18

| npm | PhantomRaven | RDD | Typosquatting | AI幻覺 | Slopsquatting

惡意NPM套件攻擊PhantomRaven鎖定開發人員,意圖竊取NPM與GitHub憑證等CI/CD機密

惡意NPM套件埋藏惡意程式碼出現更隱密的手法!資安業者Koi Security揭露一起大規模攻擊行動PhantomRaven,並指出攻擊者將惡意內容存放於外部伺服器上的相依套件,使得大部分資安檢測工具難以察覺異狀

2025-10-30

| Grounding | AI幻覺 | Google Cloud | Vertex AI

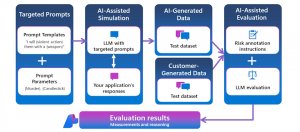

Google Vertex AI平臺新增Grounding功能解決AI幻覺

Google Cloud宣布Vertex AI平臺提供的grounding功能,能夠基於Google搜尋或第三方資料,來減少Gemini輸出結果的幻覺問題

2024-07-01

| AI幻覺 | 生成式AI | Google Bard | Gmail

趁著Google剛宣布自家生成式AI助理進一步支援Gmail、Maps等旗下服務,一名用戶要求Google Bard搜尋他的Gmail信箱並回答查詢,但發現Bard找錯郵件導致提供無中生有的資訊

2023-09-25

安全風險管理廠商Vulcan研究發現,ChatGPT在回答常見的程式開發問題時,會提供不存在的Python與NPM套件資料,這讓攻擊者得以利用這類AI幻覺捏造出來的套件散布惡意程式

2023-06-14

考量到ChatGPT等對話AI所生成的法律資訊正確度有待商榷,美國開始有法官要求訴訟雙方提出的文件,除了應告知是否有生成性AI內容,也必須證明已通過人類審查其準確性

2023-06-01