AWS的Amazon EC2容量區塊新功能,讓用戶可以事先指定時間,預留需要的GPU執行個體數量,確保在需要的時候有足夠的GPU資源可供使用

2023-11-02

| ARM | GPU | 漏洞 | Android | CVE-2023-4211

Arm在10月2日公布並修補影響GPU驅動程式的三項漏洞,其中的CVE-2023-4211正遭到濫用,Google也將透過10月安全更新,對受影響的Android手機提供修補

2023-10-03

| 微軟 | Windows 11 | 顏色過濾器 | GPU

Windows 11透過GPU顏色矩陣硬體元件,實現無延遲顏色過濾器應用

微軟在Windows 11最佳化顏色過濾器設定,運用GPU的顏色矩陣硬體元件減少延遲,在全螢幕遊戲和影片,提供高效能顏色調整功能,提升色盲與色弱使用者的視覺體驗

2023-09-29

電信公司NTT DOCOMO推出5G Open RAN解決方案OREX,其採用Nvidia GPU與資料處理單元(DPU),能透過硬體加速5G資料處理,提高虛擬無線接取網路(vRAN)的效能

2023-09-28

| 微軟 | Windows 11 | DirectX 12 | GPU

Windows 11附帶的DirectX 12新增CASO技術,能夠最佳化混合型筆電的遊戲效能,這項新技術能提高每秒影格數、減少延遲,讓遊戲執行更順暢

2023-09-26

| Meta | Khronos | GPU | Graphics API

Meta開源可簡化建置跨平臺高效圖形應用的中介圖形函式庫IGL

Meta聯手Khronos推出開源函式庫IGL,供開發者簡單創建高效圖形應用,支援多種圖形API和平臺

2023-07-11

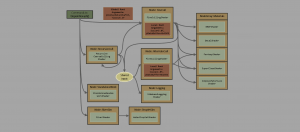

微軟計畫在D3D12新增工作圖(Work Graphs)功能,以提升GPU通用運算的工作負載處理能力,AMD、Nvidia、英特爾和高通皆參與設計

2023-06-27

| Meta | AI | GPU | 電腦視覺 | Yann LeCun | I-JEPA

Meta揭露效能超越生成式方法的電腦視覺模型I-JEPA,學習方式更接近人類

Meta AI最新的電腦視覺模型I-JEPA,以較少的GPU訓練時間就可獲得比當前生成式模型更好的效能,其特點在於能以人類理解世界的方式,高層次地預測缺失的資訊,而不被像素級不重要的細節困住

2023-06-15

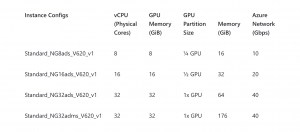

微軟推出NGads V620虛擬機器,專為雲端遊戲環境設計,配備AMD Radeon PRO V620 GPU和AMD EPYC 7763 CPU,可滿足高品質圖形生成與串流需求

2023-06-05