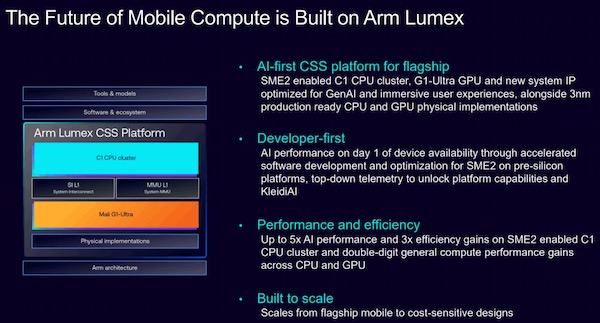

看準行動裝置端的AI應用潛力,Arm發表新的Lumex運算子系統(Compute Subsystem,CSS),一舉更新旗下的行動CPU、GPU,搭配新的SME2(Scalable Matrix Extension 2)可擴充延伸指令集,宣稱AI效能最高提升5倍。

Arm手機策略總監蔡武男表示,現今世代已習慣在智慧型手機螢幕觸控,但是未來AI在行動裝置的普及,帶來新的人機互動,未來新世代可能不再使用觸控,而是透過語音和手機對話,要求AI或是由AI依據你的需求執行任務。儘管行動裝置可仰賴雲端來執行AI推論,但是手機移動性難免處在行動網路不穩定的情形,沒有行動網路或是訊號較差的環境,將影響行動裝置上的AI使用體驗,此外,完全依賴雲端來執行AI推論,對服務提供商而言,成本也會高昂。

鑑於AI將會愈來愈重要,在行動裝置端執行AI應用,即時性、低延遲特別重要,且因為手機使用電池,還需要更高的能源效率,Arm發表全新的Lumex CSS運算平臺,搭載新的SME2指令集,這個新的矩陣延伸指令集,使得Lumex CSS提升CPU的AI處理效能最高達5倍,對於語音類的工作負載延遲可降低4.7倍,音訊生成速度則提升2.8倍。(下圖來源:Arm)

Arm以運動App「智慧瑜伽教練」為例,在SME2指令集的加速下,文字轉語音生成速度可提升2.4倍,使用者可以更即時得到AI的瑜伽指導。

而根據Arm展示的AI加速效果,沒有搭載SME2指令集的CPU,在達行神經網路的工作處理中,遠低於GPU,但是搭載SME2指令集的CPU,明顯提高神經網路的處理效能,縮短CPU與GPU間的效能落差,在一部分的測試項目中還超越GPU。

為吸引軟體開發者,Arm也提供KleidiAI函式庫,希望能讓裝置發揮SME2。目前KleidiAI支援AI框架,如PyTorch ExecuTorch、Google LiteRT、ONNX Runtime等。

Arm預期未來讓SME2擴展到各個CPU平臺,同時預期到了2030年,搭載SME與SME2的裝置將會為超過30億臺裝置新增加逾100億TOPS。(下圖來源:Arm)

更新CPU及GPU

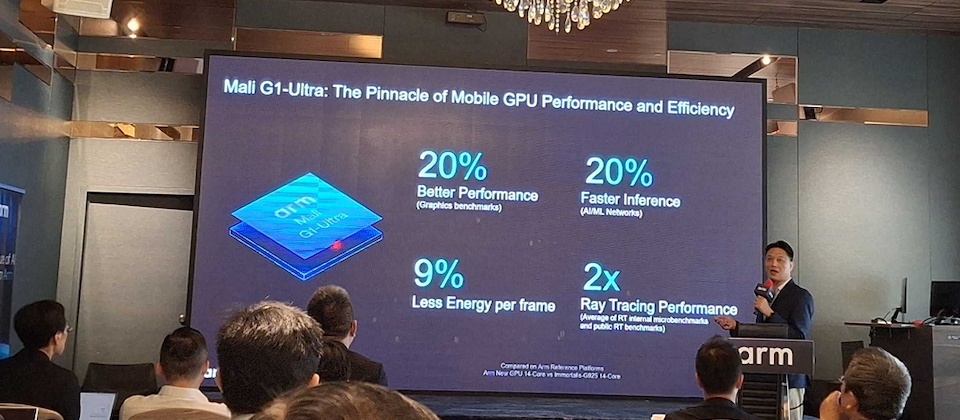

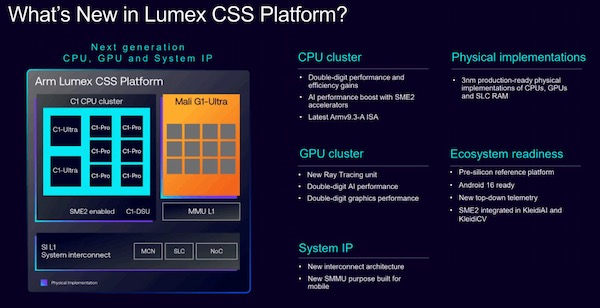

Lumex CSS目前針對3奈米製程最佳化實體實作,Lumex CSS包括採用SME2的Armv9.3 CPU叢集,還有宣稱提升2倍的光線追蹤效能的Arm Mali G1-Ultra GPU,以及DSU(Arm C1-DSU), KleidiAI函式庫。

至於CPU方面,Lumex CSS更新Arm原有的行動CPU命名及分類方式,過去Arm CPU採用的Cortex命名,現在在Lumex中CPU採用C1命名,將CPU分為5個種類等級。

這5種類的CPU,包括Arm C1-Ultra,C1-Pro、C1-Premium、C1-Pro、C1-Nano、Pico。其中的C1-Ultra定位為旗艦級效能,相當於先前的Cortex-X925,在SME2加持下,Arm稱其單執行緒效能提升25%,適用於大模型的推論、內容創作、生成式AI、運算攝影等等。

而C1-Pro為能耗核心,即扮演過去的小核角色,持續效能提升16%,在行動裝置中用於輔助C1-Ultra效能核心(大核),C1-Pro適用於影片播放、串流推論等工作負載處理。

C1-Premium兼顧C1-Ultra的效能,但面積減少35%,適用於次一級的旗艦級行動裝置,適合語音助理、多工處理。

至於C1-Nano強調能效,Arm宣稱其效率提升26%,但面積更小,因此適合行動穿戴裝置或小型裝置使用。最後是Pico,強調超低功耗,適用於物聯網裝置。

蔡武男指出,在今年5月Arm宣布轉型後,將從過去只提供IP,轉型為提供整合及彈性的平臺方案,加速合作夥伴推出產品至市場的速度。

Arm針對不同市場提供運算平臺方案,除了Lumex CSS運算平臺鎖定的行動裝置外,還有以資料中心為目標的Arm Neoverse,瞄準汽車領域的Arm Zena,專門為PC設計的Arm Niva,以及適用於IoT物聯網的Arm Orbis。

熱門新聞

2026-02-23

2026-02-23

2026-02-20

2026-02-23

2026-02-23

2026-02-25