在經過上周的高層人事出走及超大型募資等爭議新聞後,OpenAI本周舉行開發者大會DevDay,宣布包含GPT-4o圖片微調、開發逼真對話功能的Realtime API等新功能,供開發人員開發結合GPT-4o、4o mini模型的AI應用。

DevDay上OpenAI宣布的新功能包括Realtime API、視覺微調、提示快取(Prompt Caching in the API)以及模型蒸餾。其中Realtime API為beta版,讓開發商得以將接近ChatGPT進階語音模式(Advanced Voice Mode)的對話能力整合在自己的AI助理。

Realtime API讓開發人員得以打造低延遲、多模態的口語對話體驗。目前支援文字、語音的輸出、輸入,也支援函式呼叫。Realtime API提供原生語音輸入、語音輸出的生成,無需文字轉換,意謂輸出延遲更低。此外,其模型具有自然可操控的人聲表現,能提供自然語調變化,能表達和語氣一致化的笑、低聲說話等聲音表情。

昨日OpenAI宣布正式推出視覺微調功能。OpenAI在8月份推出GPT-4o微調服務時,只支援上傳文字資料集微調,現在加入圖片支援。這表示開發人員可以上傳圖片資料集,以強化GPT-4o的圖像理解功能,用於開發具有進階視覺搜尋應用、自駕車或智慧城市的物件偵測應用,或是醫療影像分析。

OpenAI表示,微調GPT-4o的圖像資料集不需太多,最少只需上傳100張圖像。在公開前,OpenAI已經和一些夥伴合作測試,包括東南亞最大餐食外送及汽車共享平臺Grab、企業流程AI代理開發商Automat和網頁AI開發助理開發商Coframe等。

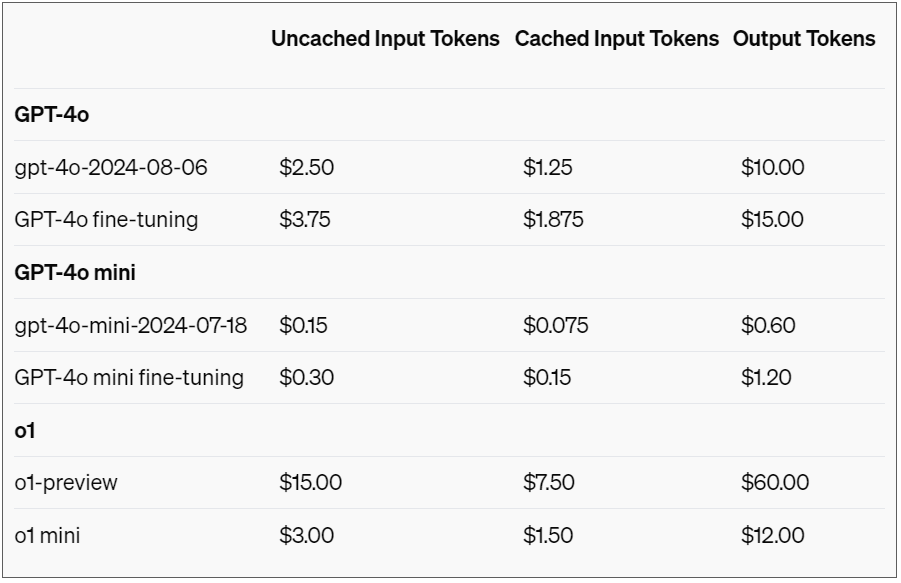

視覺微調服務基礎模型為gpt-4o-2024-08-06,在10月31日前提供每日100萬訓練字詞(token)免費。之後收費為每100萬字詞輸入25美元。若想使用推論服務,則費用為100萬字詞輸入3.75美元,100萬字詞輸出15美元。圖片輸入會依圖片大小字詞化(tokenized)以用於計價。

第三項則是API提示快取服務。許多開發人員在不同API呼叫會重覆使用同一種操作,像是編輯codebase或設定聊天機器人多來回對話。使用提示快取可讓開發人員重覆使用輸入字詞,可減少50%開發成本及加速提示處理時間,降低延遲性。

這項服務是將已運算過的提示的最長前綴字元(prefix)快取在API中,這功能會對1024字詞以上的提示提供快取。只要重覆使用到有共同前綴字元的,就會自動適用折扣,用戶不需設定。快取的字元一般會在停用5到10分鐘內清除,1小時內就會完全刪除。

提示快取服務已經上線,提示快取會自動適用在最新版GPT-4o、GPT-4o mini、OpenAI o1-mini或是這些模型的微調版本。經過快取的提示,價格比未快取的提示來得低。例如以新的gpt-4o-2024-08-06模型為例,未快取與快取的費用各為2.50和1.25美元,而經過微調的模型則各為3.75和1.875美元。

資料來源/OpenAI

最後是模型蒸餾(model distillation)和評估。模型蒸餾允許開發人員使用大型模型微調成較小模型的成果,使模型適用於單一任務,有助於降低延遲性及降低成本。使用這項功能的步驟是,先以completions API儲存(用store參數)大模型的高品質成果,再評估大小模型建立基準線,之後選擇欲蒸餾的部分,用以微調小型模型。最後,再比較大模型及微調後的小模型效果。

熱門新聞

2026-02-23

2026-02-23

2026-02-20

2026-02-23

2026-02-23

2026-02-25