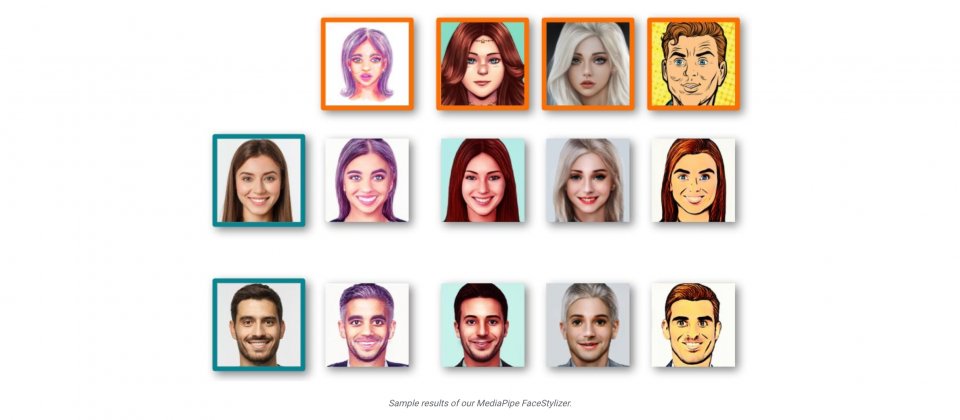

Google針對生成對抗網路(Generative Adversarial Network,GAN)的高運算複雜度提出解決方案,將原本需要在伺服器執行的臉部編輯模型輕量化,推出可在手機上運作的少樣本臉部風格模型MediaPipe FaceStylizer,提供高品質臉部圖片生成,並且透過MediaPipe平臺公開,讓用戶能夠自訂部署到行動裝置上。

生成對抗網路是一種深度學習模型,其包含生成器和鑑別器兩部分,生成器負責生成圖像,而鑑別器的任務則是分辨圖像是不是真實的,也就是發現該圖像是否由生成器所產生。而MediaPipe FaceStylizer針對臉部風格化設計,具有臉部生成器和臉部編碼器兩個主要元件。臉部編碼器的主要功能用於生成對抗網路反轉(GAN Inversion),將圖像映射到生成器的潛在碼(Latent Code)中。

生成對抗網路反轉是指用於尋找導致模型輸出的輸入,這個輸入再經過生成對抗網路的生成器時,會產生特定圖像,換句話說,當存在一張圖片,想要知道生成對抗網路的生成器中,可以產生該張圖片的潛在碼,這個過程便稱為生成對抗網路反轉。臉部編碼器便是找出潛在碼的角色,以便臉部生成器可以再次使用該潛在碼,生成相同或是類似的臉部圖像。

除此之外,研究人員為了最佳化生成器,特別設計了一些損失函式,並且結合常用的生成對抗網路損失函式,藉以最小化生成器的錯誤,他們從一個較為複雜的StyleGAN模型,提煉出一個更輕量的生成器BlazeStyleGAN。輕量生成器雖然容量小、執行快,但生成的圖片品質仍然很高。下圖研究結果顯示,BlazeStyleGAN生成的圖像品質很好(圖下),而且因為研究人員在損失函式的設計,進一步減少了StyleGAN可能產生的瑕疵和偽影(圖上)。

.png)

從參數數量和計算FLOPs評估模型複雜度,與StyleGAN擁有3,340萬參數相比,BlazeStyleGAN的複雜度大幅降低,在輸出圖片解析度為256x256的情況下,僅需要約200萬參數和1.28G FLOPs的BlazeStyleGAN模型。當輸出解析度為1024x1024,BlazeStyleGAN-1024可減少95%運算複雜度,而且輸出圖像品質與StyleGAN-1024模型沒有明顯差異,甚至抑制來自StyleGAN模型的偽影。

研究人員在高效能的裝置上,對MediaPipe FaceStylizer的推論時間進行基準測試,BlazeStyleGAN-256和BlazeStyleGAN-512在所有擁有GPU的裝置上都能達到即時運算,在更高階手機的執行時間甚至不到10毫秒。BlazeStyleGAN-256還可以在iOS裝置上以CPU即時生成結果。

Google將會透過MediaPipe平臺,向用戶公開MediaPipe FaceStylizer。BlazeStyleGAN模型經過訓練之後,只需要幾行程式碼,就能透過MediaPipe Tasks FaceStylizer API部署已匯出的TFLite模型到各平臺的應用程式。

熱門新聞

2026-02-23

2026-02-23

2026-02-20

2026-02-23

2026-02-23

2026-02-25