| FunctionGemma | Gemma 3 | 工具呼叫 | 裝置端代理 | 模型微調

Google推出FunctionGemma小模型,公開訓練配方主打本機工具呼叫

Google將Gemma 3的270M小模型針對工具呼叫應用進行微調,推出FunctionGemma 270M,鎖定手機與單板電腦等裝置端應用,並同步公開完整訓練配方。

2025-12-19

| VaultGemma | 差分隱私 | DP-SGD | google | Gemma 3

Google釋出VaultGemma,全球最大差分隱私語言模型開放下載

Google VaultGemma語言模型具10億參數,並採序列級差分隱私訓練,實測效能接近15億參數的GPT-2 1.5B,但低於10億參數的Gemma 3 1B

2025-09-16

| Mistral Small 3.1 | 多模態AI | AI模型 | Gemma 3 | 本地端部署

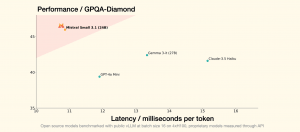

Mistral Small 3.1視覺與語文理解能力領先Google新推的Gemma 3

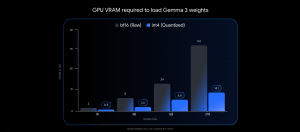

Mistral AI推出Mistral Small 3.1,主打高效能與本地端運行能力,基準測試顯示其視覺理解與長上下文處理表現明顯優於Gemma 3,適合單卡GPU硬體環境

2025-03-19