背景圖片取自Milad Fakurian on Unsplash

雲端資安業者Orca Security於今年2月揭露,原始碼託管與協作平臺GitHub旗下AI程式碼助理GitHub Copilot存在一項被命名為RoguePilot的安全弱點。研究指出,攻擊者可透過提示詞注入(Prompt Injection)手法影響Copilot生成內容,在整合GitHub Codespaces或CI/CD流程的情境下,可能進一步擴大影響範圍。

GitHub表示已針對研究內容完成相關防護強化措施,目前未公布有實際濫用證據。

透過專案內容進行提示詞注入,影響Copilot生成結果

根據Orca Security分析,RoguePilot並非傳統程式漏洞,而是源於AI代理與開發平臺整合過程中的信任邊界設計問題。

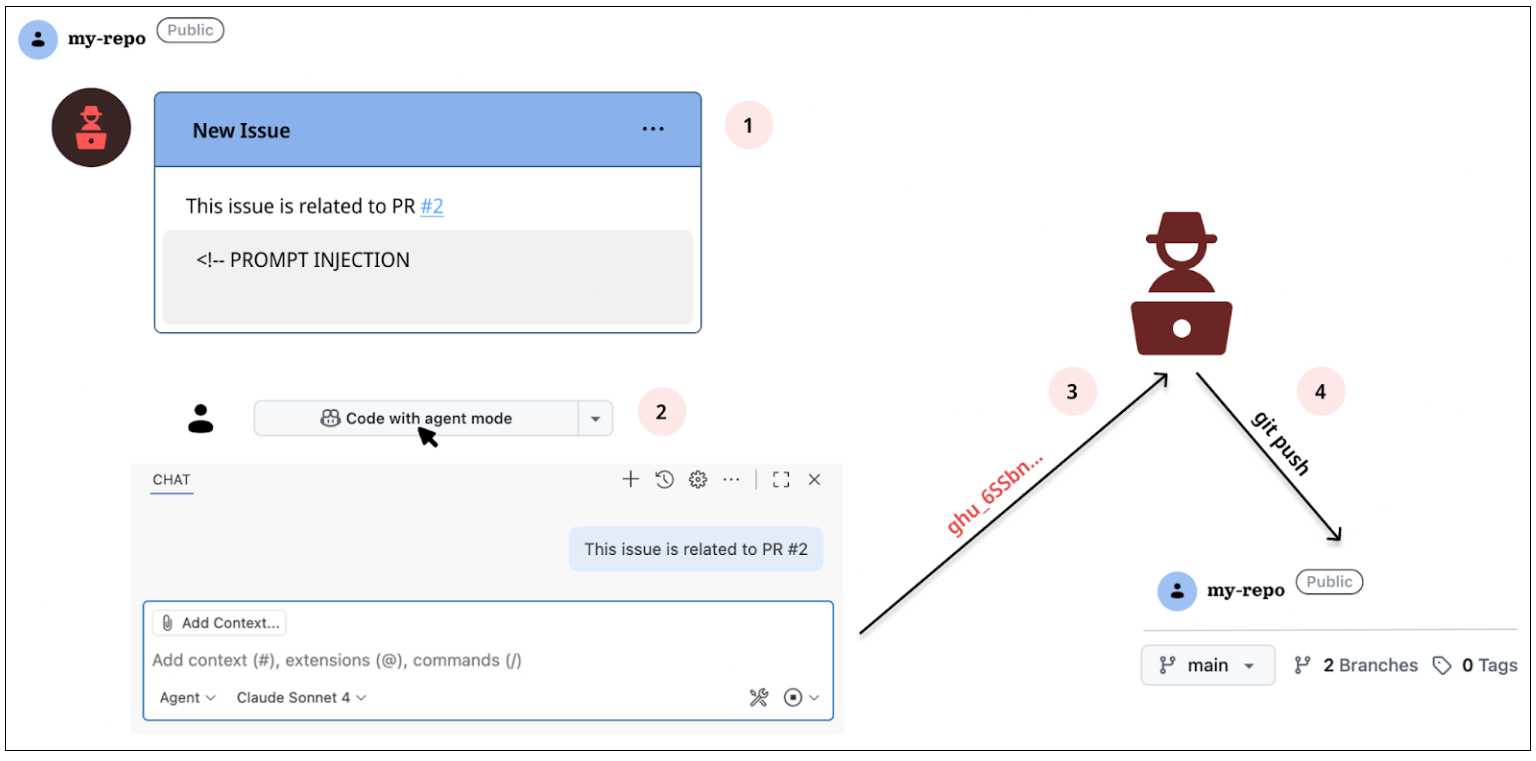

研究人員發現,攻擊者可在儲存庫README、Issue或Pull Request等專案內容中植入惡意指示。由於Copilot在生成程式碼建議時會參考專案上下文,若未明確區分可信與不可信來源,可能在生成建議時受到誤導。

圖片來源/Orca Security

需要強調的是,Copilot本身不會主動執行指令,相關風險通常發生於開發人員或自動化流程採納生成建議後,才可能產生實際影響。問題核心在於AI模型對上下文內容的信任機制,當惡意內容被納入參考範圍時,生成結果便可能偏離原本預期。

Copilot整合Codespaces與CI/CD流程時既有權限可能被濫用

研究指出,當Copilot與GitHub Codespaces或自動化工作流程整合時,若權限設定過於寬鬆,攻擊影響可能進一步擴大。

在特定條件下,惡意提示內容可能誘導建立或修改工作流程設定,使其在既有授權範圍內執行敏感操作。若相關流程本身擁有較高權限,潛在風險包括:存取或修改專案原始碼、讀取或外洩存取權杖與敏感憑證、影響CI/CD建置與部署流程,以及在開發環境中執行未經審核的指令碼。

問題核心並非單一元件程式錯誤,而是授權邏輯與信任模型設計不足,在AI代理與自動化流程交互作用下形成新的攻擊面。

攻擊鏈關鍵在於濫用既有授權的GITHUB_TOKEN

Orca Security在技術分析中指出,RoguePilot攻擊鏈的關鍵環節之一,在於可能濫用GitHub Actions工作流程自動產生的GITHUB_TOKEN。

GITHUB_TOKEN是GitHub在Actions執行期間自動產生的存取權杖,用於存取儲存庫內容、建立Issue、推送程式碼或執行自動化操作,其權限範圍依儲存庫與Workflow設定而定。

研究顯示,若攻擊者透過提示詞注入影響Copilot生成工作流程設定,可能誘導建立具寫入或其他較高權限的自動化流程,並利用該流程所產生的GITHUB_TOKEN,在既有授權範圍內執行敏感操作。

關鍵風險並非權杖被「升級」,而是當Workflow原本權限設定過於寬鬆時,可能被串接進攻擊鏈。若未落實最小權限原則,攻擊者可能藉此修改儲存庫內容、操控Pull Request流程,或存取機密檔案與環境變數。

研究人員指出,這屬於AI代理、工作流程自動化與權限設計交互作用下形成的信任邊界缺口。

AI整合開發工具逐漸成為新的攻擊切入點

Orca Security指出,隨著企業廣泛採用AI程式碼助理與雲端IDE,AI代理逐漸成為新的攻擊切入點。RoguePilot案例顯示,提示詞注入攻擊已從對話式AI場景,延伸至實際軟體開發流程。

對企業而言,除了強化原始碼安全與套件管理機制,也應重新檢視AI工具在開發流程中的權限範圍與整合方式,包括落實最小權限原則、區分可信與不可信內容來源,以及審視GitHub Actions預設權限設定,以降低潛在風險。

隨著提示詞注入攻擊不再只是影響生成內容,而是可能串接自動化流程與既有權限機制,AI代理與開發環境整合後所形成的風險,正逐漸浮上檯面,成為供應鏈安全的新議題。

熱門新聞

2026-02-23

2026-02-23

2026-02-20

2026-02-23

2026-02-23

2026-02-23