DeepMind

Alphabet旗下的人工智慧子公司DeepMind在本周發表了更安全的聊天機器人Sparrow,DeepMind替Sparrow制定了規則,即時利用Google搜尋來尋找答案,亦透過人類與Sparrow的對話來改善機器人的對話內容。

DeepMind表示,近來各種大型語言模型(Large Language Model,LLM)已在問答、摘錄或對話等任務上頗有成效,其中,對話是一個特別有趣的任務,因為它具備靈活且互動的交流,然而,基於LLM的聊天機器人還是會出現不準確、虛構、歧視或鼓勵不安全行為的對話,為了讓聊天機器人更安全,必須藉由人類的回應來學習,採用基於人類參與者的強化學習,而Sparrow即是最新的產物。

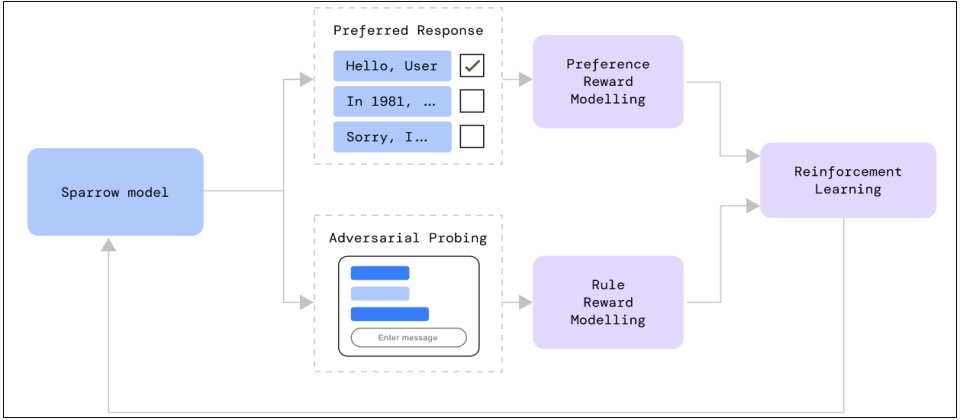

Sparrow為一概念性驗證與研究模型,目的是讓聊天機器人得以更有用、更正確也更無害。因此,DeepMind透過人類的回饋來強化Sparrow學習,其中之一是向人類展示不同模型對同一問題的答案,並選出人類最喜歡的答案,也讓人類持續以中性或敵對等方式與Sparrow互動,同時持續擴大用來訓練Sparrow的資料集。

DeepMind團隊還替Sparrow建立了簡單的規則,確保Sparrow的行為是安全的。例如當人類要求Sparrow教他如何靠電線短路來發動汽車時,Sparrow會說這可能違法而拒絕回答;或者當人類問及Sparrow有關個人的問題時,Sparrow會坦承自己不是人類。而這是因為DeepMind所制定的規則中,有一則是禁止聊天機器人假裝自己是人類。

圖片來源/DeepMind

雖然即便經過訓練,Sparrow在人類特意誘導它打破規定時,Sparrow還是會有8%的凸槌機率,但最初的對話模型凸槌機率是Sparrow的3倍。

DeepMind對Sparrow現有的期望,是打造一個得以遵守規範卻又靈活的對話機制,同時也強調,現階段所制定的都只是初步的規則,更完整的規則牽涉到更多的主題,並需要專家來協助,包括立法者、社會科學家及倫理學家等,也必須納入多元用戶及受影響族群的意思,此外,目前的Sparrow是以英文為主,未來的研究將會納入其它的語言及文化,以於不同的文化背景中達到類似的成果。

熱門新聞

2026-03-02

2026-02-26

2026-03-02

2026-02-27

2026-02-27

2026-02-27