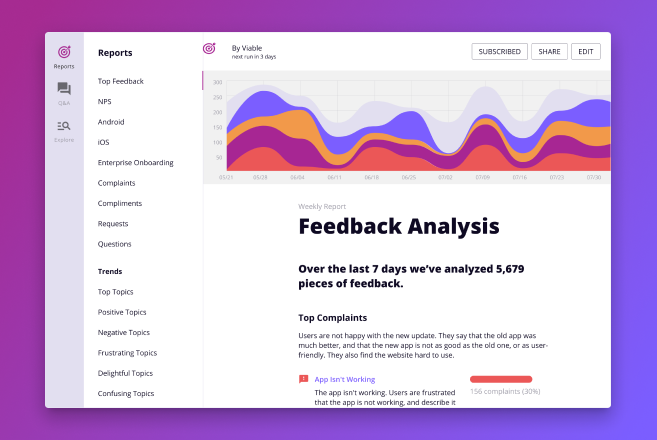

Google發表斷詞新工具,自行設計新演算法LinMaxMatch來加速subword斷詞分析時間,比熱門的HuggingFace斷詞工具快上8.2倍。

螢幕截圖

重點新聞(1231~0106)

Google 斷詞 NLP

斷詞等好久?Google開源新工具加速8倍斷詞時間

Google日前發表一套新英文斷詞工具Fast WordPiece Tokenization,能提高斷詞工作速度達8倍。一般來說,要打造自然語言處理(NLP)應用,得先將文章斷詞(Tokenization),也就是把文章切分為字或更小的單位,將非結構化的資訊轉化為ML模型可消化的序列型資料。在深度學習模型中(如BERT),每個切分過的字(Token)會映射為嵌入式向量,作為模型輸入值。

但,傳統斷詞方法,會將不存在於詞彙表中的生字歸類為未知。為改善問題,現代NLP專家開發出WordPiece系統,可將字切分為更小的子字(Subword)單位,來讓模型有足夠的資訊,推敲出字的意思。

而Google開發一套改良的WordPiece系統,不僅能縮短斷詞時間、降低模型延遲,還能節省算力成本。這個工具有兩大特色,一是單字WordPiece斷詞,Google利用自行設計的LinMaxMatch演算法來加速,讓運算時間隨輸入字串長度而線性成長,有別於傳統方法的次方成長。另一是全流程WordPiece斷詞,不像傳統方法先預斷詞再呼叫WordPiece來進一步斷詞,Google將這兩個流程合而為一,且所需時間也是線性成長。經測試,Google的工具比熱門的HuggingFace工具快上8.2倍,比TensorFlow Text快上5倍多。Google也將這個工具用於自家業務,後來也在TensorFlow Text正式釋出。(詳全文)

英特爾 跨架構 oneAPI 2022

英特爾免費釋出跨架構工具包,主打AI效能最佳化

英特爾日前推出跨架構工具包oneAPI 2022,一口氣涵蓋900多項技術更新,主打跨架構程式設計、AI效能最佳化和生產力優化工具,內含自編譯器、函式庫、預先最佳化框架、分析器、除錯器等工具。就跨架構程式設計來說,oneAPI 2022有個統一的編譯器,可實作C++、Python在CPU和GPU的資料平行處理、SYCL和Fortran,以及建模與微調的進階加速器,還有AI工作流程加速器。此外,該工具包搭配新一代Optimization for TensorFlow與Optimozation for PyTorch,執行深度學習框架的速度快了10倍。(詳全文)

IBM 對抗攻擊 機器學習

ML模型如何抵抗惡意的干擾攻擊?IBM揭露心法

在機器學習模型預測越來越精準的同時,也有一種技術誕生,專門誘導模型給出錯誤的預測,這就是對抗攻擊(Adversarial attacks)。為提高模型抵抗力,IBM團隊展開研究,要找出模型脆弱之處和新風險。

IBM發現,業界抵抗這種攻擊的方法,是用一套垂直聯合學習(VFL)框架,以多種來源的資料訓練模型,並只分享參數和梯度,來保護資料隱私。但這麼做的風險是,可從梯度中被推導出原始訓練資料。IBM也發展出一套攻擊手法CAFE3來驗證,不只能從梯度中還原資料,資料品質還比之前的攻擊手法好。於是,他們建議更好的做法是,利用合成梯度來訓練模型,而且,合成梯度的學習表現不會比真實梯度差。

若是遇到資料污染問題,他們也提出2種解法,首先是依序淘汰不合格的機率,再來是降低獨特數據中,信賴區間的重疊。針對常見的對比學習方法,IBM也提出2個強化韌性的作法,一是讓模型專注於高頻率的訓練資料部分,二是利用特徵分群產生偽標籤。(詳全文)

Meta 模型不確定性 Bean Machine

如何測量模型不確定性?Meta開源Bean Machine函式庫可解題

Meta發布一款基於PyTorch的機率程式開發系統Bean Machine,可用來表達和了解日常ML模型中的不確定性。Bean Machine供使用者開發特定領域的機率模型,並用自動、不確定性學習演算法,來學習模型未觀察到的屬性。

Bean Machine有三大好處,首先是不確定性估計,分析師能更全面掌握預測系統的行為,再來是表現性,Bean Machine能更好地表達結果意義,直接在原始程式碼中編碼模型,讓用戶能將模型的結構對應到問題的結果。最後是可解釋性,因為模型與領域相對應,所以可查詢模型中的中間學習屬性,這代表用戶不僅可使用模型「黑盒子」,還可以對特定預測的結果做出解釋,對於模型開發過程有很大的幫助。(詳全文)

OpenAI GPT-3 客製化

OpenAI API服務開放客製,GPT-3可自行微調來優化

開發人員可用自己的資料來微調語言模型GPT-3了!OpenAI指出,使用者可用來開發適合其應用程式的自定義版本,讓模型能用於更多使用案例中,執行成本更低、速度也更快

OpenAI進一步表示,透過微調,模型輸出的正確率可從83%提升到95%。而要自定義模型也非常簡單,用戶只需要提供資料集檔案,並在OpenAI命令列工具執行單個指令,系統便會自動開始自定義版本訓練,並且在OpenAI API中提供服務。(詳全文)

ONNX Runtime Xamarin 行動App

ONNX Runtime 1.10支援Xamarin,開發者可用來打造AI行動App了

機器學習推理引擎ONNX Runtime 1.10版開始支援.NET框架專屬的行動App開發平臺Xamarin,讓開發者用C#程式語言來開發AI行動應用程式。ONNX Runtime 1.10版本的NuGet套件中,包含了對Android和iOS的支援,賦予開發者打造跨行動裝置AI應用程式的能力。

除了對Android和iOS的支援,ONNX Runtime 1.10的新功能還包括加入X64和ARM64上的新量化核心,提升運算效能。在硬體的靈活度方面,新版本更新了TensorRT、DirectML、OpenVINO和DNNL Execution Providers,在Nvidia GPU上,Python GPU套件同時支援CUDA和TensorRT Provider,讓用戶更容易測試和使用。(詳全文)

商湯科技 獨角獸 上市

7年12輪融資,AI獨角獸商湯科技終於上市了

掛牌上市是不少AI新創的成長目標,2021年進入尾聲的倒數第二天,歷經7年多12輪融資和被美國列入黑名單的幾番波折,中國AI新創商湯科技終於在港交所掛牌上市,市值破256億美元。

商湯科技專門打造智慧商務、智慧城市、智慧生活和智慧汽車等4大領域的AI軟體,專攻深度學習和電腦視覺等技術。7年多來累計開發了22,000個商用AI模型,就算力來說,他們擁有23個超級電腦叢集、2萬多張GPU,總算力達1.17百萬兆次浮點運算。研發人力約3,500多名,其中三分之二正攻讀碩博士,由40位教授帶帶領專案研究。

商湯科技2020年總營收達5億多美元,歷年累積的融資金額高達52億美元。他們將資金大舉投入研究,光2021上半年的研發資金就高達27.8億美元。雖然,2018年至2021上半年營收將近15.7億美元,但同期間累計虧損約38億美元。盈利是商湯科技上市後,面對傳統網路公司和一般企業跨入AI領域競爭外的另一課題。(詳全文)

圖片來源/Google、IBM、Meta、OpenAI

AI趨勢近期新聞

1. Meta AI公布照片修改偵測大賽結果

2. Amazon用深度強化學習打造NLU排名新工具

資料來源:iThome整理,2022年1月

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-03

2026-03-02