| LLM | 串流 | 注意力機制 | Transformer | 語言模型串流應用

高效框架StreamingLLM可處理無限長度文本,解決LLM串流應用困境

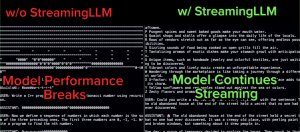

研究人員開發出StreamingLLM框架,使語言模型能夠處理無限長度的文本,解決記憶體消耗與長序列泛化問題,提升在串流應用部署語言模型的可行性

2023-10-05

AWS利用喚醒詞語音資料過濾背景音,使Alexa辨識錯誤率降低15%

AWS透過喚醒詞聲音快照,並將接隨後的語音與之比對,接收到的語音若與喚醒詞吻合,則將該語音視為Alexa要接收的語句

2019-04-23