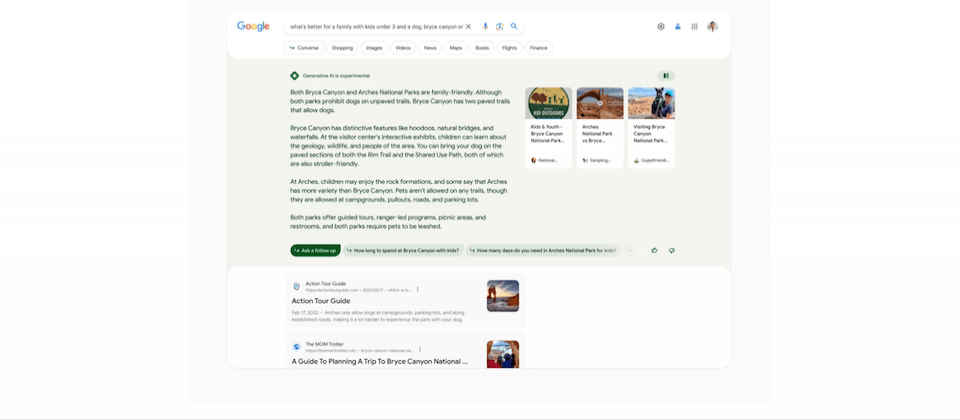

Google將最新大型語言模型PaLM 2用於搜尋摘要新功能,可根據使用者的搜尋關鍵字,快速給出摘要。

重點新聞(0505~0511)

Google LLM PaLM 2

Google新模型PaLM 2驅動了哪些新服務?盤點I/O大會LLM新進展

Google在今年度I/O技術大會上揭露新版大型語言模型PaLM 2,並用這個模型來驅動近25款新功能和服務。PaLM 2用大量的網路文件、書籍、程式碼、數學問題和對話訓練而成,所學習的語言超過100種,功能比第一代更強大,比如它能看懂Fortran這類老舊的程式碼,不僅能改程式,還能用任何語言附上程式的技術文件。

Google也用PaLM 2來驅動許多新功能和服務,比如Google搜尋的生成式體驗功能,可快速根據使用者輸入的搜尋關鍵字,來摘要相關資訊,給使用者參考。此外,PaLM 2也用來驅動Duet AI功能,也就是Google辦公工具中的AI功能,如Gmail的輔助撰寫功能,使用者下提示就能讓AI給出建議內容。另,PaLM 2也用於聊天機器人Bard,來優化其程式碼處理、翻譯和推理的能力。同時,Bard也新添日語和韓文,Bard目前也正式對大眾開放。

不只如此,Google也打造一款PaLM 2的衍生模型Codey,並用於最新的Android Studio Hedgehog程式碼開發助理Studio Bot,來提供程式碼編寫協助、查詢相關資源。PaLM 2有多種版本,其輕量版在手機上就能執行,還有一種是針對醫學用途的版本Med-PaLM 2,可回答、整理醫學相關問題。另一方面,Google也正訓練新一代LLM,這款模型名為Gemini(雙子座),可執行多模態任務。(詳全文)

3D物件 OpenAI 自然語言

文字生成圖像還不夠,OpenAI開源3D物件生成模型

這兩年生成式AI風生水起,大多仍鎖定文字生成文字或圖像,但OpenAI最近嘗試新領域,打造並開源一款3D物件生成模型Shap-E,可根據文字輸入,來產出3D物件。雖然Shap-E產出的3D物件較粗糙,但它與其他只產出單一表徵的3D物件生成模型不同,可直接生成隱式函數的參數,這些參數可用單一文字提示,來渲染出紋理網格和神經輻射場(NeRF)。

OpenAI用2階段來訓練Shap-E,首先,他們先訓練一個編碼器,來將3D資產映射到隱性函數的參數。接著,團隊用編碼器的輸出值,來訓練一個條件式擴散模型。團隊表示,用大型的3D物件-文字資料集來訓練模型,就可在短短幾秒內生成外型複雜的3D物件。

OpenAI表示,與自家先前打造的3D物件生成模型相比Point-E,Shap-E還有個特點,就是即便用更高維度、多表徵空間來對Shap-E建模,它卻能更快生成品質更好的3D物件。不過,除了生成的3D物件偏像素化、看起來粗糙,Shap-E還有個限制,就是只能根據單一物件提示和簡單的屬性產出3D物件,這是團隊有待進步的空間。(詳全文)

Mojo Python 開發語言

AI開發新語言Mojo速度可比Python快35,000倍

新創公司Modular AI發表新程式語言Mojo,號稱具備Python的可用性和C語言的高效能。而且,Mojo可直接存取AI運算硬體,運算效能大幅超越Python,甚至在執行特定演算法時,Mojo比Python快上35,000倍。

Modular AI指出,Python雖是一個強大的語言,也支援各種AI研究,但可擴展性是最大缺點。Python難以用於大型工作負載,也無法在邊緣裝置中順暢執行,還是得靠C++和CUDA等其他語言。而Mojo建立在現代編譯技術上,具備類型設計,大幅增加程式執行速度,也能讓開發者定義零成本抽象,並擁有類似Rust語言的記憶體安全性。

特別的是,Mojo還擁有自動調校和編譯時後設程式開發功能,可分別在程式編譯過程中自動最佳化程式效能,以及在程式編譯階段時,對自身結構和行爲進行調整,生成更高效的程式碼。此外,Mojo還能直接與AI硬體溝通,如存取執行緒、TensorCores和AMX擴充等低階硬體功能,速度比Python要快上許多。(詳全文)

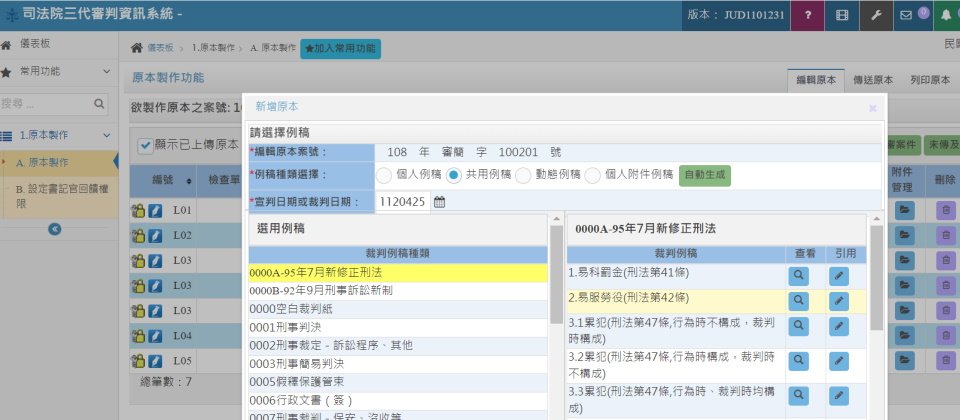

司法院 裁判書 生成式AI

司法院用生成式AI打造裁判書自動生成工具

為減輕法官工作負擔,司法院開始用生成式AI來打造裁判書自動生成工具,來讓各法官使用。這是因為,司法院統計,刑事法官每月平均處理數十件案件,不只要開庭,還要花許多時間來寫裁判書。為此,司法院試用生成式AI打造裁判書生成工具,可針對酒駕、幫助詐欺、毒品案件等3種犯罪類型來產生,其中,前2種使用類似Google的T5模型,來訓練出一個通用的預訓練模型,再以此通用模型為基礎,在裁判書生成任務上進行模型微調;後者則參考GPT-2版本、運用多項自然語言處理(NLP)、演算法與知識圖譜等技術而開發。

為訓練這些生成式模型,司法院用大量裁判書和檢察官起訴書作為訓練資料,讓這些模型來學習不同法官的寫作風格,同時理解法官判決書中各段落對應的關係。因此,以生成式AI模型產生的裁判書的草稿包含更多細節,例如起訴書的犯罪事實、判決理由等,這有助法官更快速地完成裁判書的撰寫。該工具預計年底前上線。(詳全文)

AI可解釋性 OpenAI GPT-4

AI可解釋性新成果,OpenAI用GPT-4解釋語言模型行為

OpenAI用GPT-4大型語言模型來解釋大型語言模型神經元的行為,並對這些解釋進行評分,來評估解釋的品質。有別於仰賴研究者手動檢查模型神經元的傳統方法,OpenAI採用GPT-4來自動生成語言模型神經元的行為解釋,簡單來說可分為3步驟,首先是產生結石,也就是給定一個GPT-2神經元,來向GPT-4展示相關的文字序列和活躍情況,讓GPT-4生成解釋神經元行為的文字。

第二步則是用GPT-4模擬神經元行為,來了解解釋中的神經元活躍原因。最後一步是比對、模擬和真實情況的差異,來對解釋評分,衡量解釋的可靠性和準確性。這項可解釋性研究,不只要讓用戶和開發者更了解AI運作的原理,也要讓研究者更理解模型的偏差與錯誤。不過OpenAI坦言,透過GPT-4自動生成並評分神經元行為的方法,對大模型的效果並不好;雖然目前許多解釋獲得分數都很低,但是OpenAI認為,未來模型解釋能力可再提高。(詳全文)

BigCode Copilot 程式碼

BigCode發表效能超越初代Copilot的程式碼生成模型

開放科學協作組織BigCode最近釋出150億參數的大型語言模型StarCoderBase以及為Python調校的StarCoder模型,可自動寫完程式碼、根據指令修改程式碼,也能用自然語言解釋程式碼片段。這兩個模型都使用大量GitHub上授權的程式碼來訓練,是目前所有開放程式碼生成模型中效能最佳的模型,甚至超越GitHub Copilot初期版本所使用的OpenAI code-cushman-001模型。其中,StarCoderBase的訓練資料非常多樣,涵蓋80多種程式語言、Git提交、GitHub問題和Jupyter筆記本,共有1兆文字單位(Token)來讓模型學習。

同時,BigCode也用350億個Python Token微調,產出StarCoder模型。StarCoder可處理的輸入量比其他大型語言模型要多,可接受高達8,000個Token,還支援更多樣的應用,如經過一系列對話指示,來讓StarCoder成為技術助理。經Python基準測試HumanEval評估,團隊發現,無論是StarCoderBase還是StarCoder,模型規模都較PaLM、LaMDA和LLaMA小得多,但是表現卻更好。(詳全文)

Meta 廣告製作 生成式AI

Meta推出廣告製作測試中心AI Sandbox

Meta最近推出廣告製作測試中心AI Sandbox,可用來實驗各種廣告內容製作的功能與工具,包括運用生成式AI的廣告工具,像是文字變體、背景生成和圖像剪裁。其中,文字變體可用來產生不同版本的文字,來凸顯廣告文案的重點,廣告主可針對不同受眾提供不同訊息。背景生成則可用文字輸入來產生背景圖像,廣告主可快速嘗試不同背景。

圖像剪裁功能可調整各種創意資產,來適應不同的廣告露出,如Stories或Reels。目前Meta只與少數廣告主共同測試AI Sandbox、蒐集意見,他們預計在7月開放更多的廣告主加入,也會增加AI Sandbox測試的功能。(詳全文)

圖片來源/Google、OpenAI、司法院、Meta

AI近期新聞

1. Google文字轉音樂AI工具MusicLM開放公測

2. Google更新TensorFlow機器學習工具,簡化模型部署與訓練

資料來源:iThome整理,2023年5月

熱門新聞

2026-03-13

2025-06-02

2026-03-14

2026-03-13

2026-03-13

2026-03-13

2025-04-15

2026-03-16