逢甲大學

重點新聞(0930~1006)

逢甲大學 電子避震系統 道路缺陷

逢甲大學打造國產AI避震系統,更開發全球首款道路缺陷樣本資料庫

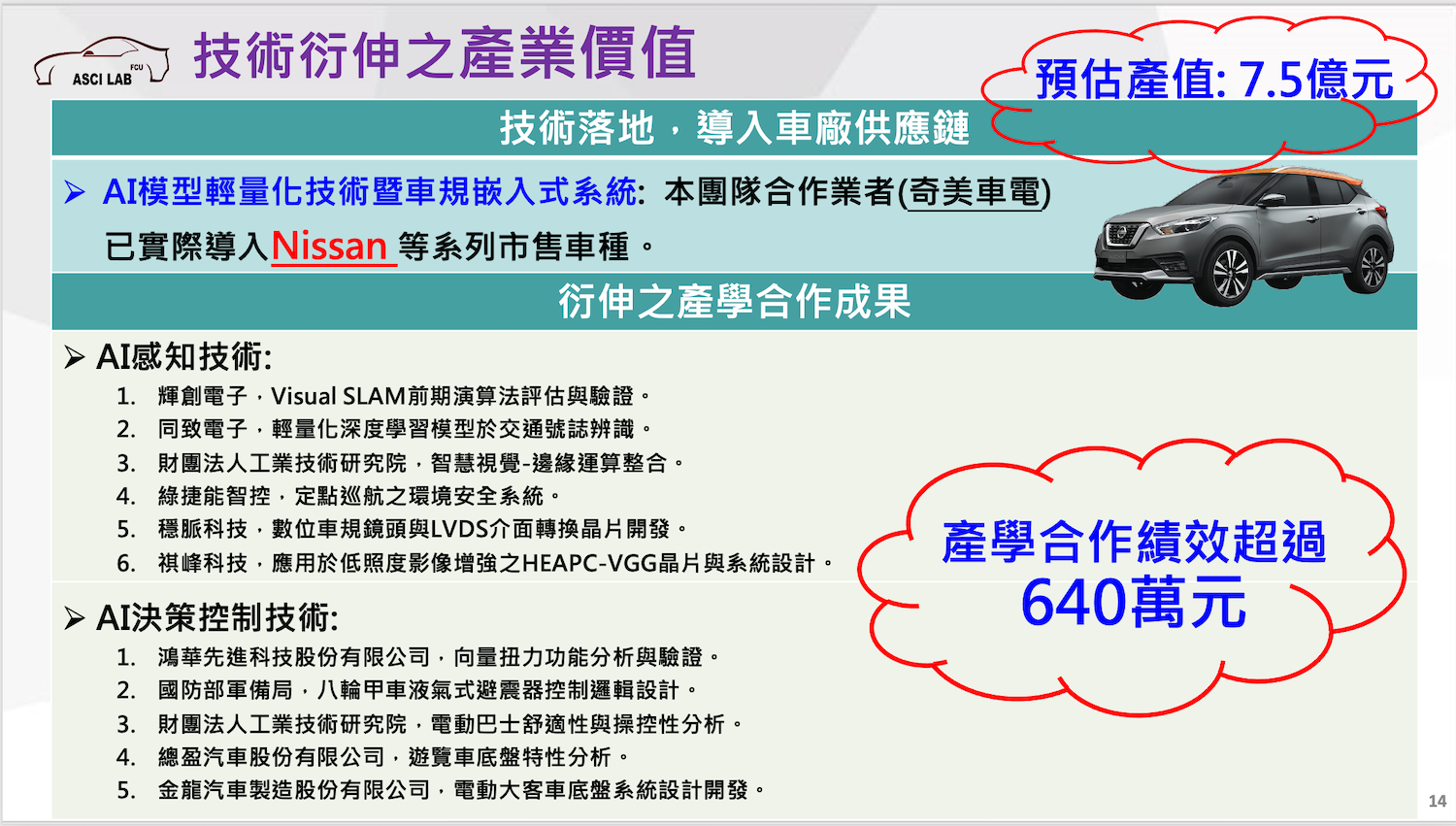

在國科會4年資助下,逢甲大學副教授林昱成團隊打造出國產自駕車電子避震系統,結合AI道路缺陷感知系統和AI決策控制晶片系統,可即時辨識車前20公尺的6種道路缺陷(適用於車速100km/hr以下),讓避震系統根據不同路況來動態調控,更通過ISO26311乘坐舒適性測試,滿足乘車體驗和車輛操作穩定性要求。該系統的出現,意味著臺灣有能力自產車電尖端感知和控制技術,也代表國產技術融入車輛產業供應鏈。

進一步來說,為訓練道路缺陷感知AI,團隊收集了常見的6種道路缺陷影像作為訓練資料,包括坑洞、人孔蓋、減速坡、積水、伸縮縫、水坑,共89,723張照片,打造出全球首套道路缺陷樣本資料庫(TPDID),未來還能延伸應用至東南亞複雜的交通情況。團隊也透露,未來也可透過道路缺陷感測,即時將缺陷資訊通報給道路養護單位,提高道路修補效率。

另一方面,團隊開發出的強化學習決策控制系統,能根據道路缺陷偵測結果來調整避震系統。比如,當車輛行經坑洞或減速坡時,系統會動態調整避震器,來提高乘坐舒適性和懸吊耐久性。此外,這兩套AI系統所搭配的硬體零組件皆為國產,如電磁閥可調阻尼驅動電路、空氣彈簧驅動電路;這些系統也已導入Nissan系列車種。(詳全文)

DeepMind 矩陣乘法 演算法

DeepMind新AI系統可找出更快的矩陣乘法新演算法

DeepMind打造一款AI系統AlphaTensor,以擊敗全球三大棋藝AI的AlphaZero為基礎,可用來找出更有效率的矩陣乘法演算法。DeepMind認為,AlphaZero不只可用在遊戲上,也能用來解決懸而未決的數學問題。

AlphaTensor是AlphaZero的延伸,AlphaZero是個完全未經訓練的神經網路,經自我對戰來進行強化學習,而奠基於此的AlphaTensor,一開始也未被灌輸任何既有的矩陣乘法演算法,而是藉自我學習,來重新發現歷史上各種快速的矩陣演算法,且最終超越人類,找到比現今更快的演算法。不只如此,DeepMind也用AlphaTensor來替特定的硬體尋找最佳演算法,像是Nvidia V100 GPU與Google TPU v2,而AlphaTensor也在同樣的硬體上,在乘以更大矩陣的速度上比常用的演算法快了10%~20%。(詳全文)

IBM 邊緣運算 裝置端訓練

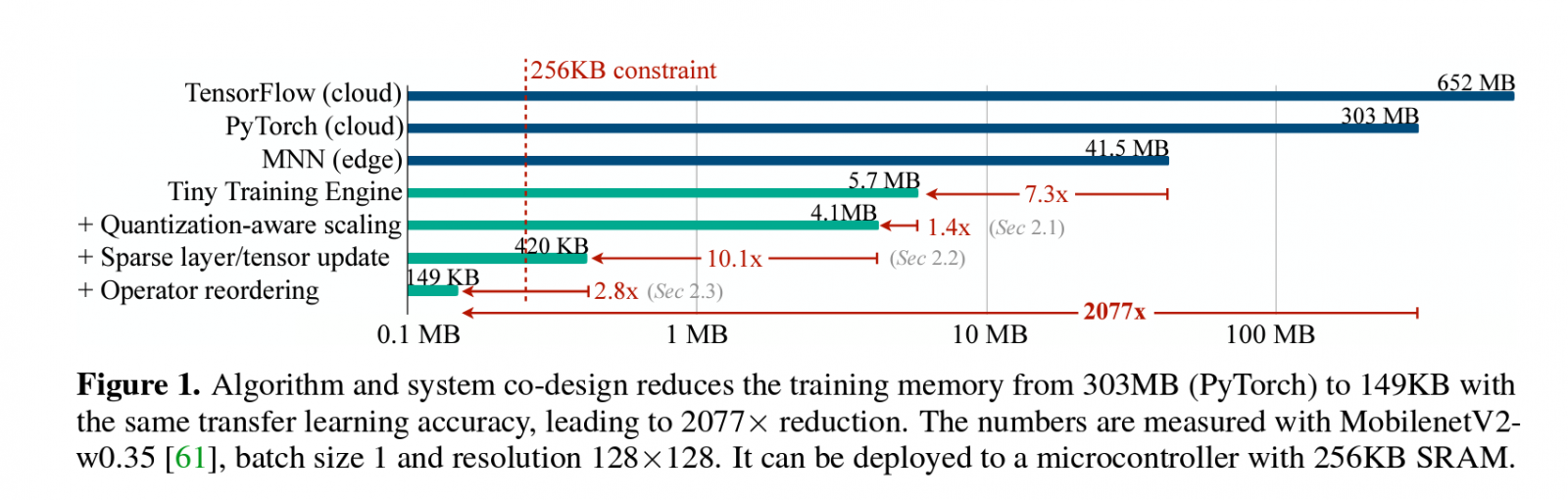

IBM聯手MIT打造邊緣運算新方法,在裝置用新資料微調模型只需256KB記憶體

IBM與MIT發表一系列邊緣運算輕量級技術,在裝置端微調預訓練模型只需256KB記憶體。團隊表示,一般來說,小型IoT設備難以直接利用裝置端感測器搜集的新資料,來更新模型;這包含兩個問題:類神經網路量化圖因混雜的單精度和缺乏正規化,而難以優化,另一個是硬體資源(如記憶體和算力)不足以用於反向運算。

為解決問題,團隊先設計稀疏更新(Sparse Update)演算法,來跳過不重要的層與子張量梯度運算,再用自建的訓練系統Tiny Training Engine來實作。該系統修剪了反向運算張量,來支援稀疏更新,並將執行時間的自動微分卸載到編譯時間。團隊表示,他們的框架可用於IoT裝置(如SRAM只有256KB的微型控制器),來透過遷移學習執行視覺辨識任務,所使用的記憶體是現有框架的百分之一,但準確度與雲端訓練、部署在邊緣的tinyML應用程式VWW一樣。特別是,這款框架不僅能讓IoT裝置推論模型,還能讓模型在裝置端,根據新資料來微調,實現不間斷的學習。(詳全文)

漢莎航空 Google 準點率

漢莎航空運用深度學習預測瑞士白斯風提高航班準點率

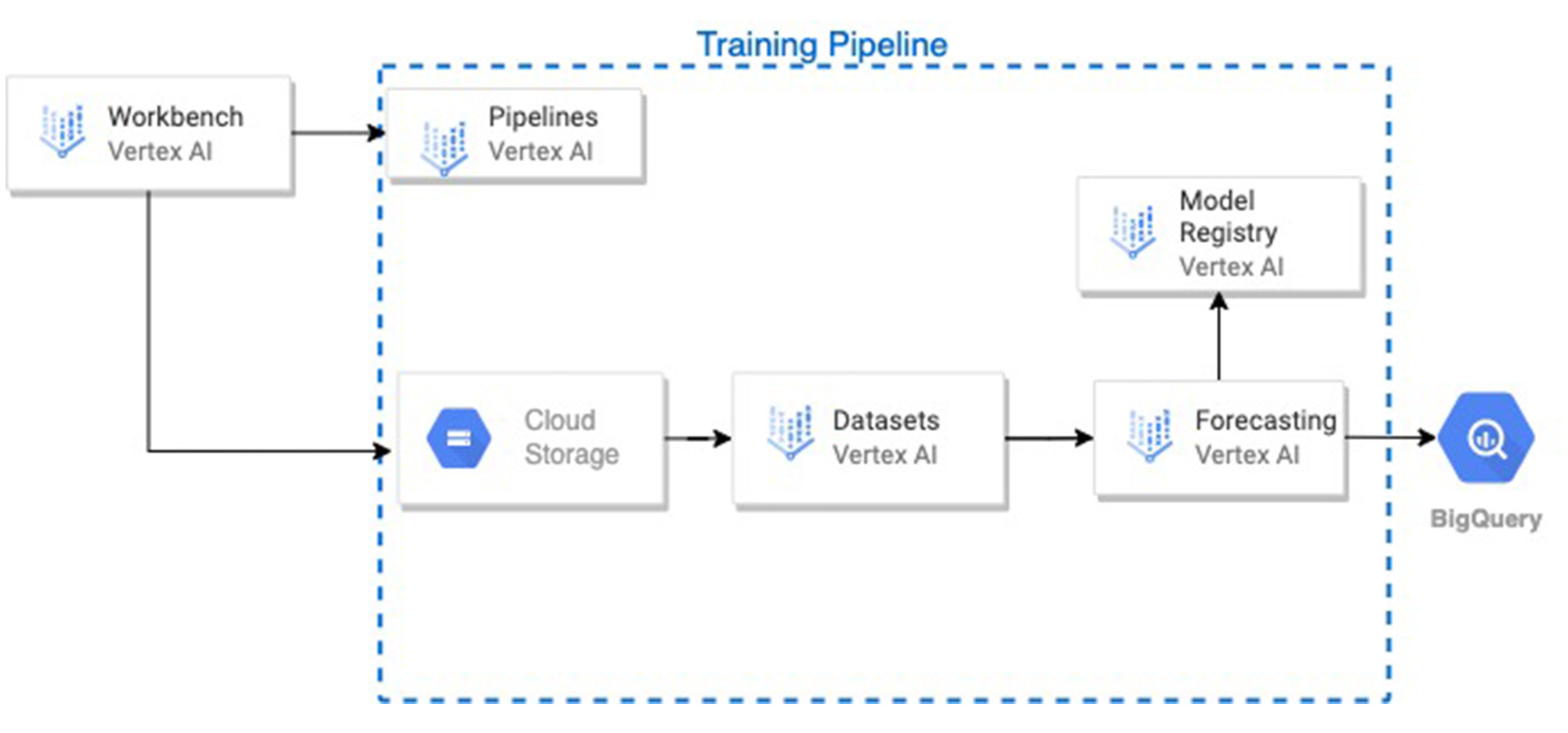

漢莎航空與Google公開新一波合作成果,透過預測機場跑道的風速,來提高航班準點率,不只降低營運損失,也提升乘客體驗。風的大小和風向對機場運作有重大影響,在瑞士有種白斯風(BISE),又冷又乾,會嚴重影響航班時刻、迫使飛機改道,甚至導致航班延誤、取消。

這種狀況在蘇黎世機場特別嚴重,不只對漢莎航空造成數百萬美元的損失,同時也會引發乘客不滿。於是,漢莎航空和Google採用Meteoswiss模擬資料,也就是瑞士多個氣象站過去5年來收集的氣象測量值,以每10分鐘的解析度,獲得風向、速度、壓力、溫度和濕度等天氣資料,以及氣象站位置海拔高度等資訊。但因為白斯風並非直接可用的變數,因此團隊設計跑道周圍的順風速度作為代理目標變數,當此數值高於特定閾值,就表示跑道會出現白斯風。

雙方也在Google全託管機器學習平臺Vertex AI建立專案,實驗結果顯示,新系統給出的預測,優於漢莎航空原有的啟發式演算法,且隨著預測的時間加長,出現了明顯的效能差異,新系統能夠獲得更高的召回率和精確度。漢莎航空計畫將這個預測白斯風實驗性專案,整合到營運決策支援套件中,供蘇黎世克洛滕機場營運控制中心使用。(詳全文)

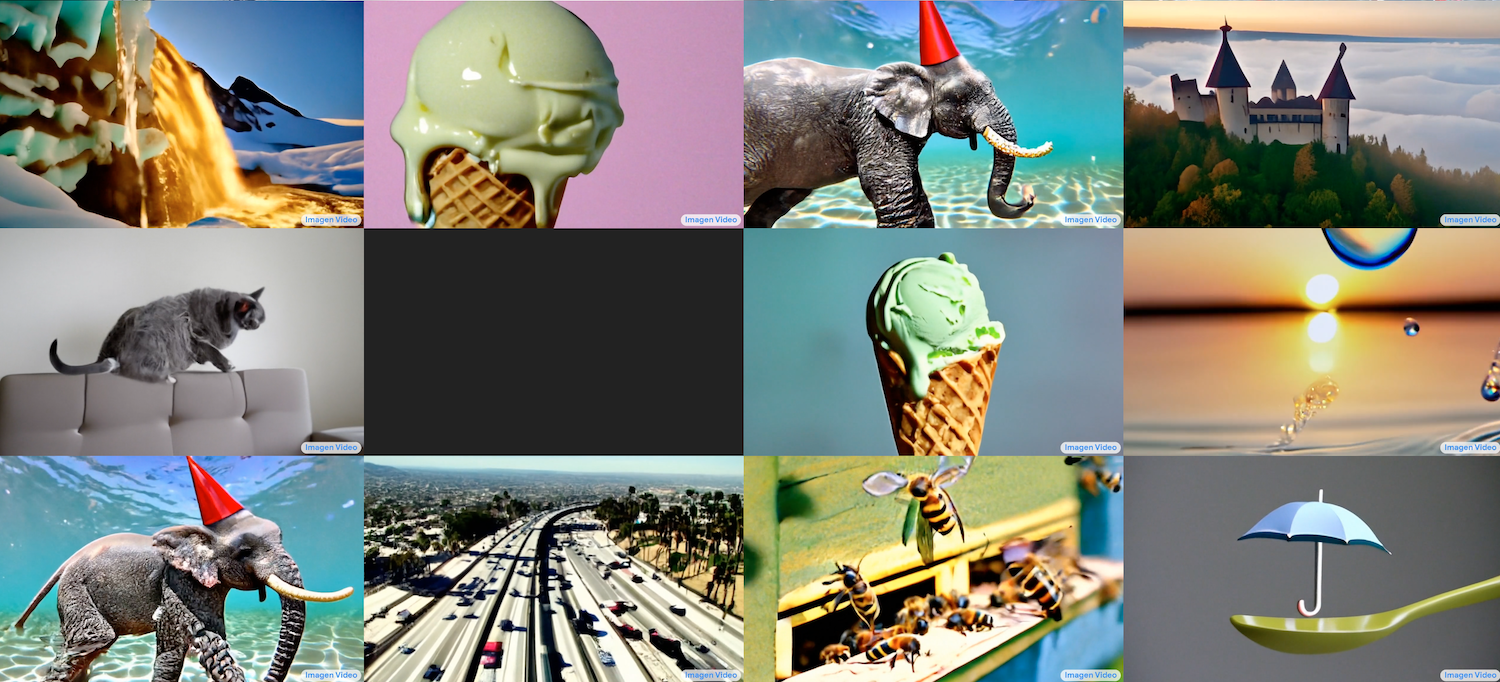

文字轉影片 Imagen Video Phenaki

Google發表兩款文字轉影片工具

Meta上周才發表文字轉影像AI系統,Google近日也推出兩款文字轉影片工具:Imagen Video和Phenaki,分別主打影片品質和長度。其中,Imagen Video是以Google先前開發的Imagen文生圖模型為基礎,採串連擴散模型來產出高解析度的影片。具體方法是先透過自然語言預訓練模型T5嵌入使用者輸入的文字,再由一個基本的影片擴散模型,以每秒3幀的速度產生一個解度析為24x48的16幀影像,之後再用多個TSR與SSR模型,最終產生每秒24幀、總長128幀且解析度高達1280x768的5.3秒影片。

至於Phenaki則可產出總長數分鐘的影片,只是影像品質不如Imagen Video。Phenaki可將一段特定長度的提示文字,轉換為任意長度的影片。不過,Phenaki產出影片非常貼近文字敘述,且Google認為它不僅可用來產生描述單個概念的影片,還能可根據一系列文字,產生連貫的多個影片。有鑑於用來訓練Imagen Video的資料中可能含不適當的內容,Google目前不打算開源該模型。(詳全文)

Meta 加速推論 AITemplate

Meta開源可加速程式碼執行的推論系統AITemplate

Meta最近開源一款服務AITemplate(AIT),可將深度神經網路轉為C++程式碼,來加速模型推論。AIT是一個Python框架,目前支援Nvidia、AMD的GPU,未來也可能支援英特爾GPU產品。

Meta AI研究院指出,目前AI業者的高效能GPU推論解決方案選擇非常有限,且AI正式部署流程需要快速開發,因此他們開發一套加速系統,來解決問題。AITemplate有2大特色,分別是高效能,以及統一、開放與靈活。它在Nvidia TensorCore GPU和AMD MatrixCore GPU上執行各主要模型的效能,都達到Roofline FP16,如ResNet、MaskRCNN、BERT、VisionTransformer與Stable Diffusion等。此外,它適用於Nvidia GPU或AMD GPU的FP16深度神經網路模型,且完全開源。這意味著AITemplate在Nvidia與AMD的GPU上執行各種AI模型時,可達到近似於原生硬體的效能,相較於PyTorch中的Eager模式,AITemplate在Nvidia CPU的效能改善了12倍,在AMD GPU上改善了4倍。(詳全文)

AI權利法案 OSTP 退出權

美發布AI權利法案藍圖,5大指引保障人民權利

美國白宮科技政策辦公室(OSTP)最近發布AI權利法案藍圖,要來引導AI與其它自動化系統的設計、發展與部署,保障美國人民的權利。該法案最終目標在於,利用AI推動進步和保護人類之間取得平衡。該法案藍圖包含5大保護原則,也就是建立安全與有效的系統、避免演算法歧視、保護個人隱私、闡明自動化系統的依據與用途,以及允許使用者退出。OSTP希望,此一藍圖在AI系統建置之前,就嵌入對人類的保護,讓被邊緣化的社群於開發過程中擁有發言權,也讓設計者可確保AI技術能嘉惠所有人。(詳全文)

吳恩達 機器學習 迭代

吳恩達:迭代是開發ML產品的關鍵

AI專家吳恩達指出,打造AI產品的一大關鍵是迭代。因為,開發機器學習系統,本身就是一個高度迭代的過程,比如先建立一個雛形,再做實驗衡量其表現,接著分析結果,以此為基礎、打造更好的系統。甚至在資料收集、訓練模型、開發系統等階段,都得不斷重複這個輪迴,直到產品成形。

他點出,開發ML系統需要迭代是因為,剛展開一個專案時,開發者並不知道會從資料中找到什麼奇怪或讓人驚豔的結果,因此需要一直探索,才能做出改善模型的好決策。再來,嘗試不同模型既快速又低成本。特別是,迭代在3種情況下更能體現好處:當開發者面對不確定性或風險時,又或是在建置系統、可提供有意義的回饋來降低不確定性或風險時,以及每次迭代的成本不高時。

這也是吳恩達推崇「最小可行性產品」(MVP)的原因,因為它講求用最低成本快速推出一項產品,與開發軟體一樣,可幫助開發者在開發過多無用的功能前,透過使用者回饋先來修正產品。(詳全文)

圖片來源/逢甲大學、Google、IBM、DeepMind

AI近期新聞

1. 特斯拉推出人形機器人,最快明年量產

2. Google打造音檔生成AI系統AudioLM

資料來源:iThome整理,2022年10月

熱門新聞

2026-03-06

2026-03-11

2026-03-06

2026-03-10