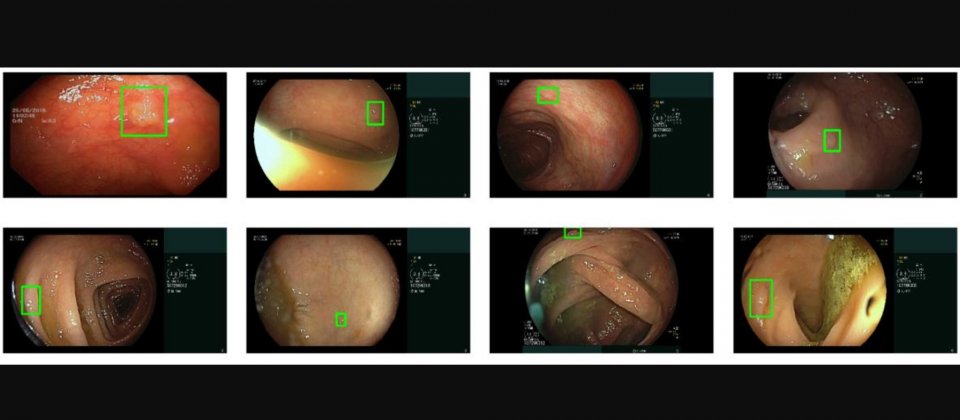

Google發表了最新將機器學習用於大腸鏡的研究,研究人員開發了一個機器學習模型,能夠幫助醫療人員在大腸鏡檢查中精確偵測息肉,以解決檢測不完全的問題。這個最新的研究,建立在早先的研究上,之前Google研究人員已經開發了一個系統,來最大化大腸鏡檢查範圍,避免醫療人員遺漏部份腸段未檢查。在臨床研究中應用這些系統,結果顯示能夠顯著提升息肉偵測率。

要檢測和去除大腸息肉的標準程序之一,便是進行大腸鏡檢查,在大腸鏡檢查過程,醫療人員使用內視鏡來檢查腸道中,尋找良性以及癌變的息肉,但因為各種因素,可能使得大腸鏡檢查不完全,像是息肉沒有被內視鏡照到,又或是息肉可能因為形狀或是大小的關係,即便出現在內視鏡視野中,也可能遭到遺漏。研究也顯示,大腸鏡檢查平均會遺漏22%-28%的息肉,而其中20%–24%的息肉有機會癌變。

在之前的研究中,Google研究人員已經開發了機器學習系統,來解決大腸鏡探索不完全的問題,透過在檢查期間,估計覆蓋與未覆蓋的區域,來降低不完全探索的機率,而新的這個研究,是要來解決當息肉出現在大腸鏡視野中,卻未被發現的問題。

研究人員開發了一個基於卷積神經網路(CNN)的系統,這個系統有2個主要優點,分別是能解決因為息肉難以發現,而產生偽陰性檢查結果的問題,另一個優點則是,該系統偽陽性率非常低,研究人員提到,偽陽性率使得系統更有可能被應用在臨床中。

研究人員使用了3,600段大腸鏡檢驗,約有8,600萬個影格來訓練系統,並且準備了1,400段的檢查過程,約3,300萬個影格進行測試,該系統能夠檢測出97%的息肉,在每段檢測僅會出現4.6次誤報,經過進一步的分析,部分誤報其實是有效的息肉偵測,只不過內視鏡檢查者以及資料註釋人員遺漏了這些息肉,研究人員提到,這個系統被證明在檢驗息肉上具備通用性,因為已經學會偵測那些,一開始遭到遺漏的息肉。

這些實驗是模擬息肉在視野中不超過5秒的結果,而這樣的檢查速度,會使醫療人員更難以發現息肉,因此系統的靈敏度,約是原始檢查的3倍,而當息肉出現在視野中不到2秒,則系統靈敏度更是原始檢查的4倍。

研究人員在這個大腸鏡息肉檢查系統,試用了2種神經網路架構RetinaNet和LSTM-SSD,RetinaNet是一種先進的靜態圖像物件偵測技術,能將其應用在連續影格偵測,在基準測試中,RetinaNet以平衡的運算速度以及精確性著稱,而LSTM-SSD是一種影片物件檢測架構,可以處理一些影片的時間特徵,像是模糊或是快速運動等狀況,其非常輕巧,可以在低成本的處理器上運作。研究人員提到,根據不同需求,可以選擇不同的神經網路,但都能獲得良好的結果。

目前這套系統已經進到醫療中心,實際用於100個大腸鏡檢查中,研究人員提到,這套系統降低排除息肉的時間,而且不會讓醫療人員遺漏任何的息肉,雖然每次檢測平均有3.8次誤報,但是醫療中心目前對該系統的回饋是正向積極的。

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-04

2026-03-03

2026-03-02