微軟

微軟昨(1)日宣布Deepfake影像分析技術Video Authenticator,以及能夠辨識媒體內容是否經過人為變造的工具,分享給新聞媒體使用。

現今以AI製造假影片、假新聞影響大眾愈來愈氾濫,微軟贊助的普林斯頓大學研究顯示,2013到2019年在社交網站進行的假新聞宣傳,針對美國者占26%最大宗,但臺灣、德國、法國、沙烏地阿拉伯、巴西等國也是目標國家。

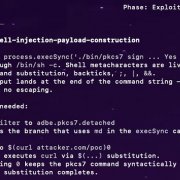

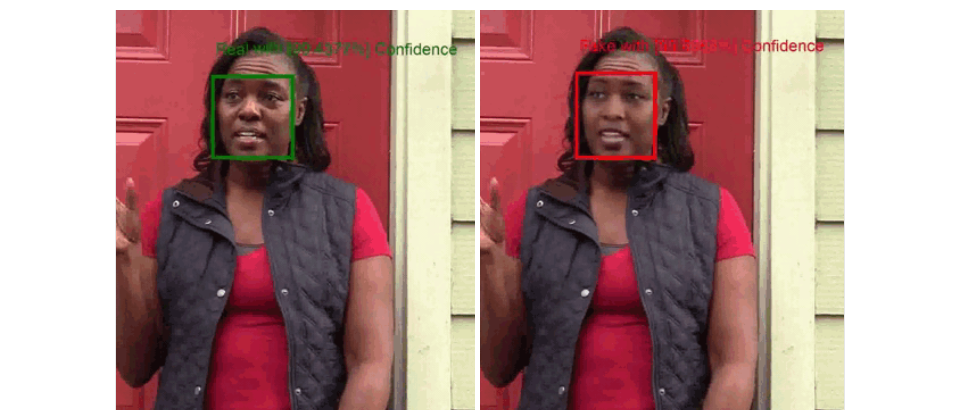

為了打擊假新聞以及防止假新聞干擾美國總統大選,微軟發展了兩種技術。首先,針對Deepfake,包括以人工智慧(AI)變造出以假亂真的相片、聲音和影像,微軟宣布Microsoft Video Authenticator,可即時分析靜態相片或影片,並提供變造的機率或信心分數。微軟客戶安全暨信賴方案副總裁Tom Burt和科學長 Eric Horvitz指出,這項技術原理是偵測影片及相片中,影像合成時肉眼看不到的邊緣接合痕跡,以及細微的糊化或灰階元素來判定是否為合成影片/相片。

Microsoft Video Authenticator技術最初是由微軟研究院偕同微軟責任AI(Responsible AI)、微軟工程與研究AI、倫理與效果(AI, Ethics and Effects in Engineering and Research,AETHER)委員會共同開發。利用義、德大學合作的 Face Forensic++公開資料集開發而成,並以臉書及微軟合作的Deepfake辨識技術挑戰賽蒐集的10萬則影片驗證。

另外微軟也指出,現今幾乎沒有工具可幫讀者判斷線上內容來源是否可信賴,內容是否經過變造,因此也同步宣布一組偵測媒體內容變造的工具。

這項工具是由微軟研究院、Azure部門與捍衛民主計畫(Defending Democracy Program)開發而成。它包含兩個部分。一是內建於Azure中,可讓內容製作人產製媒體內容時,於某個部分加入數位雜湊及憑證,這東西可變成內容metadata的一部分,即使傳送也會帶著走。第二部分則是一個讀取器,可以實作成瀏覽器外掛,或其他形式。它能檢查憑證及比對雜湊值,讓接收者可確定內容的真實性、不是變造出來的,還能查看關於內容產製者的資訊。

微軟表示已和舊金山的AI基金會合作,用於後者防範假新聞干擾大選為宗旨的Reality Defender 2020計畫,將Video Authenticator提供給相關單位使用以辨識Deepfake影片,像是競選團隊和新聞記者。

至於偵測媒體內容真偽的工具,微軟也將用於英國公共電視BBC七月宣布的Project Origin中,將供BBC、加拿大CBC/Radio-Canada、及紐約時報使用,並測試工具的效果。而包含華盛頓郵報、美聯社的信賴新聞計畫(Trusted News Initiative)也會加入使用。微軟表示接下來會再擴大,把更多科技、媒體及社交平臺業者拉進這項打擊假新聞的計畫。

微軟也宣布和USA Today、華盛頓大學、辨識Deepfake的工具商Sensity等單位合作,提供辨識Deepfake影像及假新聞的媒體素養教育內容、遊戲等。另外,微軟也提供Edge外掛NewsGuard,後者針對新聞網站是否包含假新聞提供燈號,所有標準瀏覽器都可免費下載其外掛。

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-02-26

2026-03-02

2026-03-02