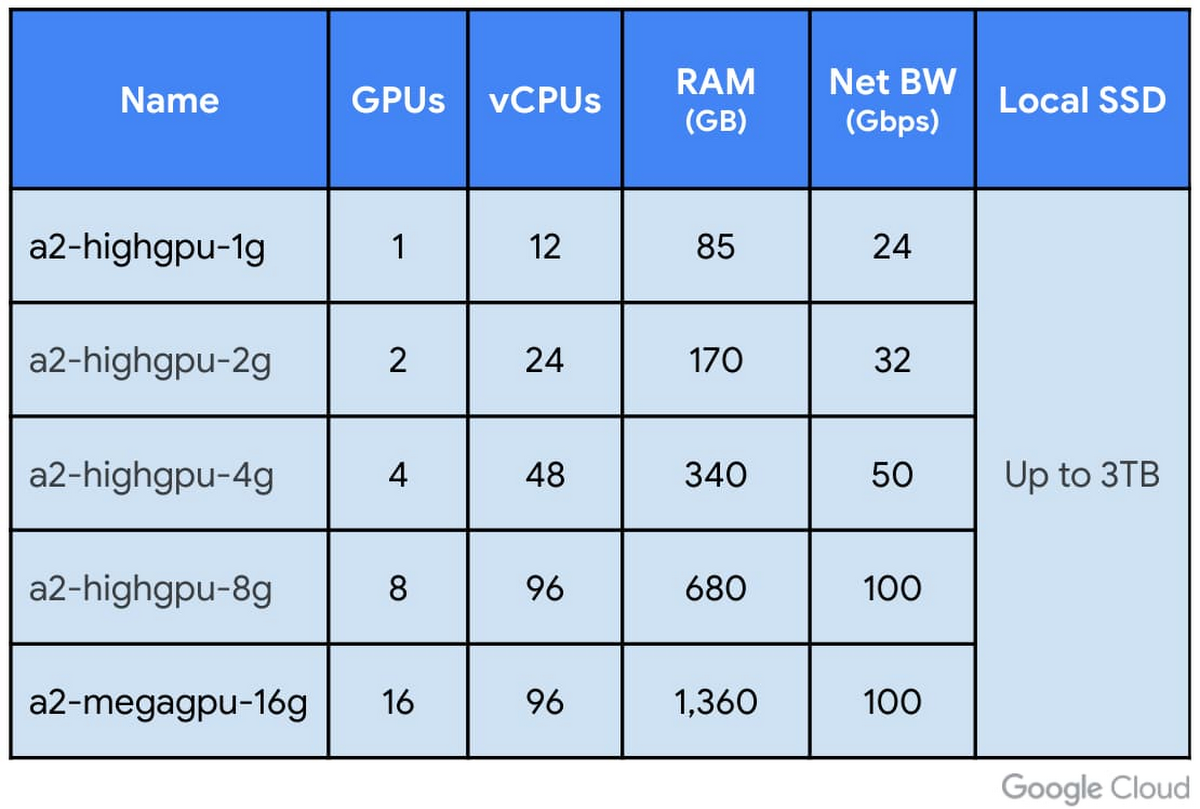

Google宣布在Compute Engine中,推出採用Nvidia新GPU A100的虛擬機器A2系列,該系列目前有5種規格,最高規格a2-megagpu-16g搭載16顆A100 GPU,且擁有1.3 TB的系統記憶體,FP16精度運算能力達10 Petaflops。

A100是Nvidia在今年5月才推出的資料中心級GPU,其採用全新的Ampere架構,與上一代Volta架構的V100相比,A100使用新的Tensor Float 32格式,其運算速度比使用FP32的V100快10倍,而且還具有增強的16位元數學運算能力,能以比TF32快兩倍的速度,支援FP16與BF16,A100除了INT8,還支援INT4與INT1的張量運算。

而且A100還提供多重執行個體群組功能(Multi-Instance Group,MIG),可以將1個GPU劃分成最多7個執行個體,每個執行個體間效能以及故障相互完全隔離。每個A100 GPU提供的效能,可比上一代多20倍,而且還搭配了40 GB的高效能HBM2 GPU記憶體,Google提到,搭載A100的新虛擬機器系列A2,適合用來處理諸如CUDA機器學習訓練和推論,以及高效能計算等運算密集的工作。

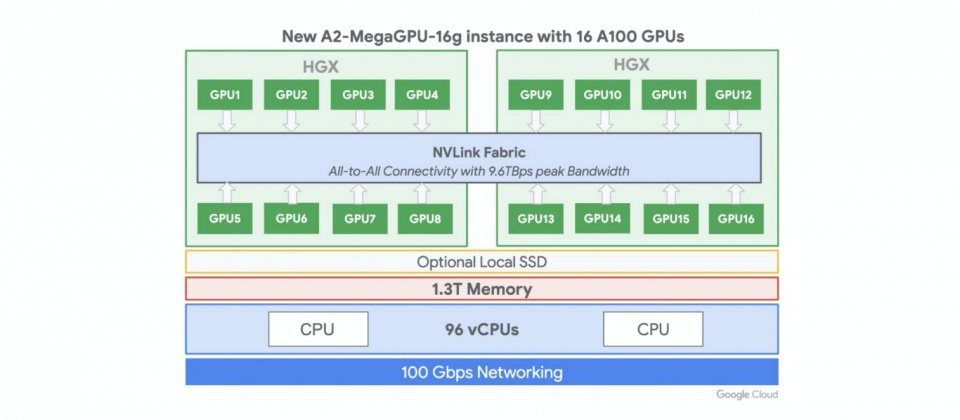

為了加速多GPU的工作負載,A2系列使用了Nvidia HGX A100所使用的高速NVLink,GPU對GPU頻寬高達600 GB,A2虛擬機器可選搭配96個英特爾Cascade Lake vCPU、本地端SSD和100 Gbps網路連結。特別的是,A2虛擬機器在底層GPU伺服器平臺架構提供vNUMA(Non-Uniform Memory Access)透明性,可以讓使用者執行進階的效能調校。

A2系列提供了5種規格,最低規的a2-highgpu-1g使用1個A100 GPU,搭配12個vCPU和85 GB的系統記憶體,而最高階的規格a2-megagpu-16g,則一次搭載16顆A100 GPU,擁有640 GB的GPU記憶體,並使用96個vCPU配置1.3 TB的系統記憶體,NVLink總頻寬高達9.6 TB/s,這個效能怪獸單個執行個體,能以FP16精度提供10 Petaflops運算能力,而Int8更高達20 PetaOps。

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-03

2026-03-02

2026-03-02