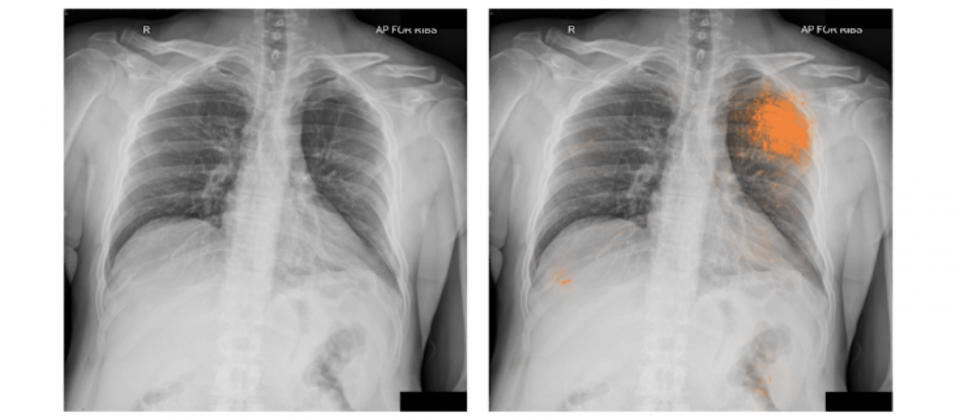

Google發表論文,以深度學習判讀胸部X光片,可分類出四項臨床重要的特徵,氣胸、結節和腫塊、骨折以及氣腔陰影,而精確度與放射科醫生相當。這項研究能夠幫助醫生更精確的診斷病患的肺部狀況,避免因誤診帶來嚴重的後果。

以機器學習幫助疾病診斷的研究越來越多,Google自家的研究,包括在今年早前發表以機器學習判讀肺腺癌組織切片的論文,其精準度已經可達到與病理學家相當的程度,另外,還有機器學習用於前列腺癌以及皮膚疾病鑑別的研究。

現在Google進一步要把深度學習用於偵測更多肺部種類的病徵,不過,與其他的深度神經網路的應用一樣,也遭遇到難以取得足夠標籤資料的困難。Google提到,深度學習需要大量帶有精確臨床標籤的圖像資料集,主要有兩種方法取得這樣的標籤資料,其一是應用自然語言處理從放射學報告而來的圖像,另一種則是仰賴個別讀者的審閱,但這兩種方法同樣都有不一致或是錯誤的問題,特別會影響模型的評估。

另外,圖像集也需要足夠廣泛,才能涵蓋各式病例,而且部分胸部X光照片,並無法代表特定結果,需要與臨床資訊結合才能解讀意義,Google提到,建立具有臨床意義、一致定義的標籤,以及具嚴格參照標準的方法,才能有效地將機器學習技術應用於胸部X光片的解釋。

Google在最新的研究,開發了深度學習模型,用來診斷胸部X光片的4個重要的臨床病徵分類,分別是氣胸、結節和腫塊、骨折以及氣腔陰影,這些在胸部X光片發現的特徵,與重大病情有高度關聯。他們總共使用了兩個未經辨識的圖像資料集,包括來自阿波羅醫院的胸部X光片,以及美國國立衛生研究院的ChestX-ray14圖像資料集,總共約60萬張圖片。

由於圖像數量過於龐大,無法人工手動為圖像上標籤,因此Google還開發了一個獨立的文字深度學習模型,從文字擷取關鍵字為圖像資料集添加標籤,同時還由放射科醫生人工檢視約37,000張圖片,以提高資料集標籤的品質。

Google的這項研究訓練了深度學習模型,可從胸部X光中找出重要的臨床特徵,就模型效能來說,該深度學習模型的精確度與放射科醫生相當,而且總能發現放射科醫生一致忽略的特徵。Google提到,將深度學習系統和人類專家結合的成果,可顯示出人工智慧在醫學圖像解釋應用的潛力。

Google提到,他們為了產生可用於模型評估的高品質參照標準標籤,使用了小組裁決程序,由3名放射科醫師審查最終調校與測試集圖像,並討論解決分歧。Google提到,這個程序解決判斷困難的圖像案例,而且為了避免受醫師個性與資歷產生的偏見影響,這個程序在線上以匿名的方式進行。

而由於缺乏可用的裁決標籤(Adjudicated Label)是這項研究的主要困難,因此Google對社群開放了ChestX-ray14資料集中所有裁決標籤,包括擁有2,412張圖像的訓練與驗證資料集,還有1,962張圖像的測試集,以幫助社群對胸部X光片進行研究。

熱門新聞

2026-01-12

2026-01-12

2026-01-12

2026-01-12

2026-01-12