鄭桂忠

重點新聞(1108~1114)

邊緣運算 仿神經晶片 影像辨識

邊緣AI關鍵!清大研發新型態仿神經晶片,在記憶體內嵌運算能力來省百倍功耗

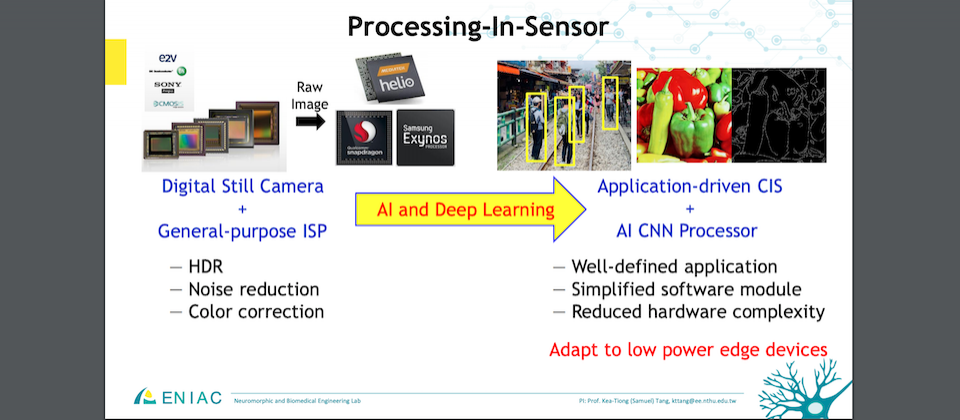

清大電機系教授鄭桂忠揭露自家團隊研發的仿神經(Neuromorphic)晶片設計,鎖定如無人機影像辨識等邊緣AI應用,自行設計了感測器內嵌處理(Processing-In-Sensor)和記憶體內嵌運算(Computing-In-Memory)兩項關鍵技術,可大幅降低數百倍的晶片功耗,來支援無人機等邊緣AI的高速影像辨識需求。

鄭桂忠解釋,一般無人機影像辨識時,得將拍到的大量影像,回傳到筆電或後端系統,來進行AI運算,但要傳輸所有影像相當耗電,導致無人機飛行時間有限。有鑑於此,清大團隊設計了可以在鏡頭內進行AI運算的超低功耗晶片,能直接在鏡頭內進行卷積處理、提取特徵,或像是比對前後兩幀畫面的差異,對差異進行影像處理等,如此可大幅減少回傳的資料量來省電。

清大團隊還仿神經架構,設計了新型態的記憶體,直接在記憶體中嵌入了運算元件,來進行資料運算,不需將資料送出到CPU上運算,目前可支援到卷積神經網路的計算。實驗結果顯示,與傳統運算資源相比,這個新架構可減少數百倍的功耗。清大團隊將這兩項技術整合在自家研發的仿神經晶片上,未來要推廣到無人機等邊緣AI裝置。(詳全文)

陽明大學 降噪 聽損

陽明大學用AI降低電子助聽器環境噪音,給聽障同胞更乾淨的語音

陽明大學團隊歷時3年研發一款環境降噪App,利用AI來降低電子助聽器接收的環境噪音,讓聽障同胞更容易聽清楚語音對話。歷年研究顯示,在安靜環境中,聽障同胞使用電子耳助聽器輔助,語音理解力可達80%,但在噪音環境卻只剩下50%,甚至更低。

有鑑於此,陽明大學團隊決定開發降低環境噪音的AI模型和App。首先,團隊錄製了上百種噪音,比如工地、街道、菜市場、車輛引擎聲等,再在每種噪音環境中混入200句語音對話,來訓練AI模型辨識語音環境。學會分辨噪音類型後,再用AI進行噪音消音,保留人類語音,回傳至電子耳中。實際運作上,手機App與電子耳連線,利用手機收音,經AI模型辨識噪音、降噪後,再將音訊傳送至電子耳。實驗顯示,經降噪的語音環境可提高聽障同胞的語音理解能力,最高提升40%。(詳全文)

影像辨識 精準農業 清大

11公頃火龍果園靠AIoT和無人機來照顧,清大揭精準農業關鍵技術

清大電機資訊學院院長黃能富日前公開介紹自家團隊研發的精準農業平臺LPWAN,整合了IoT環境感測器、無線傳輸技術NB-IoT/LoRa、無人機、AI影像辨識和區塊鏈等技術,透過數據來精準種植、施肥、收成,甚至輔助包裝出貨的分類作業。

全臺最大的單一火龍果園屏東帝王果園,就導入這款平臺來管理龐大的園地,來進行疏花、授粉、施肥和採果作業。感測器部分,可量測土壤溫溼度、導電度,以及空氣溫溼度、光照度,由太陽能板供電,再由長距離、低功耗的網路傳輸技術LoRa或NB-IoT來傳送資料至後臺系統。在AI運用上,可分為果實數量預測和成熟度預測,清大團隊先利用無人機空拍火龍果花朵影像,再切割至一張圖約10朵花的大小,來標記花朵,然後用1,000多張影像來訓練機器學習模型,用來辨識、統計花朵數量,預測果實數量。在分裝階段,清大收集了4,000張成熟火龍果影像,根據火龍果的鱗片顏色比例來標註成熟度,來訓練模型、進行水果分類。(詳全文)

OpenAI 文字產生模型 GPT-2

OpenAI釋出具15億個參數的GPT-2文字產生模型

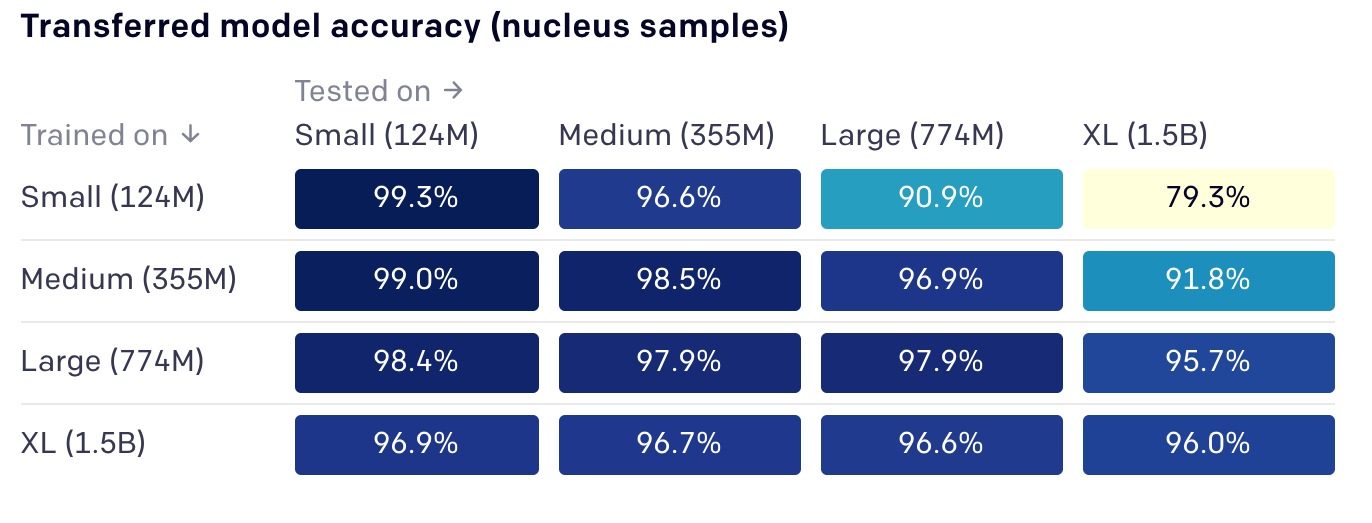

經過9個月觀察,OpenAI決定釋出擁有15億個參數的GPT-2文字生成模型及其程式碼和模型權重。這個GPT-2模型採用800萬頁的網頁作為訓練資料,以預測文本的下一個字為目標。由於訓練資料集龐大且多樣,因此模型不需要對特定任務進行訓練,就能應用於多種領域,包括機器翻譯、問答、閱讀理解和總結段落等自然語言任務。Open AI期望GPT-2能用來開發AI寫作助理或語言理解系統等應用。

不過,OpenAI也表示,自9個月前開源小型版GPT-2模型以來,他們意識到建立「負責任的AI」的重要性。這是因為,只要給GPT-2模型一段文字,模型就能產生接續段落的文字,甚至是假以亂真的假新聞。OpenAI指出,接下來他們要繼續探討如何維持負責任的AI,並參與國際AI合作組織Partnership on AI,來研究相關議題。(詳全文)

Google 無程式碼工具 機器學習

Google更新無程式碼機器學習工具Teachable Machine,現可分類聲音

Google近日發布新版無程式碼機器學習工具Teachable Machine,可用簡單的方法來訓練AI模型,來辨識動作和聲音等更進階的應用。

Teachable Machine是一個網頁工具,使用者就算不會寫程式,依然能輕鬆訓練機器學習模型。Teachable Machine第一代可以用來辨識攝影機鏡頭中的物體,這次更新的Teachable Machine第二代擴充了模型支援的資料類型,比如可從影像來辨識人的姿勢,或是分類聲音,並以一鍵操作的方式訓練和調校模型,讓用戶能輸出和部署模型到網站、應用程式甚至是實體機器上。(詳全文)

NEC 虹膜偵測 影像解析度

NEC首度展示行進中的人眼虹膜偵測新技術,更能認得2公尺遠的不同人眼

日本辨識科技大廠NEC日前首次展示新一代人眼虹膜辨識模型雛型,突破了過去虹膜辨識的瓶頸。這項新技術不只能在定點辨識,也能在人員行走時成功識別身份,最遠還能偵測2公尺距離的不同人眼。

此外,NEC這項新技術還能維持一定程度的高辨識率,這是因為NEC打造了一套用來辨識虹膜的人眼追蹤系統,可根據行人距離遠近、頭部擺動,來自動縮放鏡頭畫面,將對焦位置調整到眼部重點區域,以放大想要對焦的主體,讓人眼畫面更清晰,即使人距離2公尺遠,直徑1公分的人眼虹膜,拍攝出來影像解析度仍可達到200萬畫素。接著,系統會將拍攝的虹膜影像輸入到自家的虹膜辨識引擎,用來分析虹膜特徵,來比對已註冊的虹膜,以確認其身份。(詳全文)

臺灣人工智慧學校 產業AI化 IT建設

臺灣AI學校產業AI化大調查:僅2成企業成功擁抱AI

臺灣人工智慧學校日前揭露臺灣產業AI化的調查報告,樣本涵蓋學校1,162位校友與在學學員,對自家公司AI應用現狀的回覆,總企業數有516家。調查截至今年10月,有效問卷為1,095份,過半來自製造業,其次40%來自服務業,其他還有學術單位、金融業、財團法人、政府等。

調查結果顯示,86%的AI作答者,在上過AI學校的課程後,認為企業應該開始導入AI,但以實際執行層面來看,僅有43%企業明確宣布策略,而真正成功導入的企業只有20%。臺灣AI學校執行長陳昇瑋表示,約三分之一的臺灣企業CEO沒有導入AI的計畫,這個結果較其他國家高。而阻擋企業推動AI的主因,則是資料品質不佳與取得不易,再來則包括了自家企業領導階層認知不足、IT建設與人才缺乏等。(詳全文)

圖片來源/鄭桂忠、陽明大學、黃能富、OpenAI、Google

AI趨勢近期新聞

1. 臉書以PyTorch改寫物體偵測函式庫釋出Detectron2

2. Yahoo奇摩新一代自動化物流中心入庫到出貨全程靠AI優化,10分鐘就可出貨

3. Google釋出高效能切割模型ShapeMask

4. 圖資料庫Neo4j推出企業級全託管資料庫服務Aura

資料來源:iThome整理,2019年11月

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-03

2026-03-02