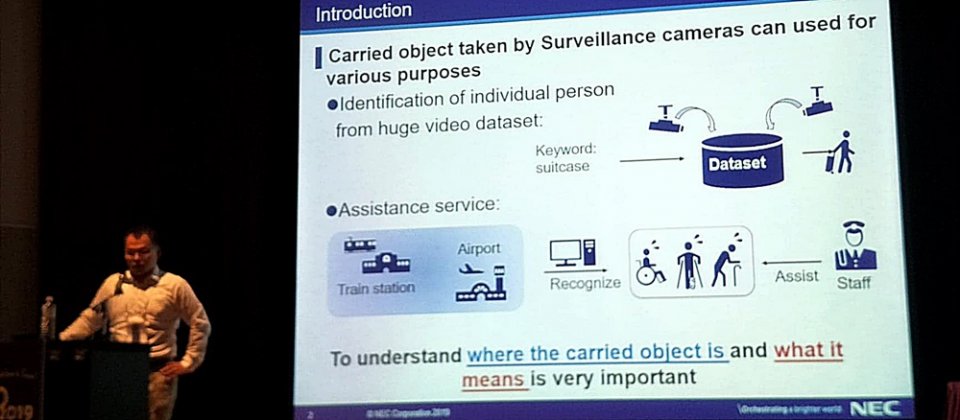

NEC資料科學研究實驗室的博士研究員Jun Piao表示,這項技術可以部署到機場、大眾運輸場所、大會場所的安控錄影機中,用來辨識被放置的可疑物品,或是主動偵測拐杖、輪椅、導盲杖等物件,並通知站務人員協助行動不便者。

攝影/翁芊儒

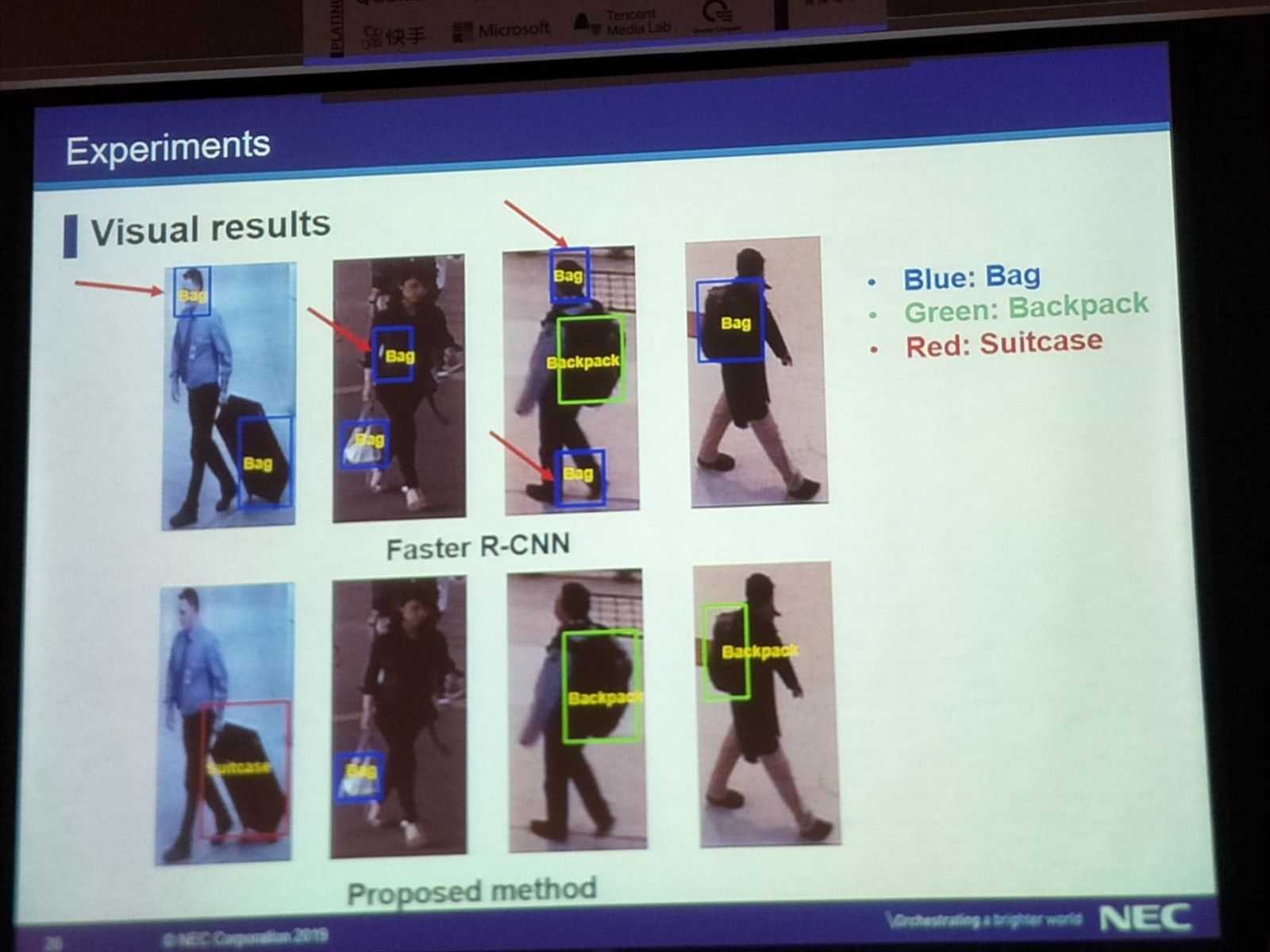

NEC資料科學研究實驗室日前在ICIP大會中發表一篇論文,提出一種基於人體部位與攜帶物件的相對位置,來辨識攜帶物體種類的方法(Carried Object Recognition),能在較低解析度的監視器影像中,辨識旅客攜帶的物件種類,其辨識準確率更比Faster R-CNN所訓練的模型平均高6%。目前,NEC也正著手導入AI引擎,預計年底將釋出相關應用。

一般基於卷積神經網路(CNN)的物件辨識框架,如Faster R-CNN、SSD、Mask R-CNN、YOLO等,用來辨識高解析度、大範圍物件的影像,大多具有良好的表現。然而,一般監視錄影機畫面中的攜帶式物件體積小、解析度通常也較低,且時常有被遮蔽的情形,若只運用上述基於外觀辨識的框架來辨識物件種類,較難有好的表現。例如,要辨識民眾攜帶的物件為手提包、後背包、或是行李箱,由於其形狀大多為長方體,加上容易受身體姿勢遮蔽,在低解析度狀態下會有辨識上的困難。

因此,NEC資料科學研究實驗室開發出一套技術,要將一般物件辨識技術結合人類的經驗知識,來提高模型表現,比如說後背包大多位於背部位置、手杖則通常與手部連結、帽子通常戴在頭上等,透過物件與人體部位的關聯來分類物件。

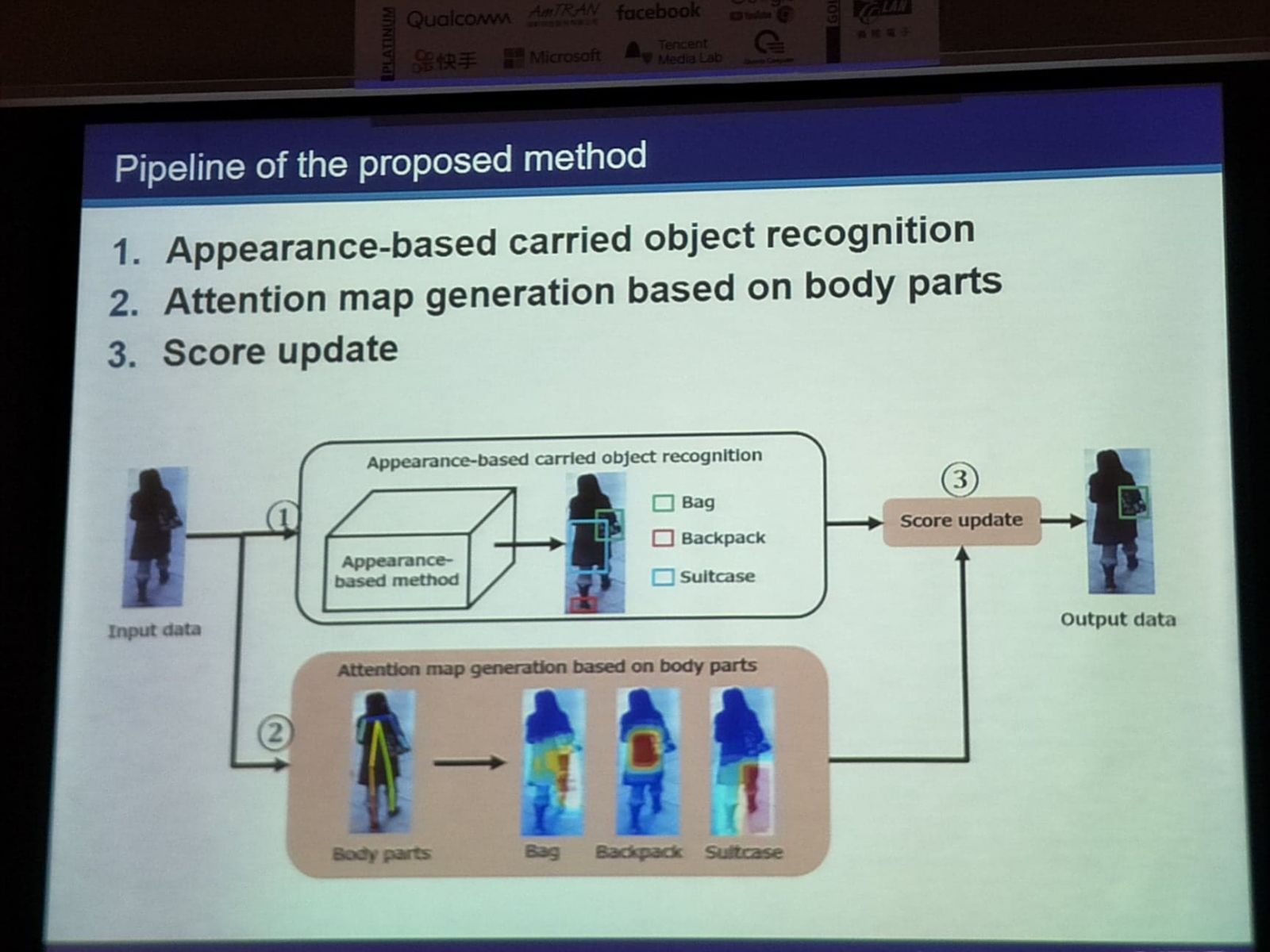

這個辨識方法可以分為三個步驟。首先,輸入一張影像後,運用一般物件辨識框架訓練的模型,先粗略辨識該影像中的物件位置與種類;接著,再用人體姿勢辨識的開源模型OpenPose,根據人體各部位來生成關鍵點(key point),並自動比對找出訓練資料中的相似人體姿勢影像,再根據其中的物件位置生成注意力地圖(attention map),也就是不同種類物件的可能分布位置;最後,則是根據第二步驟的結果,來更新第一步驟中物件辨識結果的分數。

舉例來說,要辨識影像中的包包種類與位置,第一階段先透過一般物件辨識模型,根據物件外觀粗略辨識。假設模型只正確辨識出手提包,其他分別把黑裙誤認為後背包、鞋子誤認為行李箱,這時,就能運用第二階段的注意力地圖,透過該影像人體姿態中、三種包包的可能分布位置,來重新檢視第一階段的辨識,位置比對相近者(手提包)分數增加,反之則分數下降(後背包、行李箱),最後得出更精準的分類結果。

物件辨識三步驟。

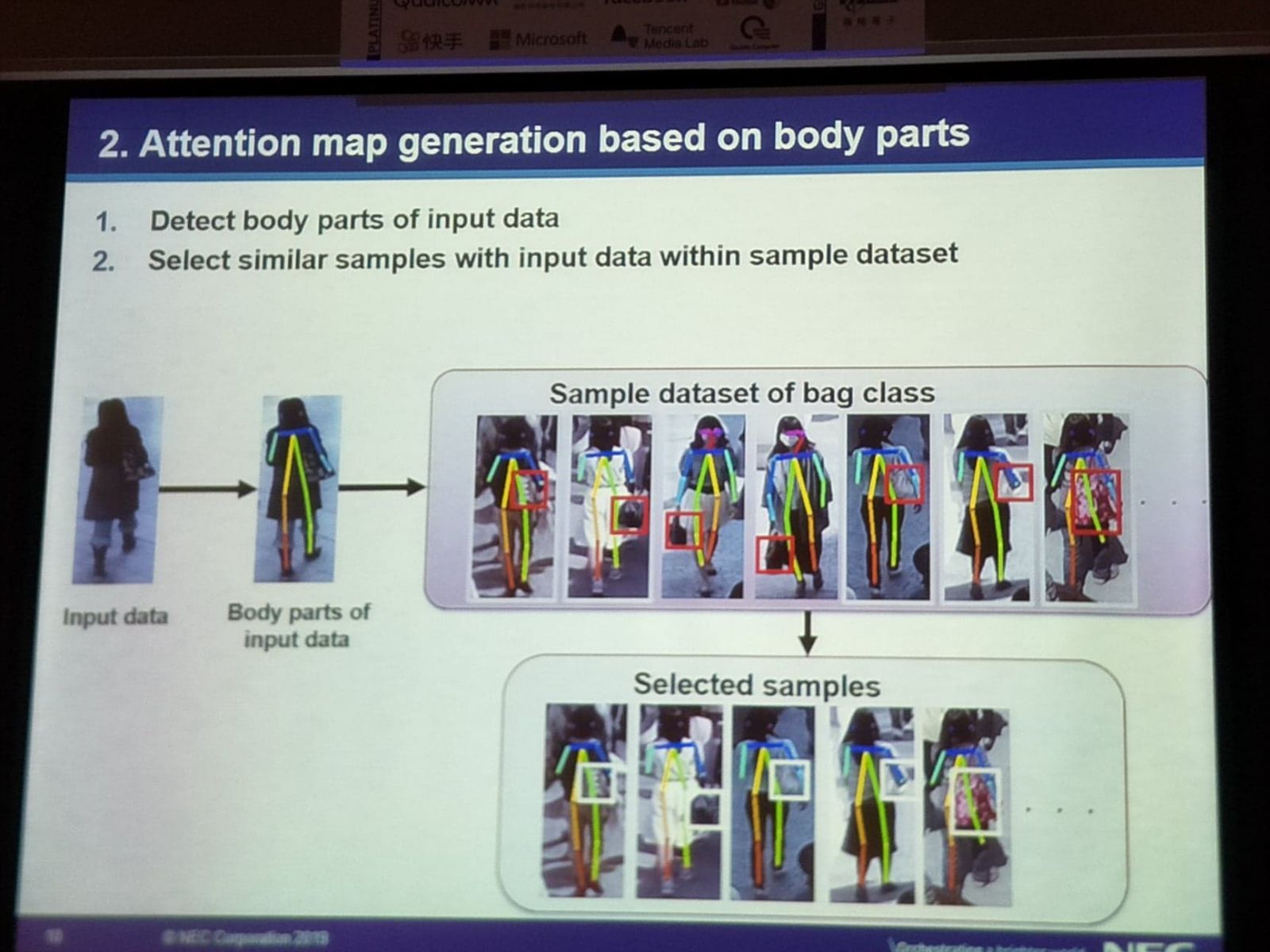

透過OpenPose找出與輸入影像相同姿態的訓練影像,並根據訓練資料的物件位置,來生成物件的可能分布位置。

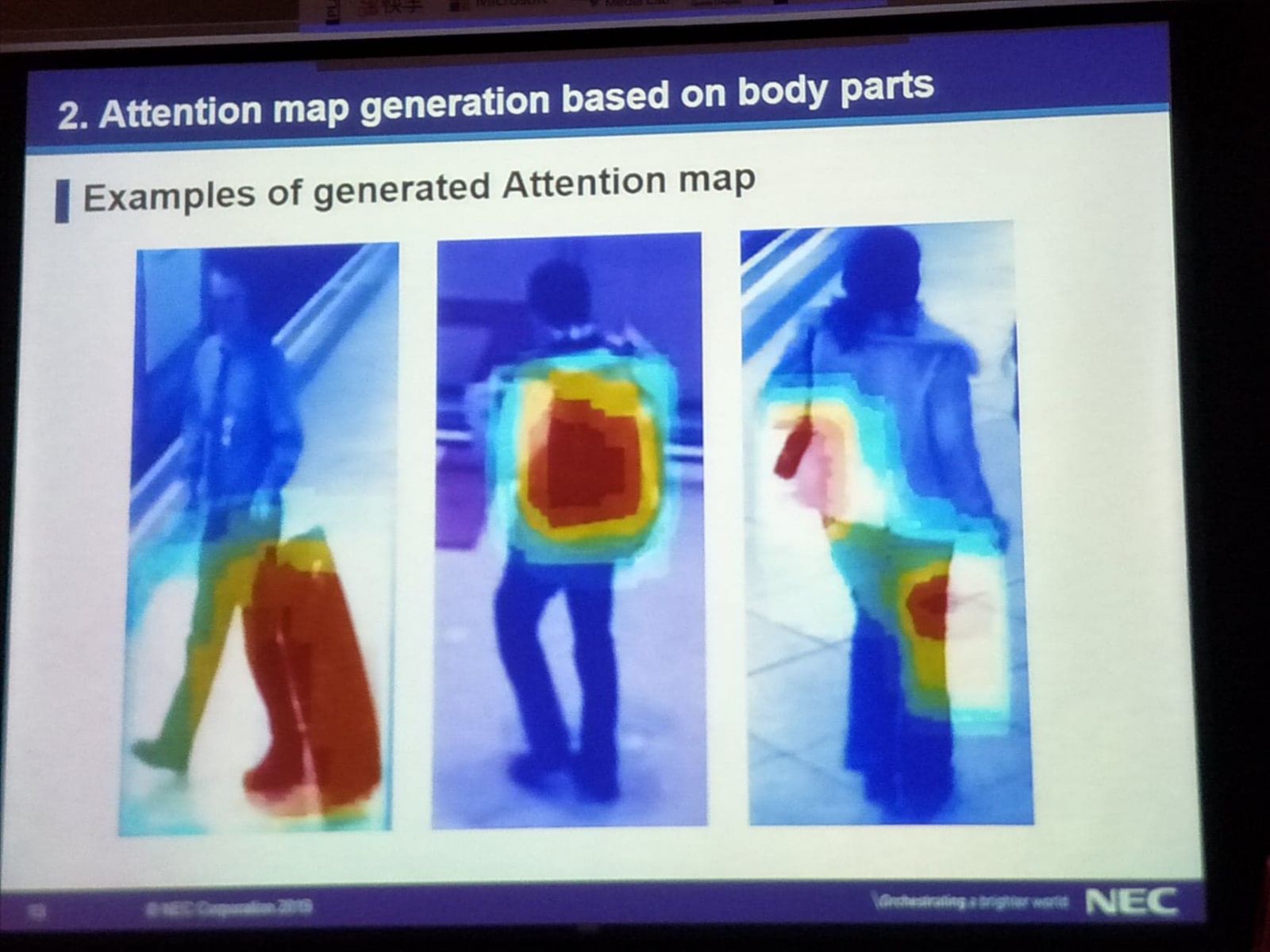

在輸入影像上顯示注意力地圖(attention map),也就是不同種類物件的可能分布位置。

這項研究從去年開始,運用了NEC不公開資料的監視畫面中,約20,000張一個人攜帶一件物品的影像進行訓練,訓練出的模型可以辨識手提包、後背包、行李箱、帽子、雨傘、手杖等物件;接著,使用4種資料集進行測試,同時以物件辨識框架Faster R-CNN所訓練的模型,作為對照組來比較其準確率。

對此,NEC資料科學研究實驗室的博士研究員Jun Piao表示,4種資料集測試結果中,NEC提出的研究方法比Faster R-CNN模型平均多了6%的正確率,降低了錯誤的預測結果,也增加了正確預測結果的信心值。

上面一排是用Faster R-CNN模型的辨識結果,下面一排是用根據人體部位結合物件辨識的新方法。

Jun Piao也提到,目前正在尋找該技術的應用場域,NEC最快在今年年底將釋出相關應用。而這項技術最大宗的市場,是部署到機場、大眾運輸場所、大會場所的安控錄影機中,用來辨識被放置的可疑物品,或是當偵測到拐杖、輪椅、導盲杖等物件時,能通知站務人員主動協助行動不便的民眾,來降低搭乘的風險,也提供更貼心的服務。

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-03

2026-03-02