臉書將二項影像辨識工具開源,透過GitHub分享給第三方單位,提供色情、暴力、犯罪等有害內容的數位指紋(雜湊)。

在以影像辨識技術過濾平台上的暴力及攻擊內容後,臉書周四在兒童安全駭客松(Child Safety Hackathon)宣布將兒童性犯罪、恐怖主義宣傳及血腥暴力的影片和圖片辨識工具開源出來。

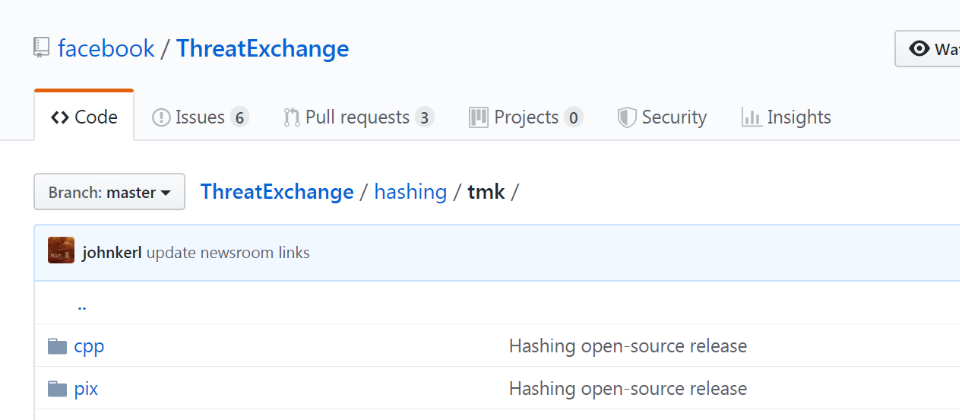

臉書引用第三方數據指出,科技業通報的兒童性剝削的影片數量一年來增加了541%,臉書此次開源可讓產業合作夥伴、小型開發商及非營利機構更迅速辨識有害影片或相片。目前二項演算法開源專案已經透過GitHub分享出來,提供各種類型有害內容的數位指紋(雜湊)。已經有內容比對技術的單位則可多一層防護,透過雜湊分享系統互通有無。

現行常見的影片或相片辨識技術包括pHash、微軟的PhotoDNA、aHash和Hash等。臉書的PDQ及TMK+PDQF則能偵測二個相同或幾乎完全相同的相片和影片。其中PDQ為相片比對演算法,是臉書以pHash為主要基礎、全新開發有獨立軟體實作的演算法。影像比對技術TMK+PDQF,則是由臉書人工智慧研究院(AI Research)團隊與義大利摩德納雷焦艾米利亞大學(University of Modena and Reggio Emili)合作開發而成。

臉書全球安全部門主管Antigone Davis及整合部門副總裁Guy Rosen指出,這兩項技術優點在於,能將檔案以很短的數位雜湊(digital hash)形式儲存,判斷兩個檔案是相同還是相似,甚至沒有原始影片或相片也可以進行。臉書辨識出平台上的有害內容,像是恐怖主義宣傳時會將之移除,並以演算法等其他技術產出雜湊值。這些雜湊值可方便分享給其他公司或單位,例如全球反恐怖主義網路論壇(Global Internet Forum to Counter Terrorism, GIFCT)來過濾同樣的內容。

臉書說,PDQ和TMK+PDQF是為比對大量內容而設計,支援video-frame-hashing及即時應用。迄今臉書已經將之用來比對過平台上數十億則的影片和相片。

臉書今年5月和馬里蘭大學、康乃爾大學、加州大學柏克萊分校和麻省理工學院合作開發強化偵測影片、相片的技術,以抓出企圖躲過偵測演算法的違規內容。

10年前微軟也曾捐贈PhotoDNA於類似計畫。Google也於去年將內容安全(content safety)API提供給非營利組織及合作夥伴,以打擊兒童色情內容。

熱門新聞

2026-03-02

2026-03-02

2026-03-02

2026-03-02

2026-03-03

2026-03-02

2026-03-02