人工智慧當紅,相關的開發工具越來越重要,例如,訓練大型語言模型的工具一旦存在資安弱點,很有可能危害AI的運作。

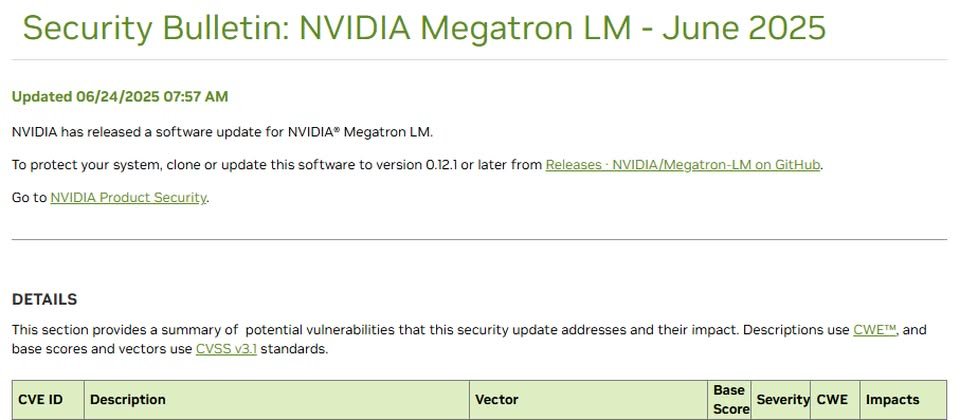

例如,6月24日Nvidia修補的分散式訓練框架Megatron LM,就有這樣的影響力,因此用戶必須重視相關的緩解作業。Nvidia公布CVE-2025-23264、CVE-2025-23265兩個高風險的資安漏洞,它們都存在於特定的Python元件,攻擊者可藉由惡意檔案造成程式碼注入的現象,最終導致程式碼執行、權限提升、資訊洩露,或是資料竄改,CVSS風險為7.8分,影響0.12.0以前的所有版本,該公司發布0.12.1版Megatron-LM修補。

Megatron-LM是專門訓練GPT、BERT、T5等大型語言模型的分散式深度學習訓練框架,當用戶訓練數十億至數千億個參數的模型時,能以此處理面臨的運算瓶頸與記憶體限制。這套框架也能與Nvidia的NeMo框架整合運用,透過DGX A100、H100等GPU叢集運作。因此,上述的漏洞若不處理,很有可能影響模型安全。

熱門新聞

2026-03-06

2026-03-02

2026-03-02

2026-03-04

2026-03-02

2026-03-05

2026-03-02

Advertisement