「當企業使用愈來愈多的AI技術,有沒有立很好且完整的監督機制,掌握企業內有多少員工運用AI?有多少語言模型被應用在產品線上?」趨勢科技產品管理部協理沈維明臺灣資安大會上這麼說。

隨著LLM模型技術發展,為企業應用生成式AI打開大門,更多的企業增加對GenAI的投資,但是GenAI相應產生的風險,企業該如何有效控管?

沈維明表示,現今LLM大語言模型發展三個趨勢,首先是LLM每百萬Token成本,在保持準確性之下,每年降低40倍;其次是較小參數規模的LLM模型,在某些方面的效能表現不輸於較大參數的模型;第三是模型壓縮技術快速發展,得以在較低規格的伺服器上執行,在壓縮和效能上取得平衡點。

目前觀察的大語言模型發展趨勢,大語言模型愈來愈小,也愈來愈專精,效能表現也愈來愈好,甚至有專門研究,研究大語言模型如何透過更有效率的壓縮,經過壓縮後也能產生相近的效果,「這意謂著大語言模型的應用會變得更廣泛,以往只能在高階規格的設備上才能執行,現在逐漸往終端裝置或邊緣運算發展,例如在工廠的產線做加值應用」,沈維明說。

不少調查報告顯示,有更多的企業表示將增加對AI的投資,運用AI的場景,也從先前多聚焦於客服機器人,開始向核心業務發展,企業運用AI提高生產力、建立差異化,這些已是市場上明顯觀察得到的趨勢。

建立AI資安風險的可視性

在AI的時代,資安風險也隨之增加,攻擊手法愈來愈不一樣,愈來愈快速、刁鑽,難以偵測防範。

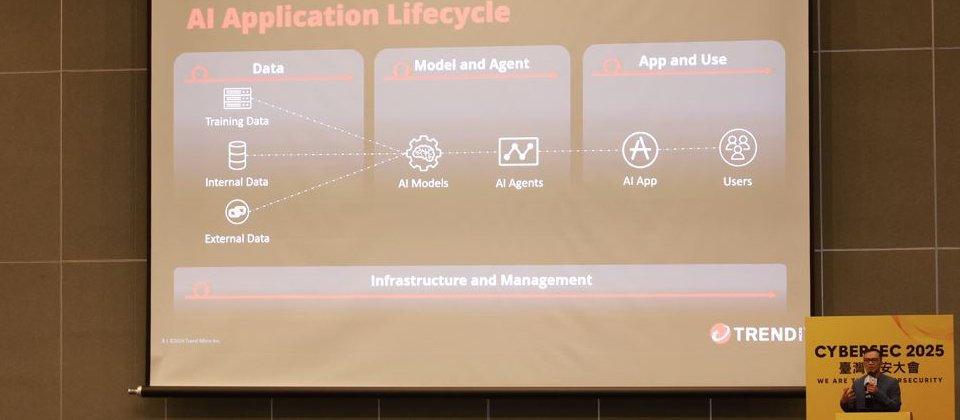

從AI應用的生命周期來看,相關的風險來自資料、AI模型及代理、App及使用,以及底層的基礎架構及管理。

沈維明指出,首先是資料部分,當企業運用GenAI,需要使用許多訓練資料、企業內部資料、外部資料,讓語言模型學習企業內文化、內規及作業方式,如何妥善管理資料,避免機敏性的資料不小心外洩出去,為控管AI風險的重要課題之一。

其次是AI模型及代理,企業導入AI Agent,Agent與Agent之間的溝通協定,或是企業利用代理工作流將供應鏈串連在一起,需要考慮到可能的潛在風險。

最後是AI App及使用,大部分的資安問題來自於人,因此思考如何控管AI風險,也要將員工如何使用AI的行為納入考慮。

在資料、模型及代理、App及使用三者之外,底層的基礎架構及管理也相當重要,不論是使用雲端IaaS、SaaS或地端,都需要妥善的控管潛在風險。

沈維明表示,企業需要建立AI風險的可視性,才能對資源使用排出優先順序,制定策略將潛在的風險妥善管理或予以分散風險。

GAI風險的經典案例

上述資料、模型及代理、App及使用,已出現經典的案例,沈維明分享幾個知名的案例。

在資料管理方面,一個案例是韓國新創業者推出AI聊天機器人Lee Luda,運用超過10億筆Kakao Talk用戶對話資料訓練,Lee Luda與使用者對話,意外洩露用戶的敏感資料,被聯合訴訟,韓國政府也對此開罰,該業者面臨商譽及金額的損失。

在AI模型及代理開發方面,許多企業在訓練、微調模型的過程中,可能使用第三方的開發工具或框架,以加快AI的建置,一個案例是使用開源工具Flowise,因為對於採用的開源工具不熟悉,導致在沒有很好的權限控管之下,企業將AI服務放到網路上,導致敏感的個資、企業資料、健康資料曝露出來。

另一個案例是軟體被發現CVE 9.0的漏洞,由於沒有及時修補,導致容器被攻陷,濫用Nvidia GPU及雲端資源。

在App及使用方面,一個攻擊的案例是,曾有一位白帽駭客利用Prompt Injection的入侵手法,使ChatGPT幫他產生惡意軟體;日本曾出現一個案例,一名沒有技術背景的人士,在沒有利用漏洞的情形下,利用AI工具產生勒索軟體。

沈維明表示,企業需要建立很好的方法去掌握內部員工使用哪些AI工具,企業應該如何因應?上述各種案例就像開時速300公里的跑車,如果沒有設計很好的煞車系統,不會知道何時會發生車禍。如同趨勢科技執行長所說,我們並不是要讓企業的AI應用停下來,而是在安全的框架下,當面臨危險或風險時稍微減速跨過去,或是預防接下來可能發生的問題。

依不同的風險制定防護策略

針對上述的攻擊案例或手法,企業可以參考資安業者公開的威脅研究,例如趨勢科技針對AI風險發布白皮書,供外界免費下載,持續更新針對AI攻擊的最新手法,企業可參考白皮書加強AI應用的資安防護。另外,趨勢科技的威脅研究團隊也在官網公開最新的威脅研究成果,以及建議企業可以如何布建安全防護,可以作為企業參考。

「思考資安或AI議題,一個很重要的方向是建立完整的可視性(Visibility)」,沈維明表示,現在資安涵蓋的範圍相當廣泛,電子郵件、身分、網路不同領域都有資安廠商,企業要先建立完整的可視性,掌握匯整後的資訊,進而採取行動。

目前趨勢科技提出Vision One,其中的資安曝險管理CREM(Cyber Risk Exposure Management),以協助企業針對內部不同層面,如電子郵件、網路、雲端,進行風險評估,幫助CISO評估企業內部的風險指數高低,包括造成風險的弱點在哪些,例如目前企業的電子郵件面臨的網路釣魚風險高低等。

企業推動AI應用發展,另一個面臨的議題是法遵,除了國外,臺灣也已開始針對產業建立AI應用相關的規範,特別是金融業方面,未來會有更多的規範,針對AI應用的情境及問責、責任,提供更明確的規範,趨勢已提供工具,讓企業資安或稽核人員檢視實務和法規規範間的落差。

針對AI使用行為的防護,目前可以參考一些AI Gateway方案,可協助企業釐清風險,並透過rule-based的控管員工的AI使用行為。

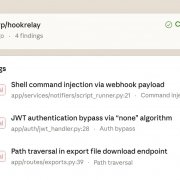

至於AI應用開發中的container保護,沈維明認為,大多集中在對runtime的保護,建議也要強化pre-runtime部分,即開發的CI/CD階段,開發階段最容易被忽視,建議可從開發到部署加強保護。

許多企業目前已經上雲,但是諸如金融或政府,可能因為法遵對資料的要求,AI應用需要落地,在地端資料中心或私有雲環境部署AI應用,這類部署常常會因為條件有不同的變化,他建議企業思考AI的資安策略,要顧及到雲端部署的AI防護,在地端部署也要能做到一致的防護。

熱門新聞

2026-02-23

2026-02-23

2026-02-20

2026-02-23

2026-02-23

2026-02-23