Cerebras Systems發表了號稱是全球第一個大腦等級的AI解決方案,藉由一個冰箱大小的CS-2系統,來支援超過120兆個參數的模型,勝過了人腦中所存在的100兆個突觸。(圖片來源/Cerebras Systems)

在2016年成立,專注於建置AI與深度學習電腦系統的Cerebras Systems,於24日發表了號稱是全球第一個大腦等級的AI解決方案,藉由一個冰箱大小的CS-2系統,來支援超過120兆個參數的模型,勝過了人腦中所存在的100兆個突觸。

Cerebras指出,人腦約含有100兆個突觸,而過去最大的AI硬體叢集大概只占人腦的1%,相當於1兆個突觸,而在AI系統上則稱為參數,由於它僅等於人腦的一小部分,這些由繪圖處理器組成的叢集除了要占用數英畝的空間與數兆瓦的功率之外,也必須由專門的團隊來操作。

Cerebras所建置的CS-2系統採用了4項創新技術,於小空間創造了與人腦相當的AI能力,這些技術分別是軟體執行架構Cerebras Weight Streaming、記憶體擴張技術Cerebras MemoryX、高效能互連構造Cerebras SwarmX,以及動態的稀疏收集技術Selectable Sparsity。

其中,Weight Streaming可將模型參數存放在晶片外,卻可提供像是位於晶片的同樣訓練及推理效能。此一新的執行模型拆解了運算與參數的儲存,讓研究人員能夠彈性地擴展規模與速度,也消除了大叢集可能導致的延遲及記憶體寬頻的問題,還讓使用者能夠在不需變更軟體的狀況下,使用1到192個CS-2。

MemoryX則是讓CS-2可支援具備120兆個參數模型的基礎,SwarmX允許Cerebras可連結192個CS-2中的1.63億個AI最佳化核心,藉以訓練單一神經網路,Selectable Sparsity則是用來權衡模型中的稀疏程度,以減少所需的浮點運算效能及解決時間。

Cerebras指出,結合上述技術將能輕鬆地解鎖大腦等級的神經網路,並將任務分派到基於AI最佳化核心所組成的叢集上。

美國阿貢國家實驗室(Argonne National Laboratory)副主任Rick Stevens表示,前幾年的研究顯示,對於自然語言處理(NLP)模型來說,洞察力與參數成正比,參數愈多,結果便愈好,Cerebras的創新讓參數增加了100倍,將有改變整個產業的潛力。

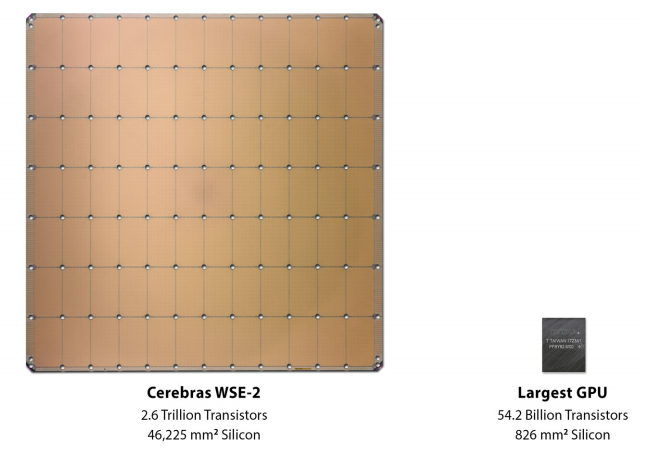

吸引外界注意的還有CS-2系統所採用的WSE-2晶片,它是一個 46,225平方公釐的矽晶片,只比9.7吋的iPad還要大一些,內建2.6兆個電晶體,85萬個AI最佳化核心,40Gb記憶體,20 PB/s記憶體頻寬,以及220 Pb/s的互連頻寬,採用台積電的7奈米製程技術,它是全球最大的電腦晶片,也是地球上最獨特的半導體裝置之一。

圖片來源_Cerebras

熱門新聞

2026-03-06

2026-03-02

2026-03-02

2026-03-04

2026-03-06

2026-03-05

2026-03-06