加州大學舊金山分校(UCSF)研究人員開發了語音神經義肢(Speech Neuroprosthesis),能夠將大腦的訊號翻譯成為文字顯示在螢幕上,讓重度癱瘓的人,也可以使用句子來與其他人進行交流,研究人員提到,這是第一次直接從癱瘓者的大腦活動,成功解碼出完整的單詞。該系統能以每分鐘18個字的速度,從大腦神經活動中解碼單詞,準確度可達93%。

過去溝通神經義肢的研究重點,在於試圖以拼字的方式,一個一個字母地拼湊出完整的文本,但是UCSF這項新研究方法與過去的方向不同,研究團隊嘗試翻譯控制發聲系統肌肉的訊號,而不是移動手臂來進行打字的大腦訊號,研究團隊提到,這種方法利用了語音自然與流暢的特性,有望更快實現基本的溝通。

使用語音來交換訊息,每分鐘可以高達150到200個單字,比使用打字、書寫和控制游標,這些基於拼寫的方法快得多,也不那麼費力,這個新方法更接近一般說話的方式。這項研究的部分貢獻,來自於UCSF癲癇中心的患者,這些患者在接受神經外科手術時,醫生在大腦表面放置電擊陣列,來查明癲癇發作的原因,這同時也促進了研究人員的進展。由於這些癲癇患者都具有正常的語言能力,研究人員對他們的大腦進行記錄與分析,藉以找到大腦訊號和語言相關活動的關係。

研究人員對應每個輔音和元音,在聲道(Vocal Tract)運動與相關的皮層活動模式,開發出即時解碼系統以及統計語言模型,來提高解碼的準確度。不過,即便有了這些成果,可以在能夠說話的參與者身上成功解碼語音,但並不保證同樣技術應用在聲道癱瘓的人身上也有相同效果,研究人員提到,模型需要學習複雜的大腦活動模式,對應癱瘓者想說的話,而且研究團隊也無法確定,長年無法控制聲道肌肉的人,其大腦在控制聲帶的訊號,是否依然正常。

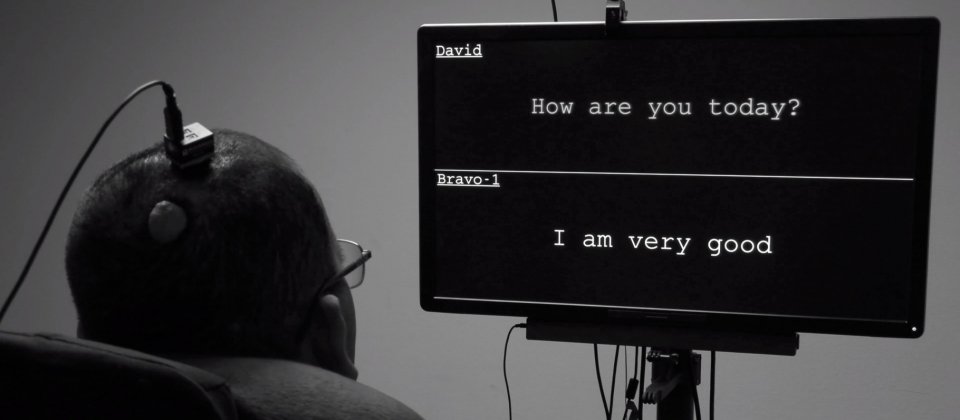

研究團隊找來代號為BRAVO1的受試者,BRAVO1是一位30多歲腦幹中風的男性,其大腦、聲道和四肢的神經連接遭到破壞,過去僅能透過棒球帽上的箭頭,以有限的頸部活動,在螢幕上觸控字母與其他人溝通。BRAVO1與研究人員合作,使用50個單字的字彙表,創建數百個適用日常概念的句子。

藉由在BRAVO1的語音運動皮層,植入高密度電極陣列,紀錄BRAVO1嘗試說出這50個單字時,說話語音皮層的大腦神經活動。接著再利用人工智慧神經網路模型,區分大腦活動的模式,以偵測BRAVO1嘗試說出的單詞。

BRAVO1被要求嘗試說出由50個單字所組成的短句,系統會解析大腦活動,並且在螢幕上顯示短句。該系統每分鐘可以解碼18個單字,在應用類似打字校正等自動更正語言模型,準確率更可高達93%。

研究人員提到,這項成果證明,以該方法促進交流具可行性,且擁有在對話環境中應用的潛力。

熱門新聞

2026-03-06

2026-03-06

2026-03-09

2026-03-09

2026-03-09