用戶在去年9月的時候,抗議推特的圖片縮圖剪裁演算法存在偏差,由於當時正是BLM(Black Lives Matter,黑人的命也是命)運動熱烈進行之時,這個事件在當時引起軒然大波,官方也立即跳出來回應用戶,承諾他們會進一步研究,並且將研究發現開源。

而現在推特的研究結果出爐,證明自家圖片剪裁演算法的確存在部分偏差,而官方表示將會停止自動剪裁圖片,透過完整顯示標準長寬比的圖片消除偏差問題,並讓用戶在編輯推文時,就可以預覽圖片呈現方式。

推特從2018年的時候就開始使用突出顯示演算法剪裁圖片,這樣做的目的是要讓時間軸中的照片大小一致,並且讓用戶能夠一次看到更多的推文。這個演算法的想法,是預測使用者希望第一眼觀看到的圖片部分,並且將圖片剪裁成易於查看的大小。

推特透過模仿人眼觀看圖片的方法,來訓練這個突出顯示模型,藉由人眼追蹤資料來訓練模型,教模型學習大多數人們認為重要的事物,使得該模型可以預測圖像中每一個區域的分數,並把得分數最高的地方當做剪裁的中心。

使用者指出剪裁模型可能存在三項缺點,第一項,模型在剪裁圖像時,傾向選擇白人而非黑人,並且圖片中傾向選擇女性而非男性,第二項,用戶反應模型存在男性凝視,也就是圖像剪裁會傾向從男異性戀者的角度來選擇圖片剪裁特徵,像是模型可能選擇女性的胸部或是腿部作為突出的特徵。第三項缺點,則是演算法決策讓用戶無法選擇圖片的呈現方式,因此傷害了呈現自由。

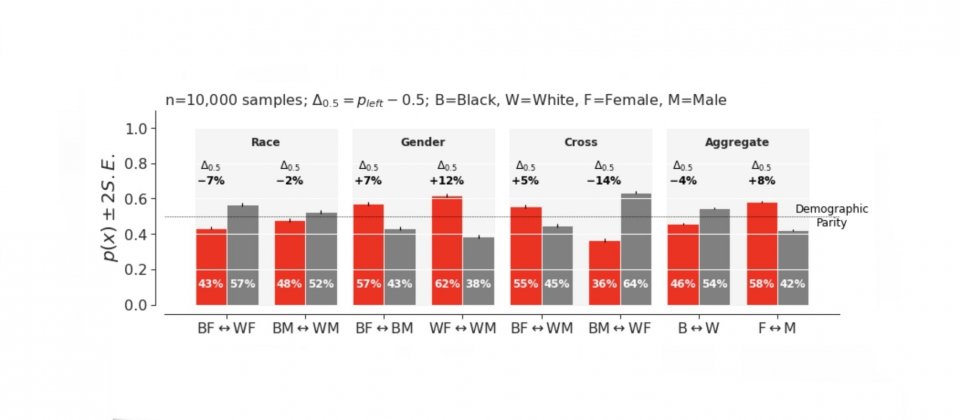

推特研究人員針對突出顯示演算法,進行性別與種族偏見實驗,的確發現了模型存在一些問題,在比較男性和女性時,模型偏好女性的機率高出8%,黑人與白人相比時白人高出4%,黑人女性和白人女性相比時,模型偏好白人女性機率高出7%,而黑人男性與白人男性相比,白人男性則多出2%。

研究人員也針對模型可能存在的男性凝視進行研究,但是沒有找到任何客觀證據,官方提到,演算法絕大多數都是以男性和女性的臉部作為剪裁目標,但是約每100張圖片,會有3張剪裁區域在頭部範圍之外,但是當圖像剪裁非人物頭部時,通常是為了剪裁非身體的部分,像是運動服上的數字。

而研究人員提到,即便對凸顯演算法進行調整,使模型在性別和種族完全平等,但仍然損害了使用者按自己意願呈現內容的自由,更遑論凸顯演算法還可能存在其他潛在危害,包括對文化細微差異不敏感等問題。

現在推特更新圖片剪裁方法,以降低對機器學習的依賴,推特表示,並非所有平臺上的內容都適合使用演算法,剪裁圖像最好的方式就是讓使用者自己決定。推特從3月開始,就在iOS和Android上測試能夠完整顯示標準長寬比照片的新方法,這樣便無需使用演算法剪裁圖片,也能讓用戶更好地控制圖像外觀,而更新也包括使用者在推文編輯區域的預覽,推文作者將可以清楚知道推文發布的外觀。

熱門新聞

2026-03-06

2026-03-06

2026-03-09

2026-03-09

2026-03-09