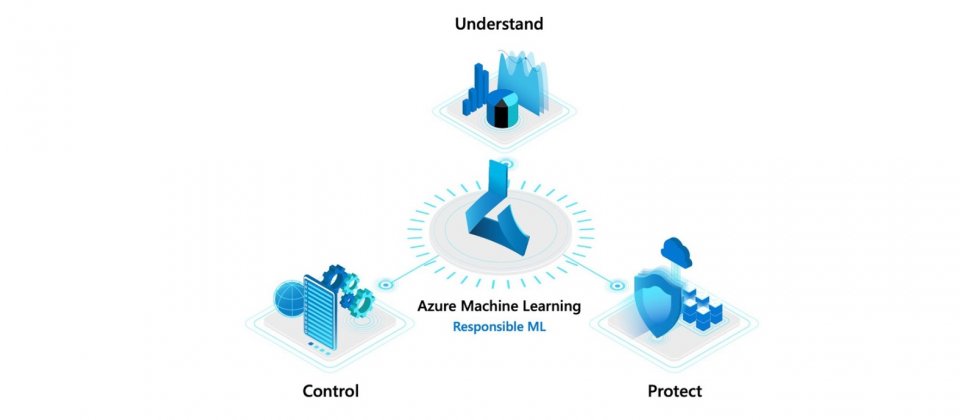

為了提高人工智慧解決方案的透明度,微軟和Aether委員會合作研究,並發布多個工具,在Azure上提供負責任機器學習服務(Responsible ML),微軟提到,由於機器學習開始被深入整合進日常業務流程,因此透明度顯得特別重要,Azure機器學習的問責功能,包含三個部分,理解模型、保護人們和資料以及控制端到端機器學習程序。

微軟提供InterpretML工具包,讓企業可以利用模型可解釋性功能,進一步理解模型行為,並向終端用戶以及業務相關利益人士,解釋機器學習所產生的結果。InterpretML工具包有助於建立精確的機器學習模型,讓開發人員可在模型訓練和預測階段,了解模型的行為,而且還適用深度神經網路,另外,模型可解釋性功能也可以執行假設分析,透過更改特徵值,以確定這些特徵對模型預測的影響。

微軟表示,當前建置人工智慧系統的挑戰之一,便是無法優先考慮公平性,微軟現在提供可以和Azure機器學習結合使用的Fairlearn工具,開發人員和資料科學家,可以利用專門的演算法,確定每個人都能獲得公平的結果。使用者可以在模型訓練和部署期間,利用Fairlearn來評估模型公平性,在減少不公平現象的同時,最佳化模型效能,該工具提供了互動視覺化工具,可以用來和推薦的模型進行比較減少不公平性。

考量到機器學習應用處理越來越多的敏感資料,像是醫療保健以及人口普查等領域,微軟提到,目前用來保護隱私安全的方法,包括校改和遮罩等,可會限制機器學習的效能,而為了解決這個問題,可以應用差分隱私(Differential Privacy)和機密機器學習技術來建構解決方案,在保持機器學習模型效能的同時,還能保有資料隱私和機密性。

因此微軟發布了WhiteNoise差分隱私工具包,用戶可以用於Azure機器學習服務上,保護隱私並且防止個人資料遭到辨識。這個差分隱私技術是微軟跟哈佛大學研究人員合作開發的,會在資料中添加統計雜訊,以防止洩露個人隱私資訊,且不會造成重大準確性損失。

而為了提高模型訓練和部署的安全性,Azure機器學習提供了資料和網路保護功能,包括支援Azure虛擬網路,並且有提供連接到機器學習工作空間的私有連結,用戶也可以在專用機器上執行機器學習工作負載,並且在資料傳輸和靜止時,使用金鑰加密。利用這些基礎,機器學習團隊可以在不用看見資料的情況下,在安全環境以機密資料建置模型。

微軟提到,負責任的機器學習,其開發過程應該是可重複、可靠並且相關利益者可被問責,而Azure機器學習的責任流程涵蓋每個決策者、審核人員,以及機器學習生命周期中的每個參與者。Azure機器學習提供追蹤功能,可自動維護機器學習資產的詳細追蹤資訊,像是執行歷史紀錄、訓練環境和模型說明等,並將這些資料紀錄在中央註冊表中,讓企業可以用於各種審核需求 。

熱門新聞

2026-03-06

2026-03-02

2026-03-02

2026-03-04

2026-03-02

2026-03-02

2026-03-03