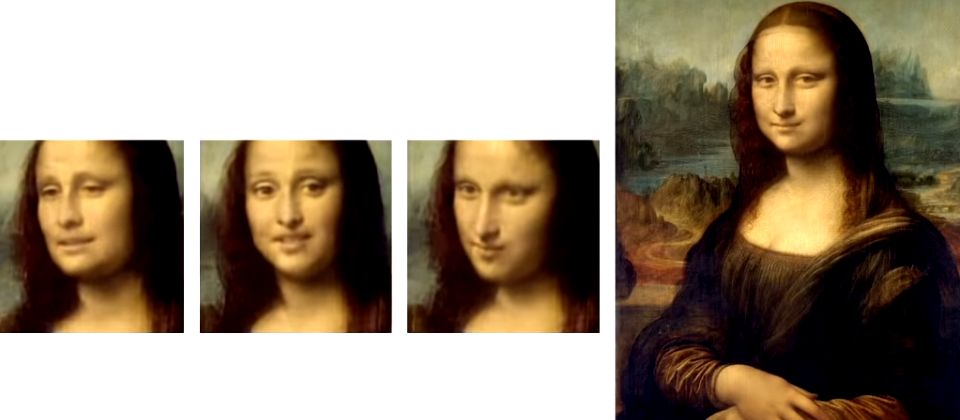

圖片來源:三星(翻攝自https://www.youtube.com/watch?v=p1b5aiTrGzY&feature=youtu.be)

位於莫斯科的三星AI中心最近發表了一篇研究報告,指稱已建立一個AI系統,只利用少許甚至是單一照片就能讓這些人具備其它的表情或說話,可創造瑪麗蓮夢露、愛因斯坦,甚至是蒙娜麗莎正在說話的影片。

近來的機器學習研究已可藉由訓練卷積神經網路來獲得非常逼真的頭部圖像,為了建立可說話的個人化頭部模型,必須利用該名人士的大量影像集進行訓練,但在許多實際的場景中,人們只能取得一些,甚至是只有一張圖像。

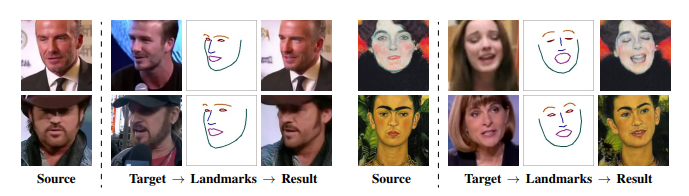

於是這群研究人員打造了一個AI系統,可替這些只有少數圖像的人們建立可說話的頭部模型。他們的作法是先在大量與其他人相關的影片上執行長期的元學習(meta-learning),再藉由強大的生成器與鑑別器來替只有少數圖像的人建立說話頭部模型。

簡單地說,他們追蹤並分析了大量影片中的人臉特徵,再將這些特徵套用到相近的新人臉上,讓這些缺乏大量數據的人像也能開口說話或具備其它表情。

圖片來源/三星

該報告作者之一的Egor Zakharov說明,元學習階段的成果讓生成器與鑑別器具備數千萬種參數,使得只有數張圖像的新人也能據此進行微調;亦可自動挖掘資料集中與畫像或人像照片特徵相符的人們,再將相關的模型套用到原本靜止的畫像或照片中的人物上。

於是,現在大家可以看到照片中的瑪麗蓮夢露或愛因斯坦開口說話了,甚至是在畫作中的蒙娜麗莎也有不同的表情了,而且研究人員在蒙娜麗莎身上套用了來自3個不同人的模型,創造出3位個性迥異的蒙娜麗莎。Zakharov表示,不管是在特徵的調適上或讓系統可更緊密地整合特徵追蹤,都有待進一步的研究。

熱門新聞

2026-03-06

2026-03-02

2026-03-02

2026-03-04

2026-03-05

2026-03-02

2026-03-02