多倫多大學研究員開發的「隱私濾鏡」可以破壞臉部識別演算法。研究員利用兩套神經網路,第一套負責臉部辨識,第二套負責擾亂第一套臉部辨識的任務。

Avishek Bose和Parham Aarabi

來自多倫多大學電子電腦工程學院的教授Parham Aarabi和研究生Avishek Bose近日發表了一個「隱私濾鏡」演算法(Privacy Filter),可以干擾社群媒體的臉部識別演算法,讓照片無法被識別,來保護個人相片和隱私。

Parham Aarabi和Avishek Bose採用深度學習中的對抗學習方法(Adversarial Training),訓練兩套神經網路,第一套用來識別人臉,第二套則用來破壞第一套的人臉識別任務。Avishek Bose解釋,第二套神經網路具有破壞性,會「攻擊」第一套在尋找的臉部特徵。他說:「假設第一套神經網路靠眼角特徵來辨識某人身份,那第二套神經網路就會稍微調整眼角特徵,讓它變得不容易辨識。」這兩套神經網路互相對抗,也互相學習。Bose表示,第一套的臉部識別能力越來越好,而第二套阻礙人臉識別的能力也越來越強。

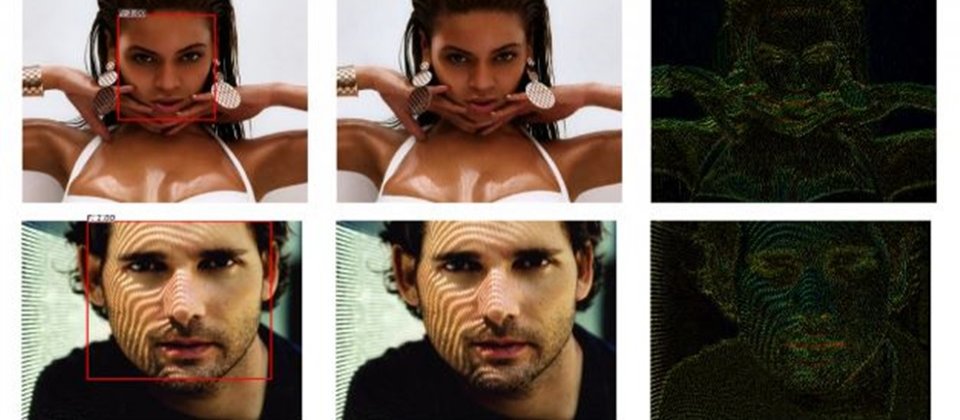

就像在Instagram中選擇相片濾鏡那樣,只要套用這個隱私濾鏡,就可以改變相片中臉部的特定像素,而且這些改變人眼幾乎察覺不出,但已經足夠影響識別系統(如下圖)。如此一來,使用者的相片就不被人臉辨識系統認出,進而能夠保護自己的相片和隱私。不過,該研究沒有展示實際用來對抗社群平臺臉部辨識技術的結果。

(圖片來源:Avishek Bose)

Parham Aarabi和Avishek Bose使用ImageNet資料集中數千張圖片來訓練模型,而為了訓練成效,他們將圖片解析度限制為600 x 800 pixels。在測試時,則使用300-W影像資料庫中的600多張臉部圖片,涵蓋各種族、明暗度和不同環境。測試結果顯示,隱私濾鏡可以讓相片原本100%的被辨識率,下降至50%。

這項技術不只可用來對抗臉部識別技術,還可用來能阻礙圖片搜尋、特徵辨識、情感和種族辨識評估等臉部識別應用的領域。該研究團隊希望,未來能以網路或App形式對外發布這個隱私濾鏡工具。

熱門新聞

2026-03-06

2026-03-02

2026-03-02

2026-03-04

2026-03-02

2026-03-05

2026-03-02