重點新聞(1121~1127)

Google AI基礎建設 辦公室

Google揭臺北全新辦公室,打造總部外最大AI基礎建設研發中心

Google日前在臺北士林正式啟用全新辦公室,定位為美國總部以外規模最大的AI基礎建設硬體研發中心。新辦公室匯集硬體、軟體和供應鏈等跨領域團隊數百名工程師,要加速AI伺服器、資料中心和基礎建設的研發與測試。

Google表示,臺灣完整的供應鏈與產業聚落,是發展AI基礎建設的關鍵優勢,從設計、製造到部署都能在數小時的距離內完成,有助於縮短開發周期。新辦公室設有十多座專業實驗室,可在產品部署全球前進行嚴格測試與驗證;空間設計也融入臺灣地景與鐵道意象,強調協作與創新。

這座辦公室也以永續為核心,預計可降低12%能耗、46%用水量,施工廢棄物則有73%回收再利用。Google強調將持續投入臺灣的數位基礎建設與人才培育,包括資料中心、國際海纜、再生能源,以及AI素養推廣與學術合作。新中心的技術將支援全球Google搜尋、YouTube、Gemini等核心服務。(詳全文)

Claude Opus 4.5 程式碼修復 Anthropic

Claude Opus 4.5來了!程式碼修復能力大升、還能無限聊天

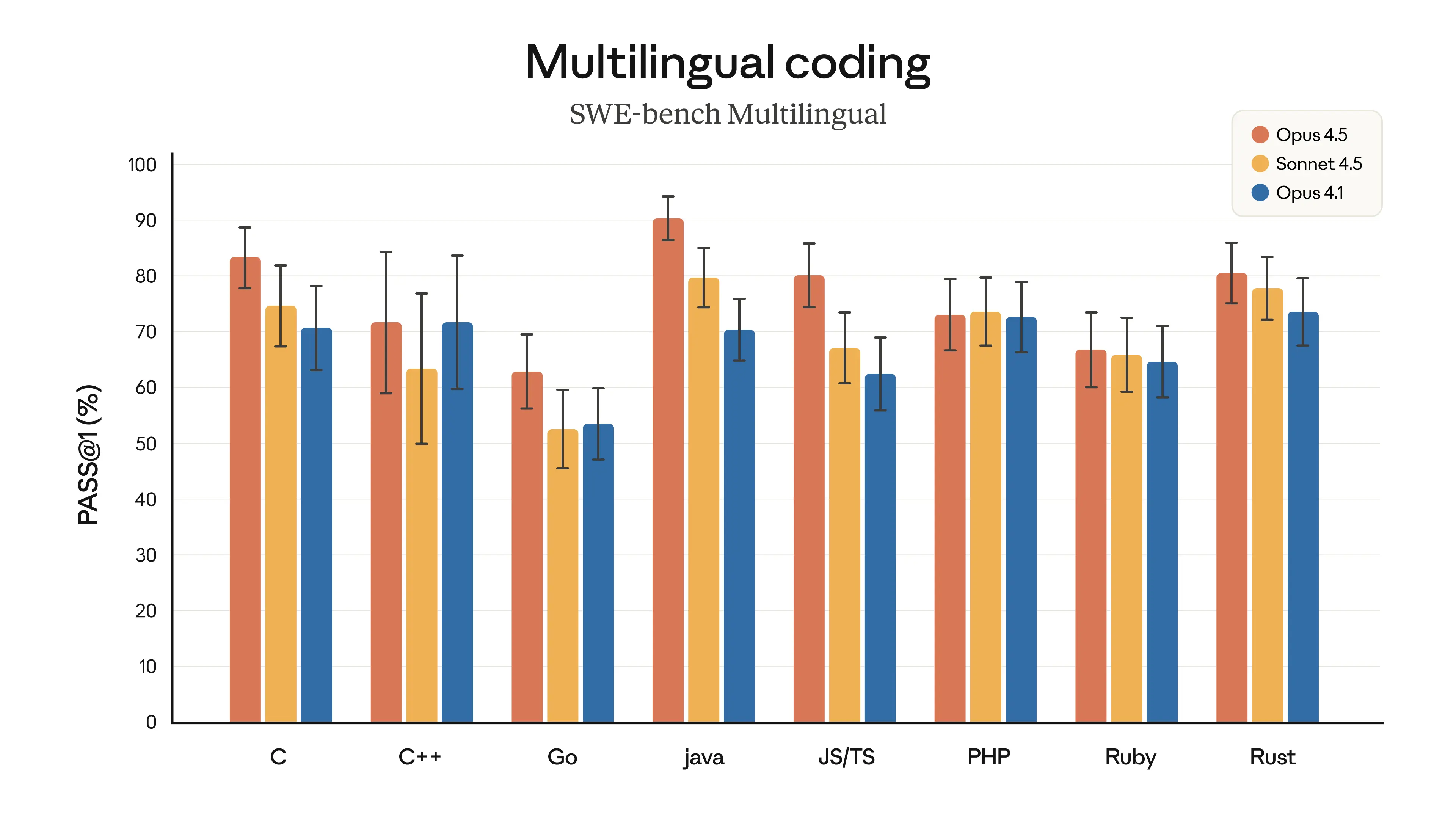

Anthropic最近推出新一代模型Claude Opus 4.5,不只更強,價格也直接砍到前代Opus 4.1的三分之一,每百萬Token輸入5美元、輸出25美元。最大亮點是它成為首個在SWE-Bench Verified程式碼修復測試中,贏過80%的模型,等於逼近甚至超越專業工程師。

Opus 4.5也在Anthropic自家工程測驗中打敗所有人類考生,在限時兩小時的高難度題目拿下史上最高分。這次新增的effort參數讓開發者可自己調整運算強度比例,包括推理深度、速度和成本。比如,中等effort模式,可以遠低於Sonnet 4.5的Token用量,達到相同最佳成績,節省76%的Token。

為展示模型的電腦操作能力,Anthropic同步推出Chrome與Excel整合功能,讓它能自動放大螢幕區域、跨視窗操作或在Excel生成樞紐分析。Opus 4.5還導入新的長脈絡策略,加入「選擇性脈絡壓縮」機制,能在脈絡逼近上限時自動萃取並保留關鍵內容,等於支援「無限聊天」,長程對話或專案不再因脈絡塞滿而被迫重來。(詳全文)

Google Nano Banana Pro AI生圖

Google推新一代AI生圖模型,AI畫圖更合理

Google日前發表全新的專業級AI繪圖模型Nano Banana Pro(Gemini 3 Pro Image),主打高畫質、會推理、能處理複雜構圖,還大幅改善了上一代最常被抱怨的文字錯字和變形問題。

這代最大升級有兩點,首先是推理能力變強,模型能透過Search grounding把真實內容直接畫成圖,例如食譜步驟、植物介紹、天氣變化、歷史背景或資料圖表,讓教育與商業用途的圖像更貼近事實。第二是文字終於清楚可讀,Nano Banana Pro能生成多語言文字,還能控制字體粗細、樣式與排版,適合做海報、包裝或介面原型,也能把英文圖片翻譯成其他語言並保持原本版面。

模型最多可同時處理14張圖片、維持5個人物的光線與外貌一致,並支援局部編輯、景深切換、相機角度與色彩分級等設置。圖像輸出解析度最高 4K,可直接用在廣告或簡報。目前Nano Banana Pro已能在Gemini App、Gemini API、Vertex AI、Google Ads和Slides等產品中使用,免費用戶用完額度會退回前一代,付費訂閱者則能使用較完整的功能。(詳全文)

OpenAI Code Max 大型專案

OpenAI推GPT-5.1-Codex-Max,可24小時跑大型專案

OpenAI推出最新預設程式開發模型GPT-5.1-Codex-Max,主打可連續執行超過24小時大型任務,也是首個針對Windows特別訓練的Codex模型。新版的最大亮點是支援超大型脈絡,也就是透過壓縮機制,讓模型在任務進行過程中自動摘要重要內容、移除不必要細節,能跨多個脈絡視窗,在單一任務中處理數百萬個Token。這讓使用者更容易完成大型重構、系統級修補和跨檔案依賴分析。

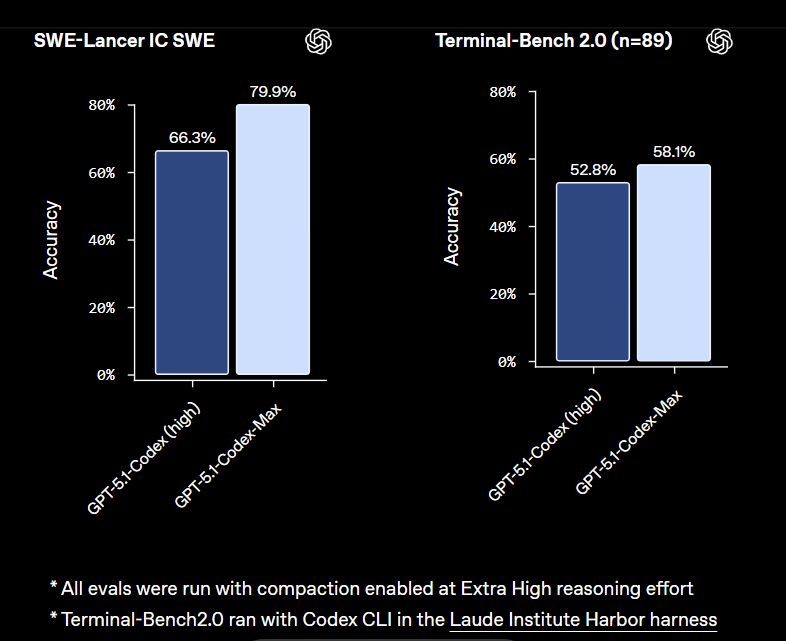

效能方面,Codex-Max在基準測試全面超越舊版,比如SWE-Bench Verified基準測試達到77.9%、SWE-Lancer達79.9%。OpenAI表示,在保持品質下,Max 可減少約30%的Token用量,真實任務速度提升27%~42%。實測中,同一任務前代需3.8萬個Token,Max只要1.6萬;程式碼行數也從667行縮短到529行,速度則快了40%以上。

OpenAI透露,內部已有95%工程師使用Codex,Pull Request的產量增加70%左右。目前Codex-Max已開放給ChatGPT Plus、Pro、Business、Edu和Enterprise訂閱戶,近期也將推出API。(詳全文)

Google 線性迴歸 充電樁

別小看線性迴歸,Google用它讓充電樁預測更可靠

Google研究團隊在替電動車設計充電路線規畫時,棄用複雜的大型模型,改用最基本的線性迴歸模型,預測駕駛在30~60分鐘後抵達充電站時,是否還能找到至少一個可用的充電樁。這個輕量模型直接整合進導航系統,讓路線規畫能避開「到站剛好沒位置」的時間點。

模型只有一個核心特徵:一天的24小時,每個小時都有自己的權重,反映該時段充電樁占用率的平均變化。權重為正表示樁位會越來越滿、未來空位減少;為負則代表樁位會逐步釋出;接近零則表示變化不大。這等於模型直接學會「現在到未來的占用變化率」,而不是模擬複雜的排隊行為。

Google用加州和德國的即時充電樁資料來訓練模型,並在多個站點驗證。結果顯示,在至少6個樁位的大型站點、且處於占用變化最快的尖峰時段(如早上與晚上8點),線性迴歸能明顯提升預測準確度,早上錯誤預測降低約20%,晚上則降低約40%。整體而言,這個極簡模型能有效減少電動車駕駛在繁忙時段撲空的機率。(詳全文)

Ai2 開源 Olmo3

Ai2推出真正全開源模型Olmo3

美國非營利研究機構 Ai2 釋出最新語言模型 Olmo3,主打「真正開源」——不只公開最終權重,連訓練資料、程式碼、評測流程、各階段 checkpoint,到能回溯推理來源的工具,全都開放釋出,使用者可完整重現並延伸模型,是目前少見的完全透明做法。

Olmo3分為7B與32B兩個系列,均以Olmo3-Base為核心,再依用途分為3種模型,包括: Olmo3-Think:加入多步推理訓練,可產生可閱讀的中間思考步驟。 Olmo3-Instruct:強化對話與指令跟隨,用於一般助手場景。 Olmo3-RL Zero:針對強化學習研究,提供多領域RL的完整檢查點。 開發者可直接用Instruct或Think,也能從Base或任一訓練階段接手,加入自家資料微調。

本次最受關注的是32B版Olmo3-Think,它不只會輸出推理步驟,還能透過OlmoTrace把思考鏈條回溯到可能相關的訓練資料,讓使用者檢視模型為什麼這樣回答。Ai2測試顯示,Olmo3-Think 32B在MATH、BigBench Hard、HumanEvalPlus等多項數學與程式推理評測中,多數成績逼近Qwen3 32B和Qwen3 VL 32B Thinking,並明顯領先Gemma3 27B Instruct等同級模型。(詳全文)

微軟 電腦代理 小模型

微軟開放Fara-7B,小模型也能自己操作網頁

微軟發表開放權重模型Fara-7B,主打只用70億參數就能在本機執行「電腦代理」,自動完成點擊、輸入、捲動等網頁操作。模型目前仍屬研究階段,官方建議在沙箱環境測試,避免用於敏感或高風險任務。

Fara-7B會讀取瀏覽器截圖,推論下一步該做什麼,可用於協助表單填寫、找資料、比價購物、訂票或管理雲端帳號,但全程仍需人類監看。它以 Qwen2.5-VL-7B 為基礎,支援長內容輸入,並透過監督式資料學會「看畫面 → 思考 → 行動」的流程。每次推理都會同時參考使用者指令、歷史行動與最近3張截圖,最後輸出一次工具呼叫,對應瀏覽器自動化框架Playwright的滑鼠與鍵盤動作,或瀏覽巨集。

微軟測試發現,Fara-7B的成功率優於同源模型UI-TARS-1.5-7B,也逼近OpenAI電腦使用預覽版等系統,同時需要的步數更少、成本更低。模型只處理截圖與必要資訊,不會額外存取網站資料,且所有動作都有完整紀錄,方便稽核。Fara-7B已整合到Magentic-UI研究原型,並可於Microsoft Foundry、Hugging Face和VS Code AI Toolkit下載試用。(詳全文)

超級電腦 國網中心 GPU

全球500強超級電腦排名公布:美國三巨頭稱霸、臺灣10臺上榜

最新一屆Top 500超級電腦榜單出爐,美國再次包辦前三名,包括El Capitan(1.809 Exaflop/s)、Frontier(1.353 Exaflop/s)、Aurora(1.012 Exaflop/s),第四名則是歐洲首度突破1 Exaflop/s的JUPITER Booster,部署於德國Jülich超級電腦中心。

美國三大系統涵蓋了核武安全、氣候和宇宙模擬、材料科學與AI等科研任務。JUPITER Booster則是美國以外首個Exascale等級系統,支援歐洲在氣候、量子與AI訓練領域的重點研究。

臺灣這次共有10臺上榜、數量居全球第九,包括國網中心的Nano 4(第29名)、友崴Ubilink(第49名)以及Nvidia TAIPEI-1(第80名)等。國家分布方面,美國以171臺遙遙領先,日本43臺、德國40臺、中國40臺、法國22臺。硬體方面,最常見處理器為Intel Sapphire Rapids(14.6%)與AMD Milan(13.8%),而Nvidia GPU則支援了500強中86%的系統,持續主導超級電腦運輸加速生態。(詳全文)

圖片來源/Google、Anthropic、OpenAI、微軟

AI近期新聞

1. 高通發表Snapdragon 8 Gen 5行動平臺,AI效能提升46%

2. Google自家AI生成圖像全面嵌入C2PA與SynthID浮水印

3. 微軟發表相容PostgreSQL的Azure HorizonDB,支援大型工作負載還內建AI功能

資料來源:iThome整理,2025年11月

熱門新聞

2026-03-06

2026-03-06

2026-03-09

2026-03-09

2026-03-06

2026-03-09