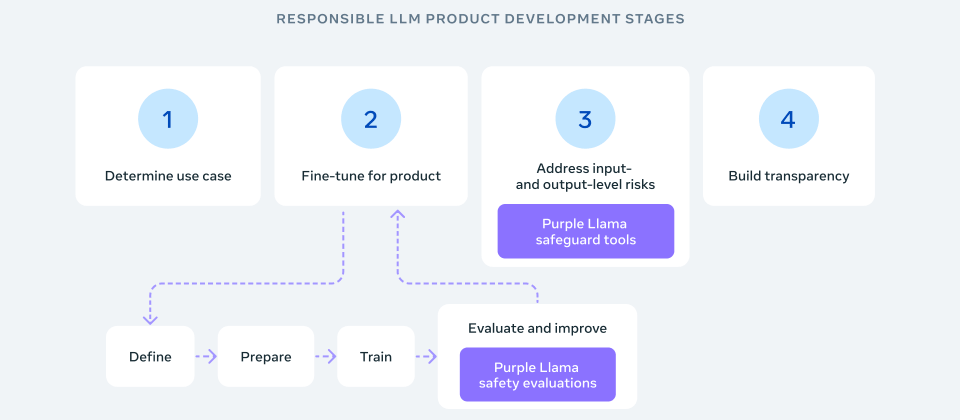

Purple Llama是一個由Meta推出的新專案,目的在於提供開放信任且安全的評估標準與工具,使得開發者可以在遵守最佳實踐的指引下,負責任地部署生成式人工智慧模型與應用程式。Purple Llama目前提供CyberSec Eval評估標準,和Llama Guard輸入輸出安全分類器,之後會有更多的工具加入。

Meta推出Llama語言模型,總下載量已經超過1億次,支援著各種人工智慧應用的發展,而Meta的新一階段任務,是要推動發展負責任的人工智慧研究和應用,因此推出Purple Llama專案。之所以是紫色(Purple),Meta借用資安領域的紫隊概念,紫隊是攻擊紅隊和防禦藍隊的結合,在生成式人工智慧中評估和緩解潛在威脅,而官方也提到,這代表他們投資Purple Llama全面發展,兼顧攻擊和防禦策略。

Purple Llama在網路安全方面,著重在建立安全評估基準,包括量化大型語言模型網路安全風險的指標,以及評估不安全程式碼建議頻率的工具,還有讓生成惡意程式碼,或是協助網路攻擊更加困難的大型語言評估工具。官方提到,目前研究結果顯示,大型語言模型的確存在推薦不安全程式碼,以及在應對惡意請求方面存在明顯的安全風險。

在過濾輸出和輸入方面,Purple Llama提供了一個稱為Llama Guard的分類器,事實上Llama Guard是一個開放模型,可用於檢查和過濾大型語言模型的輸入和輸出,以符合特定應用的內容指導原則,防止大型語言模型生成具有潛在風險的輸出。Llama Guard使用公開的資料集訓練,以偵測常見的潛在風險和違規內容,用戶可以自定義模型,以支援特定用例。

除了發布Purple Llama,Meta也與包括AI聯盟、AMD、AWS、CloudFlare、Google雲端、Hugging Face、英特爾、微軟和Nvidia等各大科技公司合作,共同推動開放信任和安全的人工智慧生態系,同時,Meta也與Papers With Code、HELM的合作夥伴以及MLCommons AI安全工作小組合作,讓Purple Llama評估工具整合進他們的基準之中。

熱門新聞

2026-03-06

2026-03-06

2026-03-09

2026-03-06

2026-03-09

2026-03-06