Amazon利用生成對抗網路(Generative Adversarial Networks,GAN)依據文字產品描述,來產生相匹配的產品範例,讓購物者可以依視覺指引,逐漸修正文字查詢,直到能夠檢索出正在尋找的產品為止。

Amazon提到,生成對抗網路能夠良好地處理圖像合成任務。生成對抗網路由兩個網路組成,一個為生成網路,目標是盡可能的產生仿真的虛假樣本,而另一個為判別網路,試圖辨識出生成網路所產生的虛假樣本,並區分出真實樣本,這兩個網路一起訓練,之間的競爭可收斂在一個有用的生成模型上。

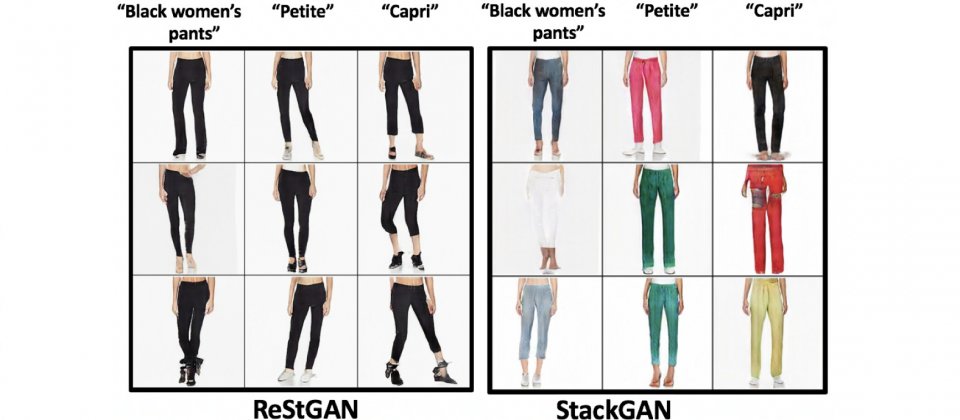

將生成對抗網路用在Amazon的這個案例上,可讓購買者更簡單地探索出想像中的服裝,像是購物者可用文字描述「女性的黑色長褲」搜尋長褲商品,並且根據搜尋出來的結果,後續添加「嬌小」和「卡普里褲」等特徵,系統根據新的單詞調整顯示的圖片。Amazon這個系統特別之處,在於添加新特徵後還能夠保留舊視覺特徵,並產生與文字描述相符的顏色。

Amazon應用的新方法稱為ReStGAN,是修改自常用的文字轉圖像生成對抗網路StackGAN模型。StackGAN將合成圖像簡化成兩部分,其一是從文字產生低解析度的圖像,接著在圖像上進行採樣,以進一步產生具有材質和自然色彩的高解析度圖像。這兩個程序各有其生成對抗網路,將兩個生成對抗網路堆疊在一起就成了StackGAN。

而Amazon在StackGAN增加了長短期記憶(Long Short-Term Memory,LSTM)元件,長短期記憶是一款依序處理序列輸入的神經網路,Amazon提到,將長短期記憶與生成對抗網路一起訓練,這個網路將可隨著相繼輸入的單詞,逐漸修改圖像。由於LSTM是一種時間循環神經網絡(Recurrent Neural Network,RNN),因此新網路名稱為遞迴StackGAN,縮寫為ReStGAN。

由於從文字敘述合成圖像這項任務仍然非常困難,為了降低複雜度,Amazon將應用限縮在長褲、牛仔褲和短褲三種類似的產品,並且標準化用於訓練模型的圖像,除了移除背景之外,也進行剪裁和調整大小,使其比例與形狀都相同。

新模型的訓練大多使用無監督式學習,也就是訓練資料主要由產品名稱和經標準化的圖片組成,沒有任何的人工註解,不過為了提高系統的穩定度,Amazon使用了輔助分類器,根據褲子類型、顏色以及適合的性別三個屬性進行分類。

在顏色合成上,Amazon提到,傳統單詞嵌入將顏色名詞分在同一群,但是並沒有結合人類感知經驗,因此Amazon開發了新方法對顏色編碼,他們在LAB色彩空間中對顏色進行分組,這個色彩空間的特性,是顏色點之間的距離,與人類感知到的顏色差異相符。Amazon利用分組的顏色建立查詢表格,將視覺相似的顏色,對應到文字描述相同的特徵中,而建立顏色查詢表格附帶的好處是,模型更能夠合成出具自然顏色的圖像。

Amazon以可辨識度和多樣性作為指標,計算類型、顏色以及性別三個屬性的分數,以比較ReStGAN和StackGAN模型,在類型和性別上,前者比後者分數提高了22%和27%,而顏色分數則改進100%,Amazon提到,這代表使用新的顏色模型效果明顯。

熱門新聞

2026-03-06

2026-03-06

2026-03-09

2026-03-09

2026-03-09