幾乎所有的人對華生電腦的印象,都停留在「危險邊緣」節目上看到的畫面:冷冰冰、深紫色系的電腦螢幕,豎立在另外兩位人類參賽者中間,會發出詭異的電腦語音。

完整的華生電腦,當然不只是電視螢幕上看到的那樣,如果有機會前往紐約參觀IBM全球研發中心位於約克城高地的實驗室,你就會看到原汁原味的華生電腦,不但能夠理解為什麼華生電腦能在「危險邊緣」中勝出,也會同意為什麼非得用顛覆傳統的方式,才能設計出新世代的認知運算電腦了。

華生電腦放置在約克城高地實驗室二樓的資料中心,由九十二臺伺服器組成,堆滿整整兩排冰箱大小的金屬框架。這兩排金屬框架之間的走道盡頭,有一道門,形同把華生電腦所在的房間,再隔出一個小房間。走進這個小房間,你會聽到室內空調的風扇跟伺服器本身的小風扇一起嗡嗡作響,震耳欲聾,可見華生電腦微處理器散發的熱量非常可觀。這可不是一件好消息。

固然,在「危險邊緣」比賽的時候,華生電腦微處理器運作的速度,比世上第二快的一般電腦的運作速度,還要再快上以資料為中心的電腦一倍;但是代價就是,華生電腦會散發龐大的熱量、以及散熱風扇會發出不小的噪音。這顯示了耗能問題非常嚴重:華生電腦全速運轉時的耗電量,高達八萬五千瓦,足以提供一座小鎮的照明所需;相較之下,人腦只需要消耗二十瓦的能量而已。

除非我們可以用連跳好幾個數量級的方式,來提升電腦的運作效率,否則未來認知運算電腦的成本,將高到很難成為我們廣泛運用的好幫手。IBM全球研發中心的科學家認為,如果要在大數據時代設計出符合環境永續概念的電腦,我們一定要能設計出新型態的電腦──以資料為中心的電腦。

新電腦必須大幅減少傳輸資料的動作

傳統電腦以處理器為核心,由微處理器扮演馮諾伊曼架構裡中央處理器的角色,這自然也是電腦執行最多動作的地方。微處理器搭載作業系統後,會向電腦的其他組件發出指令,像是要求記憶體、硬碟傳輸資料等。而如果是大型網路中的一臺電腦,則有可能需要用遠端傳輸的方式,才有辦法取得其他電腦儲存的資料。

新世代的電腦一定要能大幅減少傳輸資料的動作,也就是以資料、而不是處理器做為運作核心。按照IBM先進系統設計部門主管達華里(Bijan Davari)的說法,新的設計架構將可以把許多任務畢其功於一役,不但可以增加電腦運作的速度,大幅提升省電效果,更重要的是促成充分利用大數據的可能性。

電腦的運算能力自從1970年代,工程師開始在單晶片裡塞進愈來愈多的電晶體後,獲得了迅速提升,專業術語叫做堆棧(scaling),意指在相同面積上堆放更多資源的能力,好比說是更緊密的電路布局、或是更多的記憶容量。而在單晶片完成更多堆棧的過程,就叫做微縮(scaling down)。

不論是企業界或是政府單位的電腦,經過多年使用之後,都需要更優秀的運算能力,因此電腦業者開始推出伺服器,專門處理大量、複雜的工作,主要的做法有兩種,其中一種是在一臺伺服器內,裝上運算能力更強的零組件與其他資源,通稱為升級(scaling up),IBM的大型主機即採取這種做法;另一種做法是擴充(scaling out),是把多臺伺服器串連、視同一臺大型伺服器般使用,這也是超級電腦跟Google資料中心伺服器大軍的做法。

IBM的科學家相信,未來以資料為中心的電腦將具備一種基本特徵:電腦工程師會設法把記憶體跟邏輯線路,整合在一以資料為中心的電腦顆緊緻的立體晶片中,採用斂合(scaling in)的新堆棧方法。

新玩意:混合記憶體模塊

現今的記憶體只是把一層矽晶跟數不清的資料存取線路,整合成一顆電子元件,主要做為資料暫存區之用,並依照微處理器的需求傳輸資料。

記憶體在電腦內占有一定空間,資料傳送也是個負擔沉重的工作;如果把記憶體晶片像一層層烤餅堆疊在一起呢?那不但可以大幅縮減體積,同時也能減少資料傳送的負擔。這種新概念的產物,就是IBM與其他電腦大廠正在研發的混合記憶體模塊(hybrid memory cube)。

混合記憶體模塊是個奇特的小玩意兒,可以在一個立方體內把好幾層記憶體堆疊在一起,在垂直貫穿模塊的一個小通道內配置線路,用銅線把所有物件串連在一起,讓最底層的邏輯線路可以直接連結到其他各層的記憶體,只把萃取過的減量資料傳送給微處理器統合使用。這種新設計可以縮減現有記憶體百分之九十的體積,減少百分之七十的耗能。

未來,記憶體模塊渴望再內建微處理器,逐步走向記憶體與處理器合而為一的境地,打破馮諾伊曼瓶頸的限制。

這項新科技會對未來的電腦帶來重大影響,譬如用於原油探鑽、汽車撞擊測試的大型超級電腦,體積會變得更小、更省電,下一代使用混合記憶體模塊的伺服器資料中心,也不再需要在龐大的室內空間耗掉可觀的散熱電力。這項技術繼續發展的話,未來即便是智慧型手機、平板電腦、或是其他行動裝置,也都可以將運算能力提升到一個難以想像的境界。

新概念:微處理器分散架構

以資料為中心的電腦具備的第二種基本特徵是:電腦內部的分散式配置方式。

今日的電腦,有微處理器擔任神經中樞的角色,負責處理所有或大部分的運算工作,因此運算時派得上用場的資料,都要在原本存放的位置與微處理器之間不斷往返傳遞,用跑馬拉松來形容也不為過。未來以資料為中心的電腦,會把微處理器分散在系統的不同位置,大大降低資料搬動的必要性。

微處理器分散架構的概念,已經在某些專門用於分析龐大資料數據的特用電腦上進行測試。紐約州立大學水牛城分校神經科學教授拉曼納森,即參與了其中某一項測試計畫。

多發性硬化症會讓人痛苦異常,患者的免疫系統會主動攻擊自身的大腦與脊髓,導致病患失去行動能力,並造成認知失調問題。這種疾病多半會在年輕成年人的身上發病,目前病因成謎,也無法醫治。拉曼納森的研究主題,是找出基因和環境因素與多發性硬化症的相關性,進而找到醫治的方法,或是起碼找到能夠預先防治的方法。拉曼納森研究工作最大的挑戰,在於人類基因可能導致多發性硬化症的組合方式實在太多了,如果再加上飲食作息、抽菸喝酒等環境因素的影響,則多發性硬化症潛在病因的可能組合,將呈現指數般的爆炸性成長。

換句話說,拉曼納森的研究重點在於克服龐大資料帶來的技術障礙,而傳統超級電腦欠缺大量平行運算的能力,因此也沒辦法有效處理拉曼納森所面對的問題──亦即所謂資料密集(data-intensive)的問題。拉曼納森需要一臺可以把研究主題切割成許多分段、送交好幾千顆微處理器進行平行運算後,再從平行運算的結果推導出最後答案的電腦。如果要有效解決拉曼納森面臨的難題,勢必要採用平行運算搭配以資料為中心的微處理器架構。

於是,拉曼納森的研究團隊設計一臺專門用於資料密集分析的電腦,這臺冰箱大小的專用電腦採用特製的微處理器「現場可程式閘陣列」(field programmable gate array, FPGA),在資料儲存區先行過濾資料,之後再把有用的部分傳給中央處理器,進行後續的資料分析。這套微處理器可以程式化設定需要搜尋的資料,因此可以有效過濾高達九成的資料量,讓中央處理器僅針對篩選過的資料進行分析即可,不用照單全收;就形式上而言,如同傳統電腦只在記憶體進行存取,省去讀取硬碟的步驟。如此一來,這臺專用電腦可以減少資料搬動,連帶達到省電效果,並提升電腦中樞的運算速度與效率。

接下來,我們用拉曼納森研究團隊實際取得的績效,說明這臺新電腦的效率高到什麼程度。研究團隊完成安裝後不久,把十萬種基因組合與包含各種環境因素在內的資料,統統輸入電腦進行運算──相當於有五十億種「雙變數」的組合、或是一百兆種「三變數」的組合需要進行推算。

結果,新電腦只花了十一分鐘,就把傳統電腦需要花二十七小時計算的答案,給算出來了。坐在紐約州立大學辦公桌前的拉曼納森,收到一封運算結果摘要報告的電子郵件,他說:「這個結果讓我感到興奮莫名,有如在眼前開啟了一扇機會之窗。我們,終於有機會解決以往難以處理的問題了。」

以光子技術傳輸資料

無論在電腦系統的哪個地方處理資料,用更快、更有效率的方式搬動資料,當然還是基本功。這就是以資料為中心的電腦,必須具備的第三種基本特徵。

一般公認,借助光子學(photonics)的原理,將可更迅速的搬動資料,也就是用光波來製造訊號、傳送訊號、處理訊號。電話公司和寬頻網路業者已經在光纖電纜內,用脈衝光束的方式加速資料傳送的速度,以便和遠端進行語音交談或是分享電影、電視等多媒體內容;大樓內部和資料中心的電腦之間,也可以用光纖傳輸資料。未來,光子學技術可望運用在伺服器內部、甚至是電路板上的資料傳送,最終也不排除在晶片內以光子技術傳輸資料的可能。

IBM全球研發中心有一群科學家,利用十年的研究計畫取得奈米光子技術的重大進展。他們在單一矽晶片上,整合了傳統電子元件與光學元件,稱為CMOS整合奈米光子(CMOSintegrated nanophotonics)技術,這將有助於大幅度提升各種電腦的效能。目前,先進電腦仍舊用不同的晶片處理光學元件,就成本與效能而言都還有改善空間。這項CMOS整合奈米光子新技術,不但把光、電元件整合在單一晶片上,還可以讓晶片製造業者沿用現有生產設備,盡快達成量產的目標。

搬動一個位元的成本是多少?

「電腦運作的時候,搬動一個位元的成本是多少?」顯然這是一個不值得花時間回答的問題。因為在當前資訊科技的環境裡,這個成本是微乎其微。

問題是,電腦科學家已經注意到進入大數據時代後,遠距離搬動巨量資料的成本會有爆炸性成長,即便在短距離來回多次搬動資料,成本亦會暴增。

這就是IBM主管「百萬兆級運算」(exascale computing)的副總裁特瑞克(David Turek),在2011年向共聚一堂的IBM電腦系統專家提出這個問題的源由。特瑞克說:「還好這些專家願意正面看待我所提出的笨問題。進入大數據時代後,我的笨問題會開始變成大問題,所以必須找出能夠真正量化資料移動成本的方法。」

特瑞克的簡單問題,促使IBM啟動一項從根本改變電腦架構的研究計畫:代號DC2的「以資料為中心的深度運算計畫」(Data Centric Deep Computing)。這是IBM自1960年代初發表360系列大型主機之後,最能徹底檢討、反思該如何設計電腦的一次顛覆性創舉。這項研究計畫促成新的創新文化,以及下定決心拋棄舊觀點、一切重頭來過的特性,都值得大書特書。

負責主導DC2研究計畫(並且要能夠回答特瑞克的成本問題)的科學家是名列IBM院士之一的卡爾(Jim Kahle)。卡爾在過去三十多年,曾帶領數個研究團隊完成不少最先進的晶片設計,包括索尼PlayStation遊戲機上專用的Cell處理器、超級電腦「走鵑」(Roadrunner)、以及其他先進的數位電視晶片組等。其中比較可惜的是Cell處理器,並未如卡爾預期般的在所有運算設備中大放異彩,因此卡爾希望DC2計畫能夠帶動電腦革命性的新設計,以前所未見的高效能,實現當初Cell處理器沒有達成的目標。

卡爾很能跟各有所長的專業人士溝通,讓各種新想法都有浮上檯面參與討論的機會,這些都是推動DC2研究計畫不可或缺的重要經驗。

DC2研究計畫啟動後的前幾個月,卡爾廣泛召集不同背景的專家,一起描繪十年以後的電腦會有哪些新用途、新功能,討論研究團隊應該提前做出哪些準備。這些專家的背景包括半導體工程、光子學技術、記憶體模組開發、系統架構、電腦軟體以及數學家、統計分析師等,他們的觀點讓認知運算時代該有的電腦架構逐漸在卡爾腦海中成形,並開始擬定完成計畫目標的執行步驟。

卡爾說:「我們必須先重新自我組織工作團隊。打破本位主義可不是一件簡單的事,但是我們必須改弦易轍,朝新方向前進。」

讓中央處理器走出深宮內院

DC2計畫截至目前為止還在進行中,距離最終成果發表的階段還很遙遠,不過研究團隊已經確立許多有助於他們完成目標的基本原則:他們相信,研究成果必須奠定在把原本以處理器為核心的想法轉型成以資料為中心的想法上。

卡爾記得,以資料為中心的想法是在2011年的年底,才突然成為研究計畫的重心,當天他和十幾位研究人員在約克城高地實驗室的36-002會議室(這是DC2研究計畫的戰情資料室)裡,每個人都覺得前途茫茫。儘管大家對於新科技的突破都有不錯的想法,但是卻一直欠缺一以貫之的大方向。

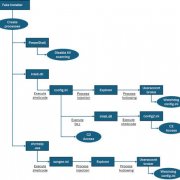

此時,其中一位遲到的成員內爾(Ravi Nair),推開會議室大門走進來,把手上那張草圖傳給其他同事瀏覽。草圖左邊是傳統電腦在各層級儲存系統移動資料的過程──從硬碟進入記憶體,最終再到處理器的過程;右邊則是直接在每一層級處理資料、以及分散式架構的省電效果。這張圖讓卡爾靈光乍現:研究方向應該是讓傳統電腦的處理器走出深宮內院才對!未來電腦將不會再有唯一的中央處理系統,處理器會分散在電腦系統的不同位置,資料為主、處理器為輔。

這個石破天驚的見解,跟設計新的電腦架構有什麼關係?

這就要回到幾星期前,特瑞克提出的那個最根本的問題了:搬動一個位元的成本到底是多少?下班回家後的卡爾,好好想了一個值得參考的比較基準。簡單來講,把該位元搬動到網路上的成本介於800到6,000兆分之一美元,視真正的移動距離而定;如果該位元只在一臺電腦內部移動的話,成本只介於6到27兆分之一美元而已;換句話說,長距離移動資料再行處理的成本,比直接在資料旁邊進行處理的成本,高上大約兩百到一千倍。

未來願景:桌上型超級電腦

在不同狀況下,搬動資料的成本變化頗大。卡爾所率領的研究團隊精確估算過每一種狀況下的成本效益分析,因而得到一些非常實用的結論,例如讓電腦系統裡某些特製的處理器,專門解決特定的工作項目。

卡爾的研究團隊也會採取分流處理的做法:有時候是讓記憶體、硬碟旁邊的處理器,或是把守資料匯流進入系統的處理器,就近發揮功效,以達到最佳化效果;有時候(依工作性質不同)則是讓中央處理器,直接存取大多數的資料。

目前卡爾的研究團隊兵分兩路,一部分開始著手打造新電腦所需要的硬體零組件,另一部分則致力於開發運作新電腦所需要的軟體架構。這兩者缺一不可。打造以資料為中心的電腦可能要花上好幾年時間,無論如何,研究團隊希望未來的電腦可以辨別被指派的工作項目,自動安排系統內部不同的處理器分工合作,就好像交響樂作曲家,安排不同樂器演奏不同的音符、發出不同聲響的效果一樣。

針對大數據時代設計新型電腦,絕對是一份吃重的工作,但是新型電腦潛在的發揮空間,會讓這一切的努力付出,值回票價。或許十年後,就可以看見當前運算速度最快的超級電腦居然可以精簡成辦公桌上的一個盒子了,更何況未來運算速度最快的電腦究竟能完成哪些工作,恐怕也已經不是現在的我們可以想像的了。(摘錄整理自第五章)

未來電腦將不會再有唯一的中央處理系統。處理器會分散在電腦系統的不同位置──資料為主、處理器為輔。

作者簡介

凱利三世(John E. Kelly III)

IBM資深副總裁暨全球研發中心總負責人,帶領全球最大的企業研究機構,總計有三千位科學家與技術人員,分布在全世界十個國家的十二個實驗室。

哈姆(Steve Hamm)

曾經擔任財經科技記者,《商業週刊》(BusinessWeek)資深作家,目前在IBM公關部門負責文案撰寫與影像記錄的工作。

熱門新聞

2026-02-09

2026-02-06

2026-02-06

2026-02-06

2026-02-06

2026-02-06