物件偵測模型大變革YOLO v7

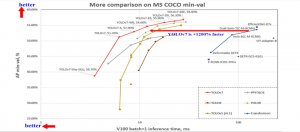

中研院發布全球第一物件偵測模型YOLOv4,將臺灣推向世界級電腦視覺技術研發重鎮行列,更接連打造出突破傳統思維的網路架構ELAN和多任務模型YOLOR,整合而成新一代的YOLOv7,能一心多用執行3種偵測任務,一問世就完勝主流模型。中研院YOLO研發團隊的下一步要鎖定多任務和圖類神經網路

【臺灣AI研發力再次奪冠關鍵】世界第一物件偵測模型如何超越自己

中研院發表YOLOv4後,轉向研究新網路架構與多任務AI,結合2者打造YOLOv7,不只超越當時SOTA模型,還能一心多用執行3種任務,更兼顧2大生態

文 /|2023-03-27

【YOLOv7成功關鍵:技術篇】關鍵人物親自揭露三大突破,下一步攻多任務與解釋性

打造世界冠軍物件偵測模型YOLOv4後,中研院團隊繼續鑽研更有效率的網路架構和多任務AI,這2大技術加上獨到的訓練策略優化方法,催生出YOLOv7,一問世就打敗當時的SOTA物件偵測模型

文 /|2023-03-27

【YOLOv7成功關鍵:生態圈】通吃兩大AI生態圈,公開設計思維和程式碼為研發點燈

YOLOv7不只採用了PyTorch主流框架,也自建轉換器繼續支援業界部署常用的Darknet框架,兼顧AI研發與業界兩大族群需求。團隊同時公開模型背後關鍵架構設計理論,盼激發更多新點子

文 /|2023-03-27

按讚加入iThome粉絲團追蹤