Meta

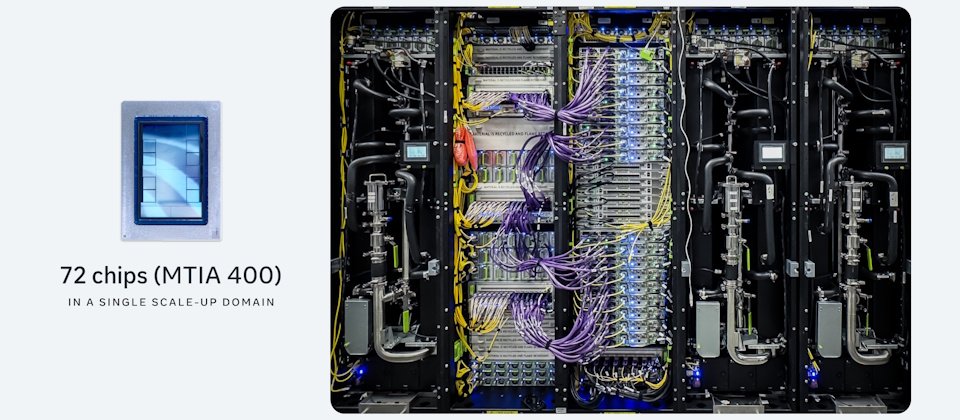

Meta近日揭露其自研AI晶片MTIA(Meta Training and Inference Accelerator,Meta訓練與推論加速器)的最新進展。Meta表示,近兩年已規畫出MTIA 300、MTIA 400、MTIA 450與MTIA 500四個世代晶片,其中MTIA300已投入生產,MTIA 400正準備部署,而MTIA450與MTIA 500則預計於2027年大規模部署。

MTIA是Meta與Broadcom合作開發的AI加速器,主要用於AI模型(model)的訓練與推論。Meta指出,每天有數十億用戶在其平臺上使用AI功能,包括內容推薦與AI助理,因此要如何在全球規模上支援各類AI模型,同時控制運算成本,是AI基礎設施的重要挑戰。

先前Meta已推出前兩代MTIA晶片MTIA100與MTIA 200,相關設計分別於2023年與2025年公開,並已在資料中心部署數十萬顆MTIA晶片,用於支援內部AI服務。這些晶片主要負責Meta平臺上的排序與推薦系統(Ranking and Recommendation,R&R)推論工作負載,例如社群內容推薦與廣告排序等核心演算法。此外,Meta也已將部分大型語言模型(Large Language Model,LLM)移至MTIA平臺上進行測試。

隨著生成式AI(Generative AI,GenAI)快速發展,Meta的AI運算需求也正從過去以推薦系統為主,逐步轉向生成式AI與大型語言模型的推論服務。

在硬體設計上,MTIA晶片持續提升記憶體頻寬與計算能力。從MTIA 300到MTIA 500,高頻寬記憶體(High Bandwidth Memory,HBM)頻寬提升約4.5倍,而計算能力(FLOPS)則提升約25倍。Meta表示,HBM頻寬是影響生成式AI推論效能的重要因素,因此新一代晶片特別強化HBM頻寬,以加速大型語言模型的推論運算。

此外,MTIA也加強對低精度運算的支援,例如MX4與MX8等資料格式。這類低精度運算可在維持模型品質的情況下提高推論吞吐量,已成為生成式AI推論的重要技術方向。

Meta指出,AI模型的演進速度已超過傳統晶片開發週期。一般晶片設計往往需要約兩年才能完成並投入生產,但AI工作負載在此期間可能已出現重大變化。因此Meta採取快速迭代策略,透過模組化chiplet架構與可重用系統設計,使晶片開發節奏縮短至約每六個月推出新一代產品。

Meta強調,公司將持續採取多元晶片策略,在自家研發的MTIA晶片之外,也會搭配外部供應商產品,例如GPU,以支援不同類型的AI工作負載。不過隨著生成式AI服務需求快速成長,Meta正透過自研AI晶片與快速迭代策略,強化其AI基礎設施能力,並試圖降低大規模AI服務的長期運算成本。

熱門新聞

2026-04-27

2026-04-27

2026-04-28

2026-04-27

2026-04-25

2026-04-27

2026-04-24