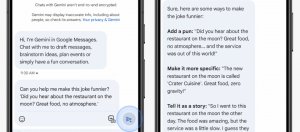

Google將AI加入Android訊息、圖片識別、Auto

Google將Gemini內建於Messages應用程式,讓用戶能以文字對話方式,要求AI助理草擬訊息內容、發想創意或規畫活動

2024-02-27

Google開發視覺編碼器VideoPrism,在通用影片理解任務表現優異

Google新開發的VideoPrism,是一款可處理多種影片理解任務的先進視覺編碼器,在多項基準測試中打敗當前先進的基礎模型,而且與大型語言模型結合,在多個視覺語言基準測試中更設下新的技術水準

2024-02-27

| Gemini Nano | 聯發科 | Dimensity | google | AI

Google Gemini Nano模型將可執行於聯發科晶片組,首支援中階手機

繼旗艦機種Google Pixel 8 Pro、三星Galaxy S24系列後,Google專門為行動平臺設計的Gemini Nano模型,將能在搭載聯發科Dimensity 9300 與8300晶片組的中階手機上執行

2024-02-26

除了技術與內容上的合作,路透社報導宣稱Google將每年支付6千萬美元給Reddit,以取得該社交平臺內容做為AI模型訓練資料

2024-02-23

| google | AI聊天機器人 | Gemini | 圖像生成

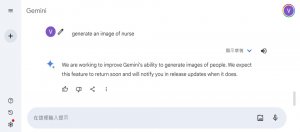

Gemini多元化矯枉過正,遭Google暫停人物圖像生成功能

近期Gemini在生成用戶要求的人類圖像時,卻以族群多元化原則來改造歷史人物或名人長相,促使Google緊急修正,關閉自家AI聊天機器人的人物圖片生成功能

2024-02-23

| IT周報 | 合成資料 | Hugging Face | Groq | LoRa | 微調 | Gemma | google

AI趨勢周報第244期:Hugging Face開源最大合成資料集Cosmopedia

Hugging Face開源全由Mixtral模型生成的250億個Token合成資料集;突破GPU瓶頸!Groq用LPU推論引擎提供最快LLM服務;Google開源AI模型Gemma;BigQuery推出向量搜尋功能,還支援RAG;復旦大學開源優化器LOMO,大幅降低LLM訓練的記憶體資源

2024-02-23

Google公布開源AI模型Gemma,支援多種框架、可跑在筆電上

根據Google公布的測試數據,Gemma 7B在推論、數學、撰寫程式上,超越Llama 2 7B以及Mistral 7B

2024-02-22

Flutter 3.19持續更新渲染引擎Impeller,Android支援度再提升

Flutter 3.19更新包括框架與API的改進,加入Gemini Google AI Dart SDK,而渲染引擎Impeller則更好地支援OpenGL後端,現在幾乎所有Android裝置上的Flutter應用程式,都可以使用Impeller正確渲染

2024-02-21

Google公開Android 15預覽版,開始支援新的廣告技術隱私沙箱,並改進硬體的控制與支援能力,更新的動態效能框架新功能,可使應用程式更好地權衡節能與效能

2024-02-20

| Gemini 1.5 | 多模態模型 | Gemini 1.5 Pro | google

Google發表Gemini 1.5,可支援長達100萬個Token的脈絡

最先採用Gemini 1.5模型的產品為Gemini 1.5 Pro,其標準脈絡長度為12.8萬個Token,Google計畫隨著模型的改善擴大到100萬個Token,將可一次處理1小時的影片、11小時的音訊或超過3萬行的程式碼

2024-02-16