背景圖片來源/Photo by rc.xyz NFT gallery on Unsplash

研究人員發現AI模型資源平臺Hugging Face上存在API漏洞,洩露包含微軟、Meta及Google等公司的API驗證資訊,嚴重者可能讓攻擊者污染訓練資料集或竊取、改造成惡意的AI模型。

隨著大型語言模型(LLM)快速普及,GitHub和Hugging Face也成為許多LLM專案開發人員愛用的資源平臺。其中,Hugging Face一項重要功能是開源碼函式庫Transformers。這個函式庫裏代管了50萬個AI模型及25萬項資料集,包括Meta的Llama、Bloom、Pythia及其他預訓練模型。Hugging Face提供API,供外部開發人員及企業將Python函式庫整合到其模型,或讀取、新增、修改或刪除儲存庫或檔案。GitHub的API也是類似功能。若取得GitHub和Hugging Face API驗證令牌,可能導致企業資料外洩、惡意模型散布等不良後果。

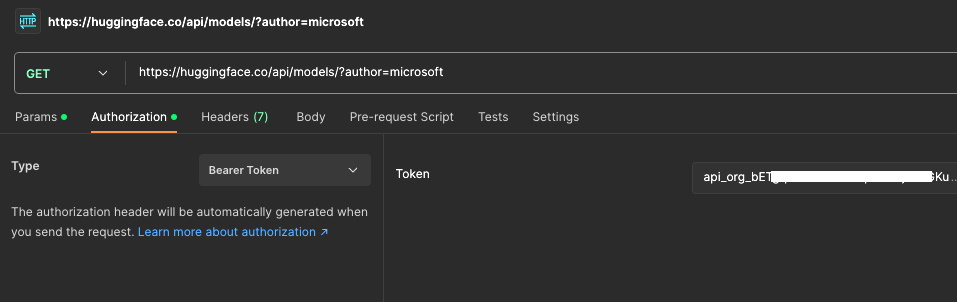

資安廠商Lasso Security近日在一項研究中,發現不論GitHub或Hugging Face都可能讓不肖人士從其儲存庫(repository)取得平臺上各模型供應商的API驗證令牌(token),得以存取模型或其他程式碼。研究小組一共從兩平臺上找到1,681個有效的令牌。經過一步分析資料,他們取得了723家企業組織的帳號,包括Meta、微軟、Google、VMware及Hugging Face等。其中655個令牌具有寫入權限,其中77個還能寫入多個組織系統,令研究人員得以全權控制多個知名公司的程式碼儲存庫,如Hugging Face上的Pythia的EleutherAI、Bloom的BigScience Workshop、Meta Llama 2等,都是下載次數超過百萬的熱門模型。

研究人員警告,只要控制這些程式碼儲存庫,就能發動多種攻擊。像是最基礎的竊取模型和資料集,或是污染資料集:研究人員從API取得14個每月下載次數數十萬的資料集,得以扭曲機器學習模型的完整性。最嚴重的是供應鏈攻擊:改造現有模型使其成為惡意模型,危害大量依賴這些基礎模型的應用程式。

他們還意外發現到一個Hugging Face之前宣布已停用的org_api tokens,只要稍稍變更程式碼,雖然無法寫入Python函式庫,但仍可讀取,讓研究人員成功下載多個不公開的模型,包括微軟擁有的模型。

研究人員最後通報Hugging Face以及研究中其他受影響的組織,像是微軟、Meta、Google及VMware及GitHub等,並且解決org_api令牌還能讀取的問題。這些知名企業已經撤銷其令牌,也移除了API上曝露出的token。

但研究人員表示,Hugging Face並未立即採取積極作為保護其用戶令牌。他們同時呼籲所有開發人員避免將令牌資訊寫死在API,以免洩露資訊而為攻擊者開方便之門。

熱門新聞

2024-04-29

2024-04-29

2024-04-30

2024-04-30

2024-04-28

2024-04-29

2024-04-29