| Nvidia | MLCommons | 基準測試 | MLPerf Inference

Nvidia在Llama 2 70B與Stable Diffusion XL模型基準測試皆拔得頭籌

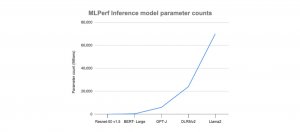

MLCommons人工智慧模型推理基準測試套件MLPerf Inference v4加入兩個新模型測試,分別是文生圖模型Stable Diffusion XL和開源語言模型Llama 2 70B,而在資料中心分類皆由Nvidia奪冠

2024-03-29

| CXL | PCIe | Nvidia | NVLink | NVLink C2C | HBM | Computer Express Link

隨著AI應用的興起,讓GPU成為主導資料中心架構變革的主要動力,也讓原先以CPU應用為核心的CXL記憶體互連技術發展,陷入了困境

2024-03-24

| 生成式AI | 微服務 | Microservice | Nvidia

Nvidia擴增AI Enterprise 5.0平臺上的生成式AI微服務數量,可供用戶在AWS、Google Cloud、Azure或Oracle雲端環境大規模部署AI模型,或是打造資料處理、AI與高效能運算相關應用

2024-03-20

| 機器人 | Nvidia | Project GR00T

Nvidia表示Project GR00T為一針對人形機器人所設計的通用多模態模型,它可充當機器人的大腦,協助機器人學習解決各種任務的技能

2024-03-19

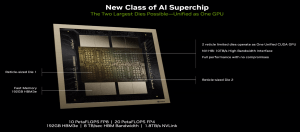

| Nvidia | GPU | Blackwell | GB200 NVL72

Nvidia推出採用最新Blackwell架構的GB200 NVL72資料中心機架系統

Nvidia以新一代Blackwell GPU架構打造的GB200 NVL72為支援多節點與液冷的機架系統,可於超大規模的AI雲端中實現網路加速、組合儲存、零信任安全,以及彈性的GPU運算能力

2024-03-19

市場對AI應用的運算需求日增,也促使Nvidia旗下資料中心業務比前一年同期成長4倍,為這家繪圖處理器大廠賺進8成營收

2024-02-22

Nvidia進一步揭露其位居TOP 500第9名AI超級電腦Eos的細節

Nvidia公開其基於DGX SuperPOD架構的資料中心級超級電腦Eos,擁有576個Nvidia DGX H100系統,全部高達4,608個H100 GPU,可提供18.4 Exaflops的FP8運算效能

2024-02-17

Nvidia推出Chat with RTX應用程式,供用戶在本地端自訂AI聊天機器人

Nvidia發布Chat with RTX應用程式,讓用戶利用檢索增強生成、TensorRT-LLM和RTX加速等技術,在本地端自訂人工智慧聊天機器人,以快速且安全地執行查詢

2024-02-15