美國國家標準暨技術研究院(NIST)發布第一版人工智慧風險管理框架(Artificial Intelligence Risk Management Framework,AI RMF),該框架由美國國會指示NIST制定,目的是要提供設計、開發、部署和使用人工智慧系統的指南,降低應用人工智慧技術的風險。

NIST提到,和傳統軟體相比,人工智慧存在更多的潛在風險。這是因為人工智慧系統使用的訓練資料,因時間推移而改變,有時會出現意料之外的變化,所以,NIST認為,在本質上,人工智慧系統是一種社會技術(Socio-technical),像是線上聊天機器人或是篩選貸款申請所用的模型,都受到社會動態和人類行為的影響。

這套AI RMF框架由NIST與公部門和企業合作制定,能夠適應不斷發展的人工智慧技術,以及受到組織以不同程度和能力的使用,使得整個社會不僅能從人工智慧技術獲益,也能免受潛在風險危害。透過該框架的檢視,組織能以不同角度思考人工智慧的風險,包括促進本身制度文化的變革,更全面地思考、評估和監控人工智慧風險,以及積極和消極層面的影響。透過框架當中提供的靈活且結構化評估,組織只要遵循該人工智慧風險管理流程,就能發揮人工智慧優勢,降低對個人、團體、社群,甚至是社會的負面影響。

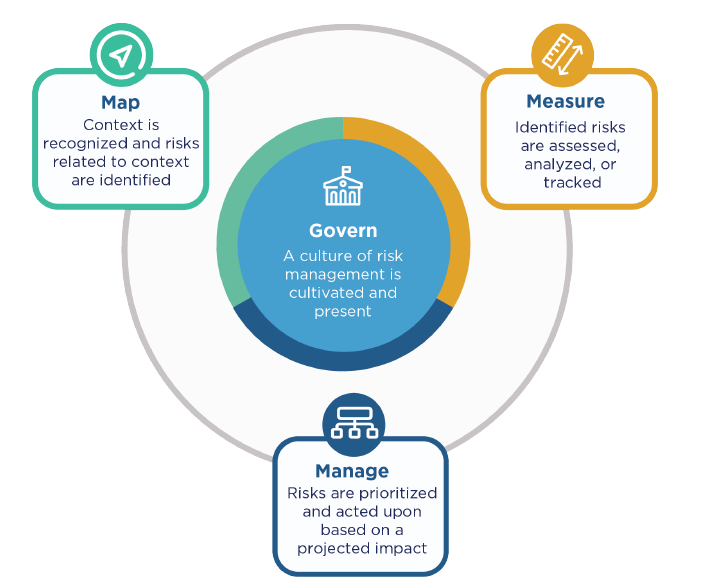

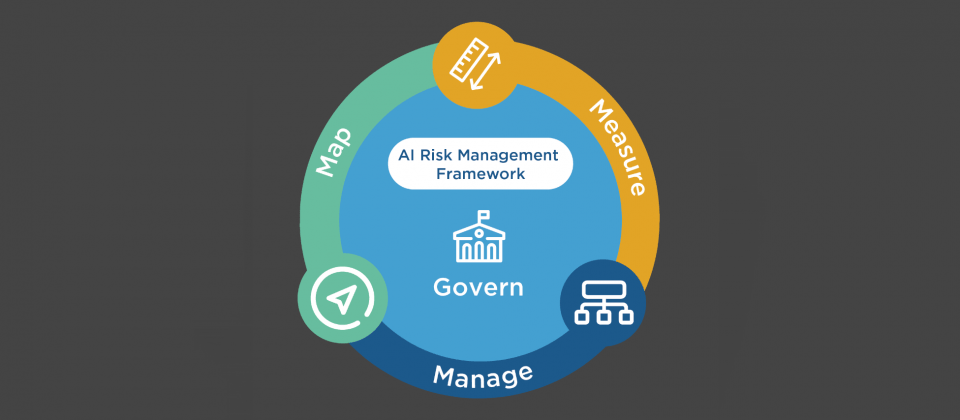

整體而言,AI RMF分為兩部分,首先探討人工智慧的相關風險,以及信賴人工智慧系統(trustworthy AI systems)的特徵,其次則是描述4大具體功能,分別為治理、映射、測量管理,協助組織實踐框架。

關於AI RMF內容的定稿,NIST總共耗費18個月之久,他們從240個組織收到400份針對AI RMF草案的正式評論,並利用這些回饋意見補足與改良AI RMF。在此同時,NIST也發布AI RMF Playbook,從中指導組織使用該框架的方法。後續將與人工智慧社群合作並定期更新框架,並成立可靠、負責任人工智慧的資源中心(Trustworthy and Responsible AI Resource Center),協助組織實踐AI RMF 1.0。

熱門新聞

2024-04-17

2024-04-17

2024-04-18

2024-04-15

2024-04-15

2024-04-15